Способ и устройство для восстановления речи в системе распределенного распознавания речи

Иллюстрации

Показать всеИзобретение относится к восстановлению речи, более конкретно к способу и устройству для восстановления речи в системе распределенного распознавания речи. Заявлены способ и устройство для восстановления речи в системе распределенного распознавания речи. Пропущенные коэффициенты MFCC восстанавливаются и используются для генерации речи. В частности, частичное восстановление пропущенных коэффициентов MFCC достигается путем использования зависимости пропущенных коэффициентов MFCC от переданного периода Р основного тона, а также от переданных коэффициентов MFCC. Амплитуды гармоник затем получают из переданных и восстановленных коэффициентов MFCC, и речь восстанавливается с использованием этих амплитуд гармоник. Технический результат - улучшение восстановления речи путем повышения точности преобразования амплитуд гармоник. 2 н. и 6 з.п. ф-лы, 4 ил.

Реферат

Область техники

Настоящее изобретение относится к восстановлению речи, более конкретно к способу и устройству для восстановления речи в системе распределенного распознавания речи.

Предшествующий уровень техники

Автоматическое распознавание речи (ASR) представляет собой способ автоматического распознавания характера устных команд на основе информации, включенной в речевые колебания. Метод ASR ввел новое поколение устройств защиты, основанных на устных, а не физических, ключах, и сделал возможной реализацию целого ряда функций «без использования рук» или «со свободными руками» («громкая связь»), таких как голосовой набор и извлечение информации голосом.

На наивысшем уровне все системы ASR осуществляют обработку речи для выделения свойств (также известную как обработка сигнала на высокой частоте) и согласования свойств (также известную как обработка сигнала на низкой частоте). Выделение свойств представляет собой метод, посредством которого малый объем данных извлекается из речевого ввода для представления речевого ввода. Согласование свойств представляет собой метод, посредством которого характер инструкций, содержащихся в речевом вводе, идентифицируется путем сравнения выделенных данных с набором известных данных. В стандартной системе ASR блок обработки выполняет обе эти функции.

Однако показатели системы ASR, которая использует речь, передаваемую, например, по мобильному или беспроводному каналу в качестве ввода, могут быть существенно ухудшены по сравнению с показателями системы ASR, которая использует в качестве ввода исходную немодифицированную речь. Это ухудшение в показателях системы может быть обусловлено искажениями, вводимыми в передаваемую речь за счет алгоритма кодирования, а также ошибками передачи в канале.

Система распределенного распознавания речи (DSR) пытается скорректировать ухудшение показателей системы, обусловленное передаваемой речью, путем разделения функций выделения и согласования и выполнения двух методов, реализуемых двумя различными блоками обработки, находящимися в двух разных местоположениях. Например, в системе или сети мобильной или беспроводной связи, использующей метод DSR, содержащей первое устройство связи (например, мобильное устройство) и второе устройство связи (например, сервер), мобильное устройство выполняет только функцию выделения признаков, т.е. мобильное устройство выделяет и кодирует признаки распознавания из речевого ввода. Мобильное устройство затем передает кодированные признаки по защищенному от ошибок каналу передачи данных в сервер. Сервер принимает кодированные признаки и выполняет только согласование признаков, т.е. сервер согласует кодированные признаки с признаками, содержащимися в наборе известных данных.

При таком подходе искажения кодирования минимизированы, и ошибки канала передачи оказывают весьма незначительное влияние на показатели системы распознавания. Более того, мобильное устройство должно выполнять только выделение признаков, являющееся относительно экономичным по вычислительным операциям, оставляя более сложное и дорогостоящее согласование признаков за сервером. За счет резервирования более сложных в вычислительном смысле действий для серверного процессора за процессором мобильного устройства сохраняется большая гибкость проектирования, при этом размеры и быстродействие процессора в типовом случае весьма актуальны, принимая во внимание последние тенденции к миниатюризации устройств.

Европейский Институт стандартов по телекоммуникациям (ETSI) опубликовал в последнее время стандарт для алгоритмов выделения и сжатия признаков: стандарт ES 201 108, Speech processing, Transmission and Quality aspects (STQ); Distributed speech recognition; Front-end feature extraction algorithm; Compression algorithms, Ver.1.1.2, April 2000 (далее - “ETSI Front-End-стандарт” (стандарт ETSI на высокочастотную обработку)), включенный в настоящее описание во всей своей полноте посредством ссылки. Хотя для кодирования данных речевого ввода существуют различные методы, такие как линейное прогнозирование (LP), ETSI Front-End-стандарт включает в себя алгоритм извлечения признаков, который извлекает и кодирует речевой ввод как значение логарифма энергии и последовательность Mel-частотных кепстральных коэффициентов (MFCC) для каждого кадра. Эти параметры по существу охватывают информацию спектральной огибающей речевого ввода и обычно используются в большинстве устройств распознавания речи с большим запасом слов. ETSI Front-End-стандарт, кроме того, включает в себя алгоритмы для сжатия (путем векторного квантования) и защиту от ошибок (проверку циклически избыточным кодом). ETSI Front-End-стандарт также описывает подходящие алгоритмы для декодирования потока битов и снижения влияния канальных ошибок. На интервале обновления 10 мс и при добавлении синхронизации и информации заголовка скорости передачи данных составляют до 4800 бит/с.

Недавно Европейский Институт стандартов по телекоммуникациям (ETSI) опубликовал другой стандарт для алгоритмов выделения и сжатия признаков: стандарт ES 202 050, Speech processing, Transmission and Quality aspects (STQ); Distributed speech recognition; Advanced Front-end feature extraction algorithm; Compression algorithms, Ver.1.1.1, July 2002 (далее - “Усовершенствованный ETSI Front-End-стандарт”), включенный в настоящее описание во всей своей полноте посредством ссылки. Усовершенствованный ETSI Front-End-стандарт весьма сходен с ETSI Front-End-стандартом в терминах извлекаемых признаков, частот битов и т.д., но характеризует собой повышенную устойчивость к шумам. То есть усовершенствованный ETSI Front-end-стандарт обеспечивает лучшие показатели в условиях шумового фона.

Таким образом, система DSR, такая как спроектированная в соответствии с ETSI-стандартом на высокочастотную обработку (или усовершенствованным ETSI-стандартом на высокочастотную обработку), обеспечивает много преимуществ для реализации сети мобильной связи. Такая система может обеспечивать показатели распознавания, эквивалентные системе ASR, но при низкой сложности высокочастотного тракта, который может быть воплощен в мобильном устройстве, и при низких требованиях к ширине полосы для передачи кодированных признаков распознавания.

Системы DSR имеют недостаток, состоящий в том, что исходный сигнал речевого ввода недоступен в низкочастотном тракте для целей сохранения и/или верификации. Было бы полезным иметь исходный сигнал речевого ввода, доступный для: (i) низкочастотных приложений, которые требуют участия человека, например для обеспечения ручной коррекции документов, генерируемых с использованием дистанционного диктования за счет обеспечения возможности сравнения документа с исходным речевым вводом, чтобы обеспечить возможность плавного перехода к задаче распознавания, когда она передается от системы DSR к оператору-человеку; (ii) профилактического сохранения информации правового статуса, например для записи точных положений, формируемых при финансовых транзакциях, таких как размещение заказа ценных бумаг; и (iii) подтверждение произношений в процессе сбора данных, например, для тренировки устройства распознавания в пакетном режиме (и особенно в режиме с приращениями) и системной настройки.

С другой стороны, исходная речь доступна в низкочастотном тракте, если используется стандартная система ASR. Однако, как отмечено выше, ASR имеет значительные трудности, обусловленные искажениями, при использовании в мобильных или беспроводных приложениях. Для решения этой проблемы публикация патентной заявки США № 2002/0147579 (включенная в настоящее описание посредством ссылки) обеспечивает способ восстановления речи в низкочастотном тракте с использованием синусоидального вокодера. В соответствии с заявкой '579 13 передаваемых коэффициентов MSCC (C0-C12) преобразуются в амплитуды гармоник, которые используются для восстановления речи.

Вышеописанный способ преобразования коэффициентов MFCC в амплитуды гармоник работает довольно хорошо. Речь, восстанавливаемая синусоидальным кодером с использованием этих преобразованных амплитуд, является в высшей степени разборчивой и имеет приемлемое качество. Однако очевидно, что показатели восстановления (в терминах разборчивости речи и качества) были бы выше, если бы все 23 значения (С0-С22) были доступными, вместо только 13 переданных значений, а именно С0-С12. Поэтому существует необходимость в способе и устройстве для восстановления речи в системе распределенного распознавания речи, которая использует пропущенные значения MFCC для улучшения восстановления речи.

Краткое описание чертежей

Фиг.1 - блок-схема системы распределенного распознавания речи в соответствии с предпочтительным вариантом осуществления настоящего изобретения.

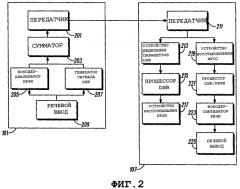

Фиг.2 - более детальная блок-схема системы распределенного распознавания речи по фиг.1 в соответствии с предпочтительным вариантом осуществления настоящего изобретения.

Фиг.3 - блок-схема, иллюстрирующая работу устройства восстановления значений MFCC в соответствии с предпочтительным вариантом осуществления настоящего изобретения.

Фиг.4 - блок-схема, иллюстрирующая работу процессора DSR/речи в соответствии с предпочтительным вариантом осуществления настоящего изобретения.

Детальное описание чертежей

Для удовлетворения вышеописанных потребностей предложен способ и устройство для восстановления речи в системе распределенного распознавания речи. В соответствии с предпочтительным вариантом осуществления настоящего изобретения пропущенные коэффициенты MFCC восстанавливаются; в частности, частичное восстановление пропущенных коэффициентов MFCC достигается путем использования зависимости пропущенных коэффициентов MFCC от периода Р переданного основного тона, а также от переданных коэффициентов MFCC. Амплитуды гармоник затем получают из переданных и восстановленных коэффициентов MFCC, и речь восстанавливается с использованием этих преобразованных амплитуд.

Поскольку амплитуды гармоник получают с использованием всех коэффициентов MFCC (переданных и восстановленных), в результате обеспечивается повышение точности преобразованных амплитуд гармоник. Любое повышение точности преобразованных амплитуд гармоник приводит к соответствующему улучшению в разборчивости/ качестве восстановленной речи.

Настоящее изобретение включает в себя способ восстановления речи. Способ включает в себя этапы приема первого множества Mel-частотных кепстральных коэффициентов (MFCC), вычисление второго множества коэффициентов MFCC и использование принятых и вычисленных коэффициентов MFCC для восстановления речи.

Настоящее изобретение также включает в себя способ восстановления речи. Способ включает в себя этапы приема Мel-частотных кепстральных коэффициентов С0-С12, вычисление Mel-частотных кепстральных коэффициентов С13-С22 и использование коэффициентов С0-С22 для восстановления речи.

Наконец, настоящее изобретение включает в себя устройство, содержащее приемник, принимающий первое множество Mel-частотных кепстральных коэффициентов (MFCC), устройство восстановления, вычисляющее второе множество коэффициентов MFCC, и процессор речи, использующий принятые и вычисленные коэффициенты MFCC для восстановления речи.

На чертежах одинаковыми ссылочными позициями обозначены сходные компоненты. При этом на фиг.1 представлена блок-схема системы 100 связи, соответствующей предпочтительному варианту осуществления настоящего изобретения. Система 100 связи предпочтительно содержит стандартную сотовую систему, такую как система связи множественного доступа с кодовым разделением каналов (CDMA). Хотя система 100 предпочтительно является системой мобильной или беспроводной радиочастотной связи, однако система 100 может представлять собой систему связи любого типа, например проводную или беспроводную систему или систему, использующую метод связи, иной, чем радиочастотная связь.

Система 100 связи включает в себя мобильное устройство 101 связи (такое как мобильная станция) и стационарное устройство 103 связи (такое как базовая станция), причем мобильное устройство 101 связи осуществляет связь со стационарным устройством 103 связи путем использования радиочастотных передач. Базовая станция 103, в свою очередь, осуществляет связь с сервером 107 посредством проводного соединения, как и сервер 107 с удаленной станцией 109. Используя систему 100, пользователь может осуществлять связь с удаленной станцией или с пользователем, связанным с удаленной станцией 109.

Хотя на фиг.1 показано только одно мобильное устройство 101, стационарное устройство 103, сервер 107 и удаленная станция 109, понятно, что система 100 может иметь и в типовом случае имеет множество мобильных устройств 101, осуществляющих связь с множеством стационарных устройств 103, причем стационарные устройства 103 в свою очередь осуществляют связь с множеством серверов 107, осуществляющих связь с множеством удаленных станций 109. Для простоты иллюстрации показаны только одно мобильное устройство 101, стационарное устройство 103, сервер 107 и удаленная станция 109, однако описываемое изобретение не ограничено размерами показанной системы 100.

Система 100 связи представляет собой систему распределенного распознавания речи, как описано в заявке США 2002/0147579 на «Способ и устройство для восстановления речи в системе распределенного распознавания речи». Как описано в заявке '579, мобильное устройство 101 выполняет выделение признаков, а сервер 107 выполняет согласование признаков. Система 100 связи также передает восстановленную речь на сервер 107 для сохранения и/или верификации. Как описано выше, система связи, описанная в заявке '579, использует множество переданных коэффициентов MFCC для формирования амплитуд гармоник, используемых для восстановления речи. Хотя данный способ преобразования коэффициентов MFCC в амплитуды гармоник работает довольно хорошо, показатели восстановления (в терминах разборчивости и качества речи) были бы более высокими, если бы имелись значения всех 23 коэффициентов MFCC (С0-С22), вместо всего лишь 13 значений, а именно С0-С12. Для решения этой проблемы в предпочтительном варианте осуществления настоящего изобретения не переданные коэффициенты MFCC восстанавливаются и вырабатываются амплитуды гармоник с использованием как не переданных, восстановленных коэффициентов MFCC, так и переданных коэффициентов MFCC.

На фиг.2 представлена более детальная блок-схема системы распределенного распознавания речи по фиг.1, соответствующей предпочтительному варианту осуществления настоящего изобретения. Очевидно, что система распределенного распознавания речи подобна системе распределенного распознавания речи по заявке '579, за исключением дополнения ее устройством 219 восстановления.

Как показано, мобильное устройство 101 содержит устройство 209 речевого ввода (например, микрофон), которое связано с генератором 207 сигналов DSR и речевым вокодером-анализатором 205. Генератор 207 сигналов DSR выделяет спектральные данные для речевого ввода, принятого посредством устройства 209 речевого ввода, и генерирует кодированный сигнал, который представляет эти спектральные данные. Вокодер-анализатор 205 выделяет дополнительные данные для речевого ввода, которые могут быть использованы для восстановления речи в низкочастотном тракте.

Сумматор 203 суммирует кодированный сигнал с генератора 207 сигналов DSR и дополнительные данные, выделенные вокодером-анализатором 205, для получения объединенного сигнала, который подается на передатчик 201, связанный с сумматором 203. Передатчик 201 является радиочастотным передатчиком или приемопередатчиком, однако поскольку способ, соответствующий настоящему изобретению, может использоваться с другими типами систем связи, в таком случае передатчик может быть выбран так, чтобы обеспечивать совместимость с соответствующей выбранной системой.

Генератор 207 сигналов DSR работает следующим образом в системе, спроектированной в соответствии с ETSI Front-End-стандартом, речевой ввод преобразуется из аналоговой формы в цифровую, например, с частотой дискретизации (Fs) 8000 выборок в секунду и 16 бит на выборку. Размер кадра зависит от частоты дискретизации. Для ETSI Front-End-стандарта, который учитывает три различных частоты дискретизации 8, 11 и 16 кГц, возможные размеры кадра составляют 200, 256 и 400 выборок соответственно.

Вычисляется уровень энергии кадра и определяется натуральный логарифм этого значения. Полученное в результате значение также упоминается как значение логарифма энергии. Преобразованный в кадры цифровой речевой сигнал затем пропускается через фильтр предыскажений для выделения более высокочастотных составляющих. Каждый речевой кадр подвергается затем обработке методом окна, например, с использованием окна Хэмминга, и преобразуется в частотную область с использованием быстрого преобразования Фурье (БПФ). Подобно размеру окна, используемый размер БПФ зависит от частоты дискретизации, например 256-точечное БПФ используется для частот дискретизации 8 и 11 кГц, а 512-точечное БПФ - для частоты дискретизации 16 кГц.

Амплитуды БПФ в частотном диапазоне от 64 Гц до Fs/2 (например, 4 кГц для частоты дискретизации 8 кГц) преобразуются в Mel-частотную область посредством процесса, известного как Mel-фильтрация. Преобразование в Mel-частотную область выполняется вследствие того, что психофизические исследования показали, что человеческое восприятие частотного содержимого звуков в речевом сигнале не следует линейной шкале. Соответственно, для каждого тона с действительной частотой f, измеренной в герцах, субъективный основной тон может быть представлен на второй шкале, упоминаемой как Mel-частотная шкала.

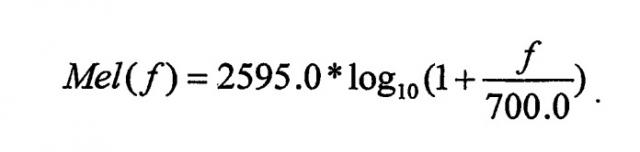

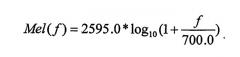

Процесс Mel-фильтрации состоит в следующем. Сначала частотный диапазон (например, от 64 Гц до 4000 Гц) преобразуется на Mel-частотную шкалу с использованием выражения:

С использованием этого уравнения Mel-частоты, соответствующие, например, частотам от 64 Гц до 4000 Гц, становятся соответственно значениями от 98,6 до 2146,1. Затем этот Mel-частотный диапазон делится на 23 равных, наполовину перекрывающихся полос (также известных как каналы, или «бины»), причем каждая полоса имеет ширину 170,6, и центр каждой полосы смещен на 85,3. Центр первой полосы расположен в точке 98,6+85,3=183,9, и центр последней полосы в точке 2146,1-85,3=2060,8. Эти полосы одинакового размера в Mel-частотной области соответствуют полосам неодинакового размера в линейной частотной области с увеличивающимся размером по оси частот. Амплитуды БПФ, попадающие в каждую полосу, затем усредняются (фильтруются) с использованием треугольной взвешивающей функции (причем вес в центре равен 1,0, а на каждом конце равен 0,0). Выходные сигналы отфильтрованных полос затем подвергаются обработке взятия натурального логарифма.

Полученные 23 логарифма спектральных значений затем преобразуются в кепстральную область посредством 23-точечного дискретного косинусного преобразования (ДКП). Следует отметить, что вычисляются только первые 13 значений (от С0 до С12), в то время как остальные десять значений (от С13 до С22) отбрасываются, т.е. не вычисляются. Значение логарифма энергии кадра и 13 кепстральных значений (также называемых Mel-частотными кепстральными коэффициентами или MFCC) затем подвергаются обработке сжатием (квантованию) и передаются на стационарное устройство 107. Для системы 100 связи, работающей согласно ETSI Front-End-стандарту, значения MFCC и логарифма энергии обновляются каждые 10 мс.

Как отмечено выше, вокодер-анализатор 205 также принимает речевой ввод. В частности, вокодер-анализатор 205 анализирует ввод для определения других данных, относящихся к речевому вводу, которые могут быть использованы сервером 107 дополнительно к данным, выводимым из DSR-кодированной речи для восстановления речи. Данные, выделенные вокодером-анализатором 205, зависят от характеристик вокодера речи, связанного с сервером 107, который будет синтезировать восстановленную речь. Например, CELP-вокодеры требуют использования индексов кодовых книг для каждого подготавливаемого подкадра речи. Для параметрических вокодеров (например, синусоидальных вокодеров) могут потребоваться дополнительные данные возбуждения, такие как класс (звонкий, глухой и т.д.) и период основного тона, а также данные энергии высокого разрешения, такие как уровни энергии подкадров.

Известно, что качество речи, синтезированной CELP-кодерами, быстро падает, когда частота битов снижается ниже 4800 бит/с. С другой стороны, параметрические вокодеры обеспечивают приемлемое качество речи при низких частотах битов. Поскольку одним из главных требований, предъявляемых к системе DSR, является низкая скорость передачи данных, параметрический вокодер, в частности синусоидальный вокодер, будет в типовом случае использоваться в сервере 107. Следовательно, в соответствии с предпочтительным вариантом осуществления изобретения вокодер-анализатор 205 речи определяет данные класса, периода основного тона и энергии подкадра для каждого речевого кадра, хотя факультативно данные энергии подкадра могут быть опущены, поскольку энергии подкадра могут быть вычислены интерполяцией из значений логарифма энергии.

Вокодер-анализатор 205 предпочтительно работает с размером кадра примерно 20 мс, т.е. параметры передаются однократно каждые 20 мс. В каждом кадре 2 бита используются для параметра класса, т.е. для индикации того, является ли кадр неречевым, звонким, глухим, смешанно-звонким и т.д. Классификация на речевой/неречевой кадр предпочтительно выполняется с использованием детектора речевой активности (VAD), основанного на энергии, в то время как определение уровня озвученности основано на ряде признаков, включая периодическую корреляцию (нормализованную корреляцию с запаздыванием, равным периоду основного тона), периодическое отношение энергий (отношение энергий декоррелированного и исходного кадров) и отношение высокочастотной энергии. Параметр периода основного тона, который обеспечивает информацию о частотах гармоник, может в типовом случае быть представлен с использованием 7 битов для типового диапазона частот основного тона примерно от 55 Гц до 420 Гц. Период основного тона предпочтительно оценивается с использованием корреляционного анализа во временной области речи, прошедшей низкочастотную фильтрацию. Если должен передаваться параметр данных энергии с более высоким разрешением, например энергии подкадров, то это может быть выполнено с использованием дополнительно 8 битов. Энергии подкадров квантуются в логарифмической области посредством 4-мерного вектора квантования (VQ), причем энергия для неречевых и глухих речевых кадров вычисляется по подкадру (4 подкадра на кадр), а энергия для звонких кадров вычисляется по периоду основного тона. Как вариант, энергии подкадров могут комбинироваться со значением логарифма энергии для снижения частоты битов.

В предположении, что класс, период основного тона и значения энергии подкадров передаются каждые 20 мс, т.е. однократно на каждые два DSR-кадра, если используется система стандарта ETSI, то примерно от 800 до 850 бит/с должно быть добавлено к скорости передачи данных. Если дополнительные данные энергии не передаются, то к скорости передачи данных может быть добавлено всего лишь 450 бит/с.

Детальная структура сервера 107 поясняется ниже со ссылками на правую половину фиг.2. Приемник 211 (который является РЧ приемником) связан с обычным устройством 213 выделения параметров DSR и устройством 219 восстановления MFCC. Устройство 213 выделения параметров DSR связано с обычным процессором 215 DSR и обычным устройством 217 распознавания речи для сравнения кодированных данных с набором известных данных, а устройство 219 восстановления коэффициентов MFCC связано процессором 221 DSR/речи, который, в свою очередь, связан с вокодером-синтезатором 223 речи (как указано выше, предпочтительно синусоидальным вокодером-синтезатором речи) и устройством 225 речевого вывода (например, динамиком).

В процессе работы приемник 211 принимает период Р основного тона, а также переданные коэффициенты MFCC, т.е. С0-С12. Они подаются на устройство 219 восстановления коэффициентов MFCC, где восстанавливаются не переданные коэффициенты MFCC. Точное восстановление пропущенных коэффициентов невозможно. Однако частичное восстановление может быть осуществлено за счет использования зависимости пропущенных коэффициентов MFCC (в данном случае С13-С22) от переданного периода Р основного тона, а также от переданных MFCC, т.е. С0-С12. В первом варианте осуществления для генерации пропущенных коэффициентов MFCC используется таблица перекодировки.

Для использования зависимости между пропущенными коэффициентами MFCC и периодом основного тона применяется большая база данных речевых сигналов для извлечения релевантной информации (периода основного тона и пропущенных коэффициентов MFCC) для каждого «звонкого» кадра в базе данных. Диапазон периодов основного тона [PMIN, PMAX] затем делится на различные группы G1, G2, …, GM, и выделяются вектора пропущенных коэффициентов MFCC, соответствующие каждой группе. Затем вычисляется и сохраняется среднее значение векторов пропущенных коэффициентов MFCC, соответствующее каждой группе. Эти усредненные вектора D1, D2, ..., DM (размерности 10) представляют частично восстановленные пропущенные коэффициенты MFCC как функцию периода основного тона. В реальной операции, т.е. в процессе восстановления речи в низкочастотном тракте период Р основного тона используется для идентификации соответствующей группы Gm и использования соответствующего (заранее сохраненного) усредненного вектора Dm для пропущенных коэффициентов MFCC С13-С22. Все значения коэффициентов MFCC (действительные и генерированные) затем поступают на процессор 221 DSR/речи.

Процессор 221 DSR/речи содержит программу, которая управляет процессором 221 DSR/речи, для определения и декодирования DSR-кодированных спектральных данных, в частности амплитуд гармоник. Сначала значения коэффициентов MFCC, соответствующие импульсному отклику фильтра предыскажений, вычитаются из принятых значений коэффициентов MFCC для исключения влияния фильтра предыскажений, а также влияния Mel-фильтра. Затем значения коэффициентов MFCC инвертируются для вычисления логарифмов спектральных значений для частоты каждой желательной гармоники. Логарифмы спектральных значений затем возводятся в степень для получения спектральной амплитуды для гармоник. В типовом случае эти этапы выполняются в каждые 20 мс, хотя вычисления могут осуществляться более часто, например каждые 10 мс.

На фиг.3 представлена блок-схема, иллюстрирующая работу устройства восстановления коэффициентов MFCC по фиг.2, в соответствии с предпочтительным вариантом осуществления изобретения. Поток логической обработки начинается на этапе 301, где принимается первое множество значений коэффициентов MFCC. Как описано выше, только первые 13 значений (от С0 до С12) передаются в приемник 211, а остальные десять значений (от С13 до С22) отбрасываются мобильным устройством 101. На этапе 303 устройство 219 восстановления коэффициентов MFCC вычисляет пропущенные значения коэффициентов MFCC. Наконец, на этапе 35 устройство 219 восстановления коэффициентов MFCC комбинирует принятые значения коэффициентов MFCC (от С0 до С12) c вычисленными значениями коэффициентов MFCC (от С13 до С22) для генерации вектора коэффициентов MFCC полной длины (от С0 до С22) и подает его в процессор 221 DSR/речи.

На фиг.4 показана блок-схема алгоритма, поясняющая работу процессора 221 DSR/речи в соответствии с предпочтительным вариантом осуществления настоящего изобретения. Поток логической обработки начинается на этапе 401, где принимаются как переданные значения коэффициентов MFCC (С0-С12), так и восстановленные

(С0-С12), (С13-С22). На этапе 403 значения коэффициентов MFCC (С0-С22), соответствующие импульсному отклику фильтра предыскажений, вычитаются из принятых значений коэффициентов MFCC, чтобы в принципе исключить влияние фильтра предыскажений. Альтернативно, влияние фильтра предыскажений может быть исключено в качестве последнего этапа путем деления спектральной амплитуды частоты гармоники на импульсный отклик фильтра предыскажений на данной соответствующей частоте гармоники. Однако в дополнение к фильтру предыскажений Mel-фильтр вносит предыскажения на высоких частотах из-за увеличения ширины частотных полос по линейной оси частот. Импульсный отклик Mel-фильтра в центре любой полосы может быть принят как ширина соответствующей полосы, и для любой другой частоты может быть использовано интерполированное значение. Путем вычисления объединенного импульсного отклика фильтра предыскажений и Mel-фильтра влияние обоих фильтров может быть исключено на одном этапе путем деления спектральной амплитуды частоты гармоники на объединенный импульсный отклик на этой соответствующей частоте гармоники. Этап 403 позволяет получить тот же результат.

Модифицированные значения коэффициентов MFCC с исключенным влиянием фильтра предыскажений и Mel-фильтра затем используются для оценки спектральных амплитуд в соответствии с последующими этапами обработки. Mel-частоты, соответствующие частотам гармоник (выводимые из периода основного тона), определяются на этапе 405. Обратное дискретное косинусное преобразование (ОДКП) затем выполняется на этапах 407 и 409 над модифицированными значениями коэффициентов MFCC на Mel-частотах гармоник для преобразования кепстральных коэффициентов в логарифмы спектральных значений.

То есть 23-точечное ОДКП значений коэффициентов MFCC от С0 до С22 обеспечит восстановление исходных 23 логарифмов спектральных значений, за исключением искажений, обусловленных ошибкой квантования в значениях коэффициентов MFCC от С0 до С12 и ошибкой восстановления в значениях коэффициентов MFCC от

С12 до С22. Однако эти логарифмы спектральных значений соответствуют центрам 23 частотных полос. Логарифмы спектральных значений на других частотах необходимы для определения преобразованных значений коэффициентов MFCC для частот гармоник.

Для увеличения разрешения квантования размер ОДКП может быть увеличен на нечетное кратное числа 23, т.е. (2К+1)×23, где К>0. Это вводит К дополнительных точек Mel-частот с каждой стороны от 23 исходных Mel-частот, соответствующих центрам частотных полос. Например, если К=85, то имеется 85 дополнительных точек Mel-частот влево от центра первой частотной полосы и вправо от последней (т.е. 23-й частотной полосы) и 170 дополнительных точек Mel-частот между центрами любых двух последовательных частотных полос. Суммарное число точек Mel-частот в этом случае равно 171×23=3933. Для Fs=8000 Гц центры частотных полос смещены на 85,3 по шкале Mel-частот, и выбор К=85 увеличивает разрешение, так что последовательные точки Mel-частот разнесены только на 85,3/171=0,499. Важно отметить, что крайняя левая и крайняя правая точки Mel-частот ОДКП не соответствуют 0 и Fs/2 (например, 4000 Гц) на линейной шкале. Для нашего примера крайняя левая точка Mel-частот соответствует 183,9-85×0,499=141,48, и крайняя правая точка Mel-частот соответствует 2060,8+85×0,499=2103,2. Соответствующие точки на линейной частотной шкале соответствуют 93,6 Гц и 3824,6 Гц соответственно. Возможным способом обработки частот, не перекрытых частотным диапазоном ОДКП, является использование ближайшей частотной точки, т.е. частоты ниже 93,6 Гц присваиваются частотной точке 93,6 Гц, и аналогичным образом частоты выше 3824,6 Гц присваиваются частотной точке 3824,6 Гц. Альтернативным способом является применение некоторого типа интерполяции.

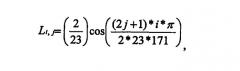

Более высокое разрешение ОДКП по существу интерполируется между центрами Mel-частотных полос с использованием базовых функций ОДКП в качестве функций интерполяции. Однако нет необходимости выполнять 3933-точечное ОДКП. Вместо этого для упрощения вычислений ОДКП в выбранных частотных точках на этапе 408 может быть предварительно вычислена 12×3933 матрица L значений ОДКП с использованием следующего уравнения:

где i=1, 2, …, 12 и j=0, 1, …, 3932. Нулевая строка, соответствующая С0, подразумевается и не требует сохранения, поскольку ее значение является постоянным и соответствует 1/23 для всех столбцов.

При условии задания этой матрицы L для получения логарифма спектрального значения на любой заданной Mel-частоте определяется местоположение ближайшей точки Mel-частоты, для которой вычислено ОДКП, и формируется внутреннее произведение между соответствующим столбцом и модифицированным вектором коэффициентов MFCC [C0, C1, …, C22]. Следовательно, для определения логарифма спектрального значения для частот гармоник, например, определяется местоположение ближайших точек Mel-частот, и на этапе 407 выбираются вектора-столбцы матрицы L. Преобразованные коэффициенты затем возводятся в степень для вычисления спектральных амплитуд на этапе 411.

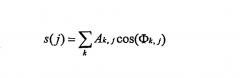

Синусоидальный вокодер-синтезатор 223 речи использует эти спектральные амплитуды вместе с данными относительно энергии кадра и другими данными (такими как класс, период основного тона и энергия подкадра), также выделенными процессором 221 DSR/речи под управлением вышеупомянутой программы, для восстановления речи как суммы ряда синусоидальных сигналов с различными частотами, амплитудами и фазами. В частности, синтезатор восстанавливает речь с использованием синусоидальной модели формирования речи:

где речевая выборка s(j) синтезируется как сумма некоторого числа гармонически связанных синусоид с амплитудой Ak,j и фазой Фk,j, j - индекс выборки и k - индекс гармоники.

В типовом случае процесс синтеза начинается с вычисления частот, амплитуд и фаз в центральной точке каждого кадра. Используемые частоты представляют собой частоту основного тона и ее гармоники, которые могут быть вычислены с использованием периода основного тона. Используемые амплитуды могут быть амплитудами гармоник, которые могут оцениваться с использованием спектральных амплитуд, определенных с использованием способа, описанного выше, и энергии подкадров, соответствующей средней точке кадра (или ее интерполяции с использованием логарифма значения энергии). Альтернативно, для глухой (неозвученной) речи, например, амплитуды могут соответствовать набору частот, не обязательно идентичных частотам гармоник, и в этом случае эти амплитуды могут оцениваться с использованием общей формы способа, описанной выше, и энергии подкадра, соответствующей средней точке кадра (или ее интерполяции с использованием логарифма значения энергии). Вычисленные фазы зависят от параметра класса. Для звонкой речи вычисляются когерентные фазы. Для глухой речи вычисляются случайные, некогерентные фазы. Для смешанной звонкой речи используется модель звонкой речи для низких частот и модель глухой речи для высоких частот. Любая линейная фазовая составляющая исключается из моделируемых фаз.

Если значения частоты, амплитуды и фазы в средней точке известны, то амплитуды и фазы в других точках могут быть вычислены. Например, если амплитуды в средних точках текущего и предыдущего звонких кадров известны, то амплитуды границ подкадров могут быть вычислены с использованием линейной интерполяции с настройкой для энергий в этих точках. Амплитуды в подкадре могут также быть вычислены с использованием линейной интерполяции. Гармонические фазы для различных индексов выборок могут быть вычислены, если принять, что фаза изменяется линейно в соответствии с частотой. Частоты могут изменяться на границах подкадров одинаковыми приращениями относительно предыдущих значений до текущего значения. Любой разрыв непрерывности фазы, возникающий вследствие этого изменения, разрешается с использованием линейных коэффициентов коррекции фазы (т.е. малых сдвигов частоты). Если предыдущий и текущий кадры относятся к разным классам (например, один звонкий, а другой глухой), или оба звонкие, но периоды основного тона существенно отличаются, например удваиваются, то два кадра синтезируются независимо и с пере