Устройство декодирования параметров, устройство кодирования параметров и способ декодирования параметров

Иллюстрации

Показать всеНастоящее изобретение относится к устройству кодирования параметров с использованием устройства предсказания, и к устройству декодирования параметров и способу декодирования параметров, которые декодируют кодированный параметр. Техническим результатом является повышение эффективности маскирования параметра для исключения ухудшения качества. Указанный технический результат достигается тем, что устройство декодирования параметров содержит узел декодирования остатка предсказания, который находит квантованный остаток предсказания, основываясь на кодированной информации, включаемой в текущий кадр, подвергаемый декодированию, и узел декодирования параметра, который декодирует параметр, основываясь на указанном квантованном остатке предсказания, причем указанный узел декодирования остатка предсказания, когда указанный текущий кадр удаляют, находит квантованный остаток предсказания текущего кадра из взвешенной линейной суммы параметра, декодированного в прошлом, и квантованного остатка предсказания будущего кадра. 3 н. и 4 з.п. ф-лы, 27 ил.

Реферат

ОБЛАСТЬ ТЕХНИКИ ИЗОБРЕТЕНИЯ

Настоящее изобретение относится к устройству кодирования параметров, которое кодирует параметр с использованием устройства предсказания, и к устройству декодирования параметров и способу декодирования параметров, которые декодируют кодированный параметр.

Предшествующий уровень техники

Что касается рекомендации ITU-T G.729, 3GPPAMR или подобного ему речевого кодека, некоторые из параметров, полученных с помощью анализа речевого сигнала, квантуют посредством способа квантования с предсказанием, основанного на модели предсказания скользящего среднего (МА) (патентный документ 1, непатентный документ 1, непатентный документ 2). Средство квантования с предсказанием МА-типа является моделью, которая предсказывает текущий параметр, который подвергается квантованию, с помощью линейной суммы предыдущих квантованных остатков предсказания, и речевой кодек линейного предсказания с кодовым возбуждением (CELP) используется для предсказания параметра частот спектральных линий (ЧСЛ, LSF) и параметра мощности.

Что касается средства квантования с предсказанием МА-типа, так как предсказание выполняют на основе взвешенной линейной суммы квантованных остатков предсказания в конечном количестве предыдущих кадров, даже если существует ошибка в тракте передачи квантованной информации, то ее влияние ограничено конечным количеством кадров. С другой стороны, с помощью средства квантования с предсказанием авторегрессивного (AR) типа, которое использует прошлые декодированные параметры рекурсивно, хотя высокая эффективность предсказания и квантования может в общем случае быть получена, влияние остатка продолжается в течение длительного периода. Следовательно, средство квантования параметра с предсказанием МА-типа может обеспечивать более высокую устойчивость к ошибкам, чем средство квантования параметра с предсказанием AR-типа, и оно используется, в частности, в речевом кодеке для мобильной связи.

Способы маскирования параметра, которые будут использоваться, когда кадр теряют (удаляют) на стороне декодирования, изучались в течение некоторого времени. В общем случае маскирование выполняют, используя параметр кадра, расположенного перед удаленным кадром, вместо параметра удаленного кадра. Однако в случае параметра ЧСЛ, параметры перед удаленным кадром постепенно изменяют с помощью постепенного приближения к среднему значению ЧСЛ, или выполняют постепенное ослабление в случае параметра мощности.

Этот способ обычно также используется в средстве квантования, использующем устройство предсказания МА-типа. В случае параметра ЧСЛ обработку выполняют для обновления состояния устройства предсказания МА-типа с помощью генерирования квантованного остатка предсказания таким образом, чтобы параметр, сгенерированный в маскированном кадре, был декодирован (непатентный документ 1), а в случае параметра мощности обработку выполняют для обновления состояния устройства предсказания МА-типа, используя результат уменьшения среднего значения предыдущих квантованных остатков предсказания в фиксированном процентном отношении (патентный документ 2, непатентный документ 1).

Также существует способ, посредством которого параметр удаленного кадра интерполируют после получения информации восстановленного кадра (обычного кадра), который следует за удаленным кадром. Например, в патентном документе 3 предложен способ, посредством которого выполняют интерполяцию усиления частот основного тона и повторно генерируют содержимое адаптивной кодовой книги.

Патентный документ 1: выложенная японская патентная заявка №HEI 6-175695

Патентный документ 2: выложенная японская патентная заявка №HEI 9-120297

Патентный документ 3: выложенная японская патентная заявка №2002-328700

Непатентный документ 1: рекомендация ITU-T G.729

Непатентный документ 2:3GPP TS 26.091

РАСКРЫТИЕ ИЗОБРЕТЕНИЯ

Проблемы, которые будут решены с помощью изобретения

Способ, посредством которого интерполируют параметр удаленного кадра, используется, когда квантование с предсказанием не выполняют, но когда квантование с предсказанием выполняют, даже если кодированную информацию принимают правильно в кадре, расположенном непосредственно после удаленного кадра, на устройство предсказания влияет ошибка в непосредственно предыдущем кадре, и оно не может получить правильный декодированный результат, и поэтому этот способ в общем случае не используется.

Таким образом, с помощью устройства квантования параметров, которое использует обычное устройство предсказания МА-типа, обработку маскирования параметра удаленного кадра не выполняют посредством способа интерполяции, и поэтому, например, может произойти потеря звука из-за чрезмерного ослабления параметра мощности, вызывая ухудшение субъективного качества.

Когда выполняют квантование с предсказанием, возможный способ состоит в декодировании параметра просто с помощью интерполяции квантованных декодированных остатков предсказания, но тогда как декодированный параметр меняется незначительно от одного кадра к другому кадру из-за определения взвешенного скользящего среднего значения, даже если квантованный декодированный остаток предсказания меняется очень сильно, при этом способе декодированный параметр также меняется в соответствии с изменениями квантованного декодированного остатка предсказания, так что когда изменения квантованного декодированного остатка предсказания большие, субъективное качество ухудшается.

Настоящее изобретение воплощают, учитывая описанные выше проблемы, и задачей настоящего изобретения является обеспечение устройства декодирования параметров, устройства кодирования параметров и способа декодирования параметров, которые дают возможность выполнять обработку маскирования параметра для подавления ухудшения субъективного качества при выполнении квантования с предсказанием.

Средство для решения проблем

Устройство декодирования параметров настоящего изобретения использует конфигурацию, имеющую узел декодирования остатка предсказания, который находит квантованный остаток предсказания, основываясь на кодированной информации, которую включает в себя текущий кадр, подвергаемый декодированию, и узел декодирования параметра, который декодирует параметр, основываясь на квантованном остатке предсказания; причем узел декодирования остатка предсказания, когда текущий кадр удаляют, находит квантованный остаток предсказания текущего кадра из взвешенной линейной суммы параметра, декодированного в прошлом, и квантованного остатка предсказания будущего кадра.

Устройство кодирования параметров настоящего изобретения использует конфигурацию, имеющую: узел анализа, который анализирует вводимый сигнал и находит анализируемый параметр; узел кодирования, который предсказывает анализируемый параметр, используя коэффициент предсказания, и получает квантованный параметр, используя квантованный остаток предсказания, полученный с помощью квантования остатка предсказания, и коэффициент предсказания; узел маскирования предыдущего кадра, который хранит множество наборов весовых коэффициентов, находит взвешенную сумму, используя наборы весовых коэффициентов для квантованного остатка предсказания текущего кадра, квантованного остатка предсказания два кадра назад и квантованного параметра два кадра назад, и находит множество квантованных параметров предыдущего кадра, используя взвешенную сумму; и узел определения, который сравнивает множество квантованных параметров один кадр назад, найденных с помощью узла маскирования предыдущего кадра, и анализируемый параметр, найденный с помощью узла анализа предыдущего кадра, выбирает один из квантованных параметров предыдущего кадра и выбирает и кодирует набор весовых коэффициентов, соответствующий выбранному квантованному параметру предыдущего кадра.

Способ декодирования параметров настоящего изобретения использует способ, имеющий этап декодирования остатка предсказания, состоящий из обнаружения квантованного остатка предсказания, основываясь на кодированной информации, которая включает в себя текущий кадр, подвергаемый декодированию, и этап декодирования параметра, состоящий из декодирования параметра, основываясь на квантованном остатке предсказания; причем на этапе декодирования остатка предсказания, когда текущий кадр удаляют, квантованный остаток предсказания текущего кадра находят из взвешенной линейной суммы параметра, декодированного в прошлом, и квантованного остатка предсказания будущего кадра.

Благоприятное воздействие изобретения

Согласно настоящему изобретению, когда текущий кадр удаляют, когда квантование с предсказанием не выполняют, обработку маскирования параметра можно выполнять для исключения ухудшения субъективного качества с помощью нахождения квантованного остатка предсказания текущего кадра из взвешенной линейной суммы квантованных остатков предсказания прошлого кадра и квантованных остатков предсказания будущего кадра.

КРАТКОЕ ОПИСАНИЕ ЧЕРТЕЖЕЙ

Фиг.1 - структурная схема, на которой показывают основную конфигурацию устройства декодирования речи согласно варианту осуществления 1 настоящего изобретения;

фиг.2 - чертеж, на котором показывают внутреннюю конфигурацию узла декодирования КЛП устройства декодирования речи согласно варианту осуществления 1 настоящего изобретения;

фиг.3 - чертеж, на котором показывают внутреннюю конфигурацию узла декодирования кодового вектора, показанного на фиг.2;

фиг.4 - чертеж, на котором показывают пример результата выполнения обычной обработки, когда нет удаленного кадра;

фиг.5 - чертеж, на котором показывают пример результата выполнения обработки маскирования данного варианта осуществления;

фиг.6 - чертеж, на котором показывают пример результата выполнения обычной обработки маскирования;

фиг.7 - чертеж, на котором показывают пример результата выполнения обычной обработки маскирования;

фиг.8 - структурная схема, на которой показывают основную конфигурацию устройства декодирования речи согласно варианту осуществления 2 настоящего изобретения;

фиг.9 - структурная схема, на которой показывают внутреннюю конфигурацию узла декодирования КЛП, показанного на фиг.8;

фиг.10 - структурная схема, на которой показывают внутреннюю конфигурацию узла декодирования кодового вектора, показанного на фиг.9;

фиг.11 - структурная схема, на которой показывают основную конфигурацию устройства декодирования речи согласно варианту осуществления 3 настоящего изобретения;

фиг.12 - структурная схема, на которой показывают внутреннюю конфигурацию узла декодирования КЛП, показанного на фиг.11;

фиг.13 - структурная схема, на которой показывают внутреннюю конфигурацию узла декодирования кодового вектора, показанного на фиг.12;

фиг.14 - структурная схема, на которой показывают внутреннюю конфигурацию узла декодирования коэффициента усиления, показанного на фиг.1;

фиг.15 - структурная схема, на которой показывают внутреннюю конфигурацию узла декодирования остатка предсказания, показанного на фиг.14;

фиг.16 - структурная схема, на которой показывают внутреннюю конфигурацию узла генерации квантованного остатка предсказания субкадра, показанного на фиг.15;

фиг.17 - структурная схема, на которой показывают основную конфигурацию устройства кодирования речи согласно варианту осуществления 5 настоящего изобретения;

фиг.18 - структурная схема, на которой показывают конфигурацию устройства передачи речевого сигнала и устройства приема речевого сигнала, которые конфигурируют систему передачи речевого сигнала согласно варианту осуществления 6 настоящего изобретения;

фиг.19 - чертеж, на котором показывают внутреннюю конфигурацию узла декодирования КЛП устройства декодирования речи согласно варианту осуществления 7 настоящего изобретения;

фиг.20 - чертеж, на котором показывают внутреннюю конфигурацию узла декодирования кодового вектора, показанного на фиг.19;

фиг.21 - структурная схема, на которой показывают основную конфигурацию устройства декодирования речи согласно варианту осуществления 8 настоящего изобретения;

фиг.22 - чертеж, на котором показывают внутреннюю конфигурацию узла декодирования КЛП устройства декодирования речи согласно варианту осуществления 8 настоящего изобретения;

фиг.23 - чертеж, на котором показывают внутреннюю конфигурацию узла декодирования кодового вектора на фиг.22;

фиг.24 - чертеж, на котором показывают внутреннюю конфигурацию узла декодирования КЛП устройства декодирования речи согласно варианту осуществления 9 настоящего изобретения;

фиг.25 - чертеж, на котором показывают внутреннюю конфигурацию узла декодирования кодового вектора, показанного на фиг.24; и

фиг.26 - структурная схема, на которой показывают основную конфигурацию устройства декодирования речи согласно варианту осуществления 10 настоящего изобретения.

Наилучший вариант осуществления изобретения

Варианты осуществления настоящего изобретения будут теперь описаны подробно в отношении сопроводительных чертежей. В последующих вариантах осуществления для примера описаны случаи, в которых устройство декодирования параметров и устройство кодирования параметров настоящего изобретения применяют к устройству декодирования речи и устройству кодирования речи CELP-типа, соответственно.

(Вариант осуществления 1)

Фиг.1 - структурная схема, на которой показывают основную конфигурацию устройства декодирования речи согласно варианту осуществления 1 настоящего изобретения. В показанном на фиг.1 устройстве 100 декодирования речи кодированную информацию, передаваемую от устройства кодирования (не показано), делят на код Fn+1 постоянной кодовой книги; код An+1 адаптивной кодовой книги, код Gn+1 коэффициента усиления и код Ln+1 КЛП (коэффициентов линейного предсказания) с помощью узла 101 демультиплексирования. Отдельно в устройство 100 декодирования речи вводят код Bn+1 удаления кадра. В данном случае нижний индекс n каждого кода указывает номер кадра, подвергаемого декодированию. Т.е. кодированную информацию разделяют в (n+1)-м кадре (в дальнейшем называют «следующим кадром») после n-го кадра, подвергаемого декодированию (в дальнейшем называют «текущим кадром»).

Код Fn+1 постоянной кодовой книги вводят в узел 102 декодирования вектора постоянной кодовой книги (ВПКК), код An+1 адаптивной кодовой книги - в узел 103 декодирования вектора адаптивной кодовой книги (ВАКК), код Gn+1 коэффициента усиления - в узел 104 декодирования коэффициента усиления, и код Ln+1 КЛП - в узел 105 декодирования КЛП. Код Bn+1 удаления кадра вводят в узел 102 декодирования ВПКК, в узел 103 декодирования ВАКК, в узел 104 декодирования коэффициента усиления и в узел 105 декодирования КЛП.

Узел 102 декодирования ВПКК генерирует вектор постоянной кодовой книги, используя код Fn постоянной кодовой книги, если код Bn удаления кадра указывает, что «n-й кадр является обычным кадром», и генерирует вектор постоянной кодовой книги посредством обработки маскирования удаления кадра, если код Bn удаления кадра указывает, что «n-й кадр является удаленным кадром». Сгенерированный вектор постоянной кодовой книги вводят в узел 104 декодирования коэффициента усиления и в усилитель 106.

Узел 103 декодирования ВАКК генерирует вектор адаптивной кодовой книги, используя код адаптивной кодовой книги, если код Bn удаления кадра указывает, что «n-й кадр является обычным кадром», и генерирует вектор адаптивной кодовой книги посредством обработки маскирования удаления кадра, если код Bn удаления кадра указывает, что «n-й кадр является удаленным кадром». Сгенерированный вектор адаптивной кодовой книги вводят в усилитель 107.

Узел 104 декодирования коэффициента усиления генерирует коэффициент усиления постоянной кодовой книги и коэффициент усиления адаптивной кодовой книги, используя код Gn коэффициента усиления и вектор постоянной кодовой книги, если код Bn удаления кадра указывает, что «n-й кадр является обычным кадром», и генерирует коэффициент усиления постоянной кодовой книги и коэффициент усиления адаптивной кодовой книги посредством обработки маскирования удаления кадра, если код Bn удаления кадра указывает, что «n-й кадр является удаленным кадром». Сгенерированный коэффициент усиления постоянной кодовой книги вводят в усилитель 106, а сгенерированный коэффициент усиления адаптивной кодовой книги вводят в усилитель 107.

Узел 105 декодирования КЛП декодирует параметр КЛП, используя код Ln КЛП, если код Bn удаления кадра указывает, что «n-й кадр является обычным кадром», и декодирует параметр КЛП посредством обработки маскирования удаления кадра, если код Bn удаления кадра указывает, что «n-й кадр является удаленным кадром». Декодированный параметр КЛП вводят в узел 109 синтеза КЛП. Подробности узла 105 декодирования КЛП будут приведены позже в данной работе.

Усилитель 106 умножает коэффициент усиления постоянной кодовой книги, выводимый из узла 104 декодирования коэффициента усиления, на вектор постоянной кодовой книги, выводимый из узла 102 декодирования ВПКК, и выводит результат умножения на сумматор 108. Усилитель 107 умножает коэффициент усиления адаптивной кодовой книги, выводимый из узла 104 декодирования коэффициента усиления, на вектор адаптивной кодовой книги, выводимый из узла 103 декодирования ВАКК, и выводит результат умножения на сумматор 108. Сумматор 108 складывает вместе вектор постоянной кодовой книги после умножения на коэффициент усиления постоянной кодовой книги, выводимый из усилителя 106, и вектор адаптивной кодовой книги после умножения на коэффициент усиления адаптивной кодовой книги, выводимый из усилителя 107, и выводит результат суммирования (в дальнейшем называемый «вектором суммы») в узел 109 синтеза КЛП.

Узел 109 синтеза КЛП конфигурирует фильтр синтеза с линейным предсказанием, используя декодированный параметр КЛП, выводимый из узла 105 декодирования КЛП, управляет фильтром синтеза с линейным предсказанием с помощью вектора суммы, выводимого из сумматора 108 в качестве сигнала возбуждения, и выводит синтезированный сигнал, полученный в результате данного управления, на выходной фильтр (фильтр окончательной обработки) 110. Выходной фильтр 110 выполняет обработку выделения формант и выделения частот основного тона и т.д. в синтезированном сигнале, выводимом из узла 109 синтеза КЛП, и выводит сигнал как декодированный речевой сигнал.

Далее будет подробно описана обработка маскирования параметра согласно данному варианту осуществления, рассматривая в качестве примера случай, в котором выполняют маскирование параметра КЛП. Фиг.2 - чертеж, на котором показывают внутреннюю конфигурацию узла 105 декодирования КЛП, показанного на фиг.1.

Код Ln+1 КЛП вводят в буфер 201 и узел 203 декодирования кодового вектора, и код Bn+1 удаления кадра вводят в буфер 202, узел 203 декодирования кодового вектора и блок 209 выбора.

Буфер 201 хранит код Ln+1 КЛП следующего кадра в течение продолжительности одного кадра, и затем выводит этот код КЛП в узел 203 декодирования кодового вектора. В результате того, что код хранится в буфере 201 в течение продолжительности одного кадра, код КЛП, выводимый из буфера 201 в узел 203 декодирования кодового вектора, является кодом Ln КЛП текущего кадра.

Буфер 202 хранит код Bn+1 удаления следующего кадра в течение продолжительности одного кадра, и затем выводит этот код удаления кадра в узел 203 декодирования кодового вектора. В результате того, что код хранится в буфере 202 в течение продолжительности одного кадра, код удаления кадра, выводимый из буфера 202 в узел 203 декодирования кодового вектора, является кодом Bn удаления текущего кадра.

Узел 203 декодирования кодового вектора имеет вектора xn-1-xn-м квантованных остатков предсказания М предыдущих кадров, декодированный вектор yn-1 ЧСЛ предыдущего кадра, код Ln+1 КЛП следующего кадра, код Bn+1 удаления следующего кадра, код Ln КЛП текущего кадра и код Bn удаления текущего кадра в качестве вводимой информации, производит вектор xn квантованного остатка предсказания текущего кадра, основываясь на этих элементах информации, и выводит вектор xn квантованного остатка предсказания текущего кадра в буфер 204-1 и усилитель 205-1. Подробности узла 203 декодирования кодового вектора будут приведены позже в данной работе.

Буфер 204-1 хранит вектор xn квантованного остатка предсказания текущего кадра в течение продолжительности одного кадра, и затем выводит этот вектор квантованного остатка предсказания в узел 203 декодирования кодового вектора, буфер 204-2 и усилитель 205-2. В результате того, что вектор хранится в буфере 204-1 в течение продолжительности одного кадра, вектор квантованного остатка предсказания, вводимый в узел 203 декодирования кодового вектора, буфер 204-2 и усилитель 205-2, является вектором xn-1 квантованного остатка предсказания предыдущего кадра. Точно так же каждый буфер 204-i (где i равно от 2 до М-1) хранит вектор xn-j+1 квантованного остатка предсказания в течение продолжительности одного кадра, и затем выводит этот вектор квантованного остатка предсказания в узел 203 декодирования кодового вектора, буфер 204-(i+1), и усилитель 205-(i+1). Буфер 204-М хранит вектор xn-М+1 квантованного остатка предсказания в течение продолжительности одного кадра, и затем выводит этот вектор квантованного остатка предсказания в узел 203 декодирования кодового вектора и усилитель 205-(М+1).

Усилитель 205-1 умножает вектор xn квантованного остатка предсказания на предопределенный коэффициент α0 предсказания МА и выводит результат на сумматор 206. Точно так же усилители 205-j (где j равно от 2 до М+1) умножают вектор xn-j+1 квантованного остатка предсказания на предопределенный коэффициент αj-1 предсказания МА и выводят результат на сумматор 206. Набор коэффициентов предсказания МА может быть фиксированными значениями одного вида, но в рекомендации ITU-T G.729 обеспечивают два вида наборов, какой набор следует использовать для выполнения декодирования, определяют на стороне кодера, и данный набор кодируют и передают как часть информации кода Ln КЛП. В этом случае используется конфигурация, посредством которой узел 105 декодирования КЛП обеспечивается набором коэффициентов предсказания МА в виде таблицы, и набор, определенный на стороне кодера, используется, как α0-αМ на фиг.2.

Сумматор 206 вычисляет общую сумму векторов квантованных остатков предсказания после умножения на коэффициенты предсказания МА, выводимые из усилителей 205-1-205-(М+1), и выводит результат вычисления, декодированный вектор yn ЧСЛ, в буфер 207 и в узел 208 преобразования КЛП.

Буфер 207 хранит декодированный вектор yn ЧСЛ в течение продолжительности одного кадра, и затем выводит этот декодированный вектор ЧСЛ в узел 203 декодирования кодового вектора. В результате декодированный вектор ЧСЛ, выводимый из буфера 207 в узел 203 декодированного кодового вектора, является декодированным вектором yn-1 ЧСЛ предыдущего кадра.

Узел 208 преобразования КЛП преобразовывает декодированный вектор yn ЧСЛ в набор коэффициентов линейного предсказания (декодированный параметр КЛП), и выводит его на блок 209 выбора.

Блок 209 выбора выбирает декодированный параметр КЛП, выводимый из узла 208 преобразования КЛП, или декодированный параметр КЛП предыдущего кадра, выводимый из буфера 210, основываясь на коде Bn удаления текущего кадра и коде Bn+1 удаления следующего кадра. В частности, декодированный параметр КЛП, выводимый из узла 208 преобразования КЛП, выбирают, если код Bn удаления текущего кадра указывает, что «n-й кадр является обычным кадром», или код Bn+1 удаления следующего кадра указывает, что «(n+1)-й кадр является обычным кадром», а декодированный параметр КЛП следующего кадра, выводимый из буфера 210, выбирают, если код Bn удаления текущего кадра указывает, что «n-й кадр является удаленным кадром» и код Bn+1 удаления следующего кадра указывает, что «(n+1)-й кадр является удаленным кадром». Затем блок 209 выбора выводит результат выбора в узел 109 синтеза КЛП и в буфер 210, как окончательный декодированный параметр КЛП. Если блок 209 выбора выбирает декодированный параметр КЛП следующего кадра, выводимый из буфера 210, то фактически не требуется выполнять всю обработку от узла 203 декодирования кодового вектора до узла 208 преобразования КЛП, и только обработку для обновления содержимого буферов 204-1-204-М необходимо выполнять.

Буфер 210 хранит декодированный параметр КЛП, выводимый из блока 209 выбора, в течение продолжительности одного кадра, и затем выводит этот декодированный параметр КЛП в блок 209 выбора. В результате декодированный параметр КЛП, выводимый из буфера 210 в блок 209 выбора, является декодированным параметром КЛП предыдущего кадра.

Далее будет подробно описана внутренняя конфигурация узла 203 декодирования кодового вектора, показанного на фиг.2, используя структурную схему на фиг.3.

В кодовой книге 301 генерируют кодовый вектор, идентифицированный кодом Ln КЛП текущего кадра, и выводят его на переключатель 309, и также генерируют кодовый вектор, идентифицированный кодом Ln+1 КЛП следующего кадра, и выводят его на усилитель 307. Как уже указано, в рекомендации ITU-T G.729 информацию, которая определяет набор коэффициентов предсказания МА, включает в себя код Ln КЛП, и в этом случае код Ln КЛП также используется для декодирования коэффициента предсказания МА в дополнение к декодированию кодового вектора, но описание этого опущено в данной работе. Кроме того, кодовая книга может иметь многоступенчатую конфигурацию и может иметь конфигурацию разделения. Например, в рекомендации ITU-T G.729 кодовая книга имеет двухступенчатую конфигурацию с разделением второй ступени на две. Вектор, выводимый из кодовой книги многоступенчатой конфигурации или конфигурации разделения, в общем случае не используется в том виде, в каком он существует, и если интервал между его элементами является чрезвычайно маленьким, или порядок элементов является обратным, то в общем случае выполняют обработку для обеспечения, чтобы минимальный интервал стал определенным значением, или для упорядочивания.

Вектора xn-1-xn-М квантованных остатков предсказания М предыдущих кадров вводят на соответствующие усилители 302-1-302-М и соответствующие усилители 305-1-305-М, соответственно.

Усилители 302-1-302-М умножают вводимые вектора xn-1-xn-М квантованных остатков предсказания на коэффициенты α0-αМ предсказания МА, соответственно, и выводят результаты на сумматор 303. Как указано выше, в случае рекомендации ITU-T G.729, существует два вида наборов коэффициентов предсказания МА, и информацию о том, который из них используется, включает в себя код Ln КЛП. Кроме того, когда удаляют кадр, для которого выполняют это умножение, фактически используют набор коэффициентов предсказания МА, используемый в предыдущем кадре, так как код Ln КЛП удаляют. Т.е. используется информация коэффициента предсказания МА, декодированная из кода Ln-1 КЛП предыдущего кадра. Если предыдущий кадр также является удаленным кадром, то будет использоваться информация кадра, расположенного перед ним.

Сумматор 303 вычисляет общую сумму векторов квантованных остатков предсказания после умножения на коэффициенты предсказания МА, выводимые из усилителей 302-1-302-М, и выводит вектор, который является результатом умножения, на сумматор 304.

Сумматор 304 вычитает вектор, выводимый из сумматора 303, из декодированного вектора yn-1 ЧСЛ предыдущего кадра, выводимого из буфера 207, и выводит вектор, который является результатом этого вычисления, на переключатель 309.

Вектор, выводимый из сумматора 303, является вектором ЧСЛ, предсказанным с помощью устройства предсказания МА-типа в текущем кадре, и сумматор 304 выполняет обработку для нахождения вектора квантованного остатка предсказания в текущем кадре, необходимого для генерации декодированного вектора ЧСЛ предыдущего кадра. Т.е. посредством усилителей 302-1-302-М, сумматора 303 и сумматора 304, вектор вычисляют так, чтобы декодированный вектор yn-1 ЧСЛ предыдущего кадра стал декодированным вектором yn ЧСЛ текущего кадра.

Усилители 305-1-305-М умножают вводимые вектора xn-1-xn-М квантованного остатка предсказания на весовые коэффициенты β1-βM, соответственно, и выводит результаты на сумматор 308. Усилитель 306 умножает декодированный вектор yn-1 ЧСЛ предыдущего кадра, выводимый из буфера 207, на весовой коэффициент β-1, и выводит результат на сумматор 308. Усилитель 307 умножает кодовый вектор xn+1, выводимый из кодовой книги 301, на весовой коэффициент β0, и выводит результат на сумматор 308.

Сумматор 308 вычисляет общую сумму векторов, выводимых из усилителей 305-1-305-М, усилителя 306 и усилителя 307, и выводит кодовый вектор, который является результатом этого вычисления, на переключатель 309. Т.е. сумматор 308 вычисляет вектор, выполняя взвешенное суммирование кодового вектора, идентифицированного кодом Ln+1 КЛП следующего кадра, декодированного вектора ЧСЛ предыдущего кадра и векторов квантованных остатков предсказания М предыдущих кадров.

Если код Bn удаления текущего кадра указывает, что «n-й кадр является обычным кадром», то переключатель 309 выбирает кодовый вектор, выводимый из кодовой книги 301, и выводит его как вектор xn квантованного остатка предсказания текущего кадра. С другой стороны, если код Bn удаления текущего кадра указывает, что «n-й кадр является удаленным кадром», то переключатель 309 дополнительно выбирает вектор, который будет выведен, в соответствии с тем, какую информацию имеет код Bn+1 удаления следующего кадра.

Т.е. если код Bn+1 удаления следующего кадра указывает, что «(n+1)-й кадр является удаленным кадром», то переключатель 309 выбирает вектор, выводимый из сумматора 304, и выводит его как вектор xn квантованного остатка предсказания текущего кадра. В этом случае обработка процесса генерации вектора из кодовой книги 301 и усилителей 305-1-305-М на сумматор 308 не должна выполняться.

С другой стороны, если код Bn+1 удаления следующего кадра указывает, что «(n+1)-й кадр является обычным кадром», то переключатель 309 выбирает вектор, выводимый из сумматора 308, и выводит его как вектор xn квантованного остатка предсказания текущего кадра. В этом случае обработка процесса генерации вектора из усилителей 302-1-302-М на сумматор 304 не должна выполняться.

Таким образом, согласно данному варианту осуществления, когда текущий кадр удаляют, если следующий кадр принимают обычным образом, то обработку маскирования квантованного остатка предсказания, декодированной для параметра ЧСЛ текущего кадра, выполняют посредством обработки взвешенного суммирования (обработки взвешенного линейного суммирования), в частности, для обработки маскирования, используя параметр, декодированный в прошлом, квантованный остаток предсказания кадра, принятого в прошлом, и квантованный остаток предсказания будущего кадра, и декодирование параметра ЧСЛ выполняют с помощью использования маскированной квантованного остатка предсказания. Таким образом можно обеспечивать более высокую эффективность маскирования, чем с помощью повторного использования прошлого декодированного параметра ЧСЛ.

Результаты выполнения обработки маскирования данного варианта осуществления будут теперь описаны, используя фиг.4 - фиг.7, которые представляют фактические примеры по сравнению с обычной технологией. На фиг.4 - фиг.7, ◯ обозначает декодированный квантованный остаток предсказания, • обозначает декодированный квантованный остаток предсказания, полученную с помощью обработки маскирования, ◊ обозначает декодированный параметр и ♦ обозначает декодированный параметр, полученный с помощью обработки маскирования.

Фиг.4 - чертеж, на котором показывают пример результата выполнения обычной обработки, когда нет удаленного кадра, в которой декодированный параметр yn n-го кадра находят посредством приведенного ниже Уравнения (1) из декодированного квантованного остатка предсказания. В Уравнении (1) cn является декодированным квантованным остатком предсказания n-го кадра.

Фиг.5 - чертеж, на котором показывают пример результата выполнения обработки маскирования данного варианта осуществления, и фиг.6 и 7 - чертежи, на которых показывают примеры результата выполнения обычной обработки маскирования. На фиг.5-7 предполагают, что n-й кадр удаляют, а другие кадры являются обычными кадрами.

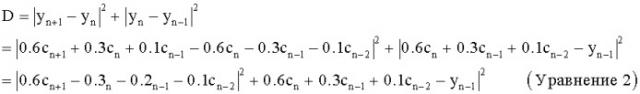

При обработке маскирования показанного на фиг.5 варианта осуществления квантованный остаток Cn предсказания, декодированный для удаленного n-го кадра, находят, используя приведенное ниже Уравнение (3), чтобы сделать сумму D (где D определяют с помощью приведенного ниже Уравнения (2)) расстояния между декодированным параметром yn-1 (n-1)-го кадра и декодированным параметром yn n-го кадра, и расстояния между декодированным параметром yn n-го кадра и декодированным параметром yn+1 (n+1)-го кадра минимальной, так, чтобы изменения декодированного параметра от одного кадра к другому стали незначительными.

Затем при обработке маскирования данного варианта осуществления находят декодированный параметр yn удаленного n-го кадра посредством приведенного выше Уравнения (1), используя декодированный квантованный остаток Cn предсказания удаленного n-го кадра, найденную посредством Уравнения (3). В результате, как ясно из сравнения фиг.4 и фиг.5, декодированный параметр yn, полученный посредством обработки маскирования данного варианта осуществления, имеет почти то же самое значение, как значение, полученное с помощью обычной обработки, когда нет удаленного кадра.

Напротив, при обычной обработке маскирования, показанной на фиг.6, когда n-й кадр удаляют, декодированный параметр yn-1 (n-1)-го кадра используется непосредственно в качестве декодированного параметра yn n-го кадра. Кроме того, при обычной обработке маскирования, показанной на фиг.6, декодированный квантованный остаток Cn предсказания n-го кадра находят посредством операции, обратной к приведенному выше Уравнению (1).

В данном случае, так как не учитывают изменения декодированного параметра, сопровождаемые изменениями декодированного квантованного остатка предсказания, как ясно из сравнения фиг.4 и фиг.6, декодированный параметр yn, полученный посредством обычной обработки маскирования на фиг.6, имеет значение, которое очень сильно отличается от значения, полученного посредством обычной обработки, когда нет удаленного кадра. Кроме того, так как декодированный квантованный остаток Cn предсказания n-го кадра также отличается, декодированный параметр yn+1 (n+1)-го кадра, полученный посредством обычной обработки маскирования на фиг.6, также имеет значение, отличающееся от значения, полученного посредством обычной обработки, когда нет удаленного кадра.

При обычной обработке маскирования, показанной на фиг.7, декодированный квантованный остаток предсказания находят посредством интерполяции, и когда n-й кадр удаляют, используют среднее значение декодированного квантованного остатка Cn-1 предсказания (n-1)-го кадра и декодированного квантованного остатка Cn+1 предсказания (n+1)-го кадра в качестве декодированного квантованного остатка Cn предсказания n-го кадра.

Затем при обычной обработке маскирования, показанной на фиг.7, находят декодированный параметр yn удаленного n-го кадра посредством приведенного выше Уравнения (1), используя декодированный квантованный остаток Cn предсказания, найденную посредством интерполяции.

В результате, как ясно из сравнени