Устройство и способ обработки изображения, обучающееся устройство и способ обучения и программа

Иллюстрации

Показать всеНастоящее изобретение относится к устройству и способу обработки изображения. Техническим результатом является расширение функциональных возможностей за счет надежной оценки того, является ли оцениваемое изображение изображением, оцениваемым как приемлемое для рассмотрения пользователем, то есть изображением, на котором объект виден четко. Модуль (21) извлечения объекта использует входное изображение для генерирования карты объекта, представляющую область, включающую в себя объект на входном изображении, и предоставляет карту объекта модулю (22) определения. Модуль (22) определения использует входное изображение и карту объекта, поступившую из модуля (21) извлечения объекта, для определения степени размытости области объекта на входном изображении, и вычисляет на основе этой степени размытости оценку в баллах для входного изображения. Эта оценка в баллах рассматривается как показатель для оценки степени того, насколько четко виден объект на входном изображении. Настоящее изобретение может быть применено к устройству захвата изображений. 3 н. и 2 з.п. ф-лы. 28 ил.

Реферат

Область техники, к которой относится изобретение

Настоящее изобретение относится к устройству и способу обработки изображения, обучающемуся устройству и способу обучения и программе. Более конкретно, настоящее изобретение относится к устройству и способу обработки изображений, обучающемуся устройству и способу обучения и программе, которые позволяют с легкостью выбирать изображение, которое оценивается как приемлемое для просмотра.

Уровень техники

В случае использования функции создания альбома для организации изображений, полученные посредством захвата изображений, таких как фотографии, или функции последовательной демонстрации изображений, пользователи должны выбирать изображения, подлежащие сохранению или отображению. Однако выбор необходимых изображений из большого количества изображений представляет собой трудную задачу.

Так, например, в качестве технологии для выбора так называемого наилучшего снимка, то есть изображения, оцениваемого как приемлемое для просмотра пользователем, из числа множества изображений, известна технология выбора наилучшего снимка из числа множества непрерывно снимаемых изображений (смотри, например, PTL 1).

В дополнение к этому, в качестве технологий, относящихся к изображениям, также известны технологии для оценки фотографического качества изображения на основе резкости изображения, качества изображения лица и наличия или отсутствия блика (смотри, например, PTL 2), и технология для обнаружения лица на изображении и выбора и извлечения оптимальной композиции в соответствии с результатом этого обнаружения (смотри, например, PTL 3).

Список упоминаемых документов

Патентная литература

PTL 1: публикация японской нерассмотренной патентной заявки номер 2006-311340

PTL 2: публикация японской нерассмотренной патентной заявки номер (перевод патентной заявки РСТ 2005-521927

PTL 3: публикация японской нерассмотренной патентной заявки 2007-27971

Сущность изобретения

Техническая задача

Однако в технологиях, описанных выше, было трудно надежно оценить то, является ли оцениваемое изображение изображением, оцениваемым как приемлемое для рассмотрения пользователем, то есть изображением, на котором объект виден четко.

Например, технология для выбора наилучшего снимка из числа непрерывно снимаемых изображений включает в себя оценку нерезкости и экспозиции всего изображения. Однако оценка нерезкости или экспозиции обычных изображений, отличных от изображений, полученных непрерывной съемкой, не обязательно может привести к более высокой оценке хорошо снятых изображений.

В общем, иначе говоря, на фотографии, на которой объект находится в фокусе на размытом фоне, объект виден четко и, следовательно, такая фотография часто является хорошо снятым кадром, именуемым наилучшим снимком. Однако использование технологии, описанной в PTL 1, для изображений, отличных от непрерывно снимаемых изображений, может привести к тому, что в качестве наилучшего снимка будет выбрано изображение, на котором в фокусе находится все изображение, а не изображение, на котором в фокусе находится объект, но фон является размытым.

В дополнение к этому, в технологии, описанной в PTL 2, поскольку качество изображения оценивается на основе предположения, что объектом является человеческое лицо, то в случае, при котором на изображении нельзя обнаружить лица, качество изображения оценивается с использованием резкости и наличия или отсутствия блика. Следовательно, в таком случае, изображение, на котором в фокусе находится все изображение, может иметь более высокую оценку, чем изображение, на котором в фокусе находится объект, но фон является размытым.

Кроме того, технология, описанная в PTL 3, делает возможной извлечение оптимальной композиции, но не позволяет оценить, является ли изображение хорошо снятым изображением. Кроме того, эта технология не позволяет извлечь оптимальную композицию в случае, при котором изображение не включает в себя в качестве объекта человеческое лицо.

Настоящее изобретение было сделано с учетом такой ситуации и предназначено для обеспечения более надежной оценки того, является ли оцениваемое изображение изображением, при котором объект виден четко.

Решение задачи

Устройство обработки изображений в первом аспекте настоящего изобретения включает в себя средство генерирования для генерирования на основе входного изображения, информации указания объекта для указания области объекта на входном изображении и средство определения для определения степени размытости объекта в области, включающей в себя объект на входном изображении, причем область используется в качестве целевой области для обработки с использованием информации указания объекта и входного изображения.

Средство генерирования может быть снабжено средством генерирования информационной карты для извлечения значения признака для признака области объекта из входного изображения и генерирования информационной карты, представляющей значение признака в каждой области входного изображения, и средством генерирования информации указания объекта для генерирования информации указания объекта посредством выполнения взвешенного суммирования множества информационных карт, представляющих значение признака для указанного признака, которые отличаются друг от друга.

Средство определения можно заставить определять четкость контура в области объекта, чтобы тем самым определить степень размытости объекта.

Средство генерирования информационной карты можно заставить извлекать значение признака из входного изображения для генерирования изображения признака, представляющего значение признака в каждой области входного изображения, и можно дополнительно заставить генерировать множество изображений признака, имеющих разрешения, отличающиеся друг от друга, на основе изображения признака и определять разность между множеством изображений признака, чтобы тем самым сгенерировать информационную карту.

Способ обработки изображений или программа в первом аспекте настоящего изобретения включает в себя этапы, на которых: генерируют, на основе входного изображения, информацию указания объекта для указания области объекта на входном изображении и определяют степень размытости объекта в области, включающей в себя объект на входном изображении, причем область используется в качестве целевой области для обработки с использованием информации указания объекта и входного изображения.

В первом аспекте настоящего изобретения на основе входного изображения генерируется информация указания объекта для указания области объекта на входном изображении, и информация указания объекта и входное изображение используются для определения степени размытости объекта в области, включающей в себя объект на входном изображении, причем область используется в качестве целевой области для обработки.

Обучающееся устройство во втором аспекте настоящего изобретения представляет собой обучающееся устройство, которое определяет весовой коэффициент, используя обучение на основе нейронной сети, причем весовой коэффициент используется для генерирования карты объекта для указания области объекта на изображении, включающее в себя: средство генерирования информационной карты, предназначенное для извлечения значения признака для признака области объекта из обучающего изображения, которое включает в себя объект и которое используется для обучения, и генерирования информационной карты, представляющей значение признака в каждой области обучающего изображения; средство генерирования карты объекта для генерирования карты объекта посредством выполнения взвешенного суммирования, используя весовой коэффициент, множества информационных карт, представляющих значение признака для этого признака, которые отличаются друг от друга, средство вычисления величины изменения весового коэффициента для вычисления величины изменения, на которую должен быть изменен весовой коэффициент, с использованием карты объекта и ярлыка изображения, который определен заранее и который представляет область объекта на обучающем изображении, и средство обновления для суммирования величины изменения с весовым коэффициентом и обновления весового коэффициента.

Способ обучения или программа во втором аспекте настоящего изобретения представляет собой способ обучения или программу для определения весового коэффициента с использованием обучения на основе нейронной сети, причем весовой коэффициент используется для генерирования карты объекта для указания области объекта на изображении, включающие в себя этапы, на которых: извлекают значения признака для признака области объекта из обучающего изображения, которое включает в себя объект и которое используется для обучения, и генерируют информационную карту, представляющую значение признака в каждой области обучающего изображения; генерируют карту объекта посредством выполнения взвешенного суммирования, используя весовой коэффициент, множества информационных карт, представляющих значение признака для этого признака, которые отличаются друг от друга; вычисляют величину изменения, на которую должен быть изменен весовой коэффициент, используя карту объекта и ярлык изображения, который определен заранее и который представляет область объекта на обучающем изображении; и суммируют величину изменения с весовым коэффициентом и обновляют весовой коэффициент.

Во втором аспекте настоящего изобретения в ходе процесса обучения для определения весового коэффициента с использованием обучения на основе нейронной сети, причем весовой коэффициент используется для генерирования карты объекта для указания области объекта на изображении, из обучающего изображения, которое включает в себя объект и которое используется для обучения, извлекают значение признака для признака области объекта и генерируют информационную карту, представляющую значение признака в каждой области обучающего изображения; генерируют карту объекта, выполняя взвешенное суммирование, используя весовой коэффициент, множества информационных карт, представляющих значение признака для этого признака, которые отличаются друг от друга; вычисляют величину изменения, на которую должен быть изменен весовой коэффициент с использованием карты объекта и ярлыка изображения, который определен заранее и который представляет область объекта на обучающем изображении; и суммируют величину изменения с весовым коэффициентом и обновляют весовой коэффициент.

Полезные результаты изобретения

В соответствии с первым аспектом настоящего изобретения имеется возможность оценивать изображение. В частности, согласно первому аспекту настоящего изобретения имеется возможность с более высокой надежностью выбирать изображение, на котором, как оценивается, объект виден четко.

В дополнение к этому, в соответствии со вторым аспектом настоящего изобретения имеется возможность определять весовой коэффициент, который используется для оценки изображения. В частности, согласно второму аспекту настоящего изобретения имеется возможность предоставить весовой коэффициент, который используется для более надежного выбора изображения, на котором, как оценивается, объект виден четко.

Краткое описание чертежей

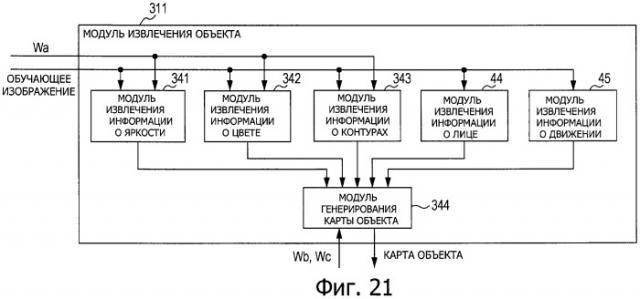

Фиг.1 представляет собой схему, иллюстрирующую приведенную в качестве примера конфигурацию варианта осуществления устройства обработки изображений, к которому применимо настоящее изобретение.

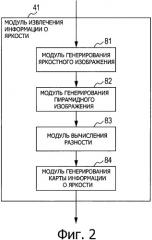

Фиг.2 представляет собой схему, иллюстрирующую приведенную в качестве примера конфигурацию модуля извлечения информации о яркости.

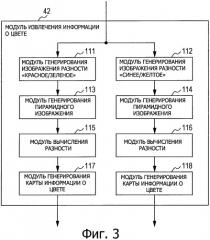

Фиг.3 представляет собой схему, иллюстрирующую приведенную в качестве примера конфигурацию модуля извлечения информации о цвете.

Фиг.4 представляет собой схему, иллюстрирующую приведенную в качестве примера конфигурацию модуля извлечения информации о контурах.

Фиг.5 представляет собой схему, иллюстрирующую приведенную в качестве примера конфигурацию модуля извлечения информации о лице, показанного на фиг.1.

Фиг.6 представляет собой схему, иллюстрирующую приведенную в качестве примера конфигурацию модуля извлечения информации о движении.

Фиг.7 представляет собой схему, иллюстрирующую приведенную в качестве примера конфигурацию модуля определения размытости.

Фиг.8 представляет собой блок-схему алгоритма, поясняющую процесс оценки изображения.

Фиг.9 представляет собой блок-схему алгоритма, поясняющую процесс извлечения информации о яркости.

Фиг.10 представляет собой блок-схему алгоритма, поясняющую процесс извлечения информации о цвете.

Фиг.11 представляет собой блок-схему алгоритма, поясняющую процесс извлечения информации о контурах.

Фиг.12 представляет собой блок-схему алгоритма, поясняющую процесс извлечения информации о лице.

Фиг.13 представляет собой блок-схему алгоритма, поясняющую процесс извлечения информации о движении.

Фиг.14 представляет собой блок-схему алгоритма, поясняющую процесс определения размытости.

Фиг.15 представляет собой схему, поясняющую генерирование карты контуров.

Фиг.16 представляет собой схему, поясняющую генерирование локальных максимумов.

Фиг.17 представляет собой схему, поясняющую примеры структуры контура.

Фиг.18 представляет собой схему, дающую общее представление об обучении на основе нейронной сети.

Фиг.19 представляет собой схему, дающую общее представление об обучении на основе нейронной сети.

Фиг.20 представляет собой схему, иллюстрирующую приведенную в качестве примера конфигурацию варианта осуществления обучающегося устройства, в котором применено настоящее изобретение.

Фиг.21 представляет собой схему, иллюстрирующую приведенную в качестве примера конфигурацию модуля извлечения объекта.

Фиг.22 представляет собой схему, иллюстрирующую приведенную в качестве примера конфигурацию модуля извлечения информации о яркости.

Фиг.23 представляет собой схему, иллюстрирующую приведенную в качестве примера конфигурацию модуля извлечения информации о цвете.

Фиг.24 представляет собой схему, иллюстрирующую приведенную в качестве примера конфигурацию модуля извлечения информации о контурах.

Фиг.25 представляет собой схему, иллюстрирующую приведенную в качестве примера конфигурацию модуля вычисления весовых коэффициентов.

Фиг.26 представляет собой блок-схему алгоритма, поясняющую процесс обучения.

Фиг.27 представляет собой схему, иллюстрирующую приведенную в качестве примера конфигурацию системы оценки изображений.

Фиг.28 представляет собой схему, иллюстрирующую приведенную в качестве примера конфигурацию компьютера.

Описание вариантов осуществления изобретения

Далее со ссылкой на чертежи будут объяснены варианты осуществления, к которым применяется настоящее изобретение.

Конфигурация устройства обработки изображений

Фиг.1 представляет собой блок-схему, иллюстрирующую приведенную в качестве примера конфигурацию варианта осуществления устройства обработки изображений, к которому применимо настоящее изобретение.

Устройство (11) обработки изображений установлено, например, в устройстве захвата изображения, таком как фотокамера, и выполняет оценку входного изображения, которое было захвата. При оценке входного изображения изображение, для которого, согласно оценке, объект на входном изображении не расфокусирован или размыт, но виден четко, расценивается как хорошо снятое изображение, а именно как наилучший снимок. Наоборот, изображение с размытым объектом или изображение, которое выглядит передержанным, расценивается как плохо снятое изображение, а именно как плохой снимок.

Таким образом, входное изображение, для которого, согласно оценке, объект выглядит более четко, расценивается как изображение, которое более приемлемо для рассмотрения пользователем, и ему дается более высокое значение оценки (оценки в баллах). Затем, например, в случае, при котором входное изображение имеет значение оценки, большее некоторого заданного порогового значения или равное ему, входное изображение расценивается как наилучший снимок.

Устройство (11) обработки изображений выполнено с возможностью использования модуля (21) извлечения объекта и модуля (22) определения, и на модуль (21) извлечения объекта и модуль (22) определения подается входное изображение, полученное захватом изображения.

Модуль (21) извлечения объекта обнаруживает объект на поданном входном изображении, генерирует карту объекта, которая представляет собой информацию для указания области, включающей в себя объект на входном изображении, и подают карту объекта на модуль (22) определения. В данном случае обнаружение объекта выполняется в предположении, что объектом является предмет на входном изображении, который признан привлекающим внимание пользователя в случае, когда пользователь смотрит на входное изображение, то есть предмет, на который, согласно оценке, пользователь направляет свой взгляд. Следовательно, термин "объект" не обязательно ограничивается человеком.

Модуль (21) извлечения объекта выполнен с использованием модуля (41) извлечения информации о яркости, модуля (42) извлечения информации о цвете, модуля (43) извлечения информации о контурах, модуля (44) извлечения информации о лице, модуля (45) извлечения информации о движении и модуля (46) генерирования карты объекта.

Модуль (41) извлечения информации о яркости генерирует на основании поданного входного изображения, карту информации о яркости, указывающую информацию о яркости в каждой области входного изображения, и предоставляет карты информации о яркости модулю (46) генерирования карты объекта. Модуль (42) извлечения информации о цвете генерирует на основании поданного входного изображения карту информации о цвете, указывающую информацию о цветах в каждой области входного изображения, и предоставляет карты информации о цвете модулю (46) генерирования карты объекта.

Модуль (43) извлечения информации о контурах генерирует на основании поданного входного изображения карту информации о контурах, указывающую информацию о контурах в каждой области входного изображения, и предоставляет карты информации о контурах модулю (46) генерирования карты объекта. Модуль (44) извлечения информации о лице генерирует на основании поданного входного изображения карту информации о лице, указывающую информацию о человеческом лице как объекте в каждой области входного изображения, и предоставляет карты информации о лице модулю (46) генерирования карты объекта. Модуль (45) извлечения информации о движении генерирует на основании поданного входного изображения карту информации о движении, указывающую информацию о движении в каждой области входного изображения, и предоставляет карты информации о движении модулю (46) генерирования карты объекта.

Отметим, что далее карты: от карты информации о яркости до карт информации о движении, выводимые из модулей: от модуля (41) извлечения информации о яркости до модуля (45) извлечения информации о движении, будут также именоваться просто как информационные карты, если только их не требуется по отдельности отличить друг от друга. Информация, входящая в состав этих информационных карт, считается элементами информации, указывающими значения признаков для большего количества признаков, входящих в состав области, включающей в себя объект, и размещение элементов информации в соответствии с каждой областью входного изображения называется информационной картой. Таким образом, можно сказать, что информационная карта представляет собой информацию, указывающую значение признака в каждой области входного изображения.

Таким образом, область на входном изображении, соответствующая области с более высоким объемом информации на каждой информационной карте, то есть область с более высоким значением признака, становится областью, которая с большей вероятностью включает в себя объект, и отдельные информационные карты позволяют описать область, включающую в себя объект на входном изображении.

Модуль (46) генерирования карты объекта линейным образом объединяет карты информации о яркости, карты информации о цвете, карты информации о контурах, карты информации о лицах и карты информации о движении, предоставляемые из модулей: от модуля (41) извлечения информации о яркости до модуля (45) извлечения информации о движении для генерирования карты объекта. Иначе говоря, информация (значения признаков) карт: от карт информации о яркости до карт информации о движении, по каждой области подвергается взвешенному суммированию для каждой из областей, расположенных в одном и том же месте, и генерируется карта объекта. Модуль (46) генерирования карты объекта предоставляет сгенерированную карту объекта модулю (22) определения.

Модуль (22) определения вычисляет оценку в баллах, служащую в качестве показателя для оценки входного изображения с использованием предоставляемого входного изображения и карты объекта, предоставляемой модулем (46) генерирования карты объекта, входящим в состав модуля (21) извлечения объекта, и выводит оценку в баллах. Модуль (22) определения содержит модуль (51) определения размытости, модуль (52) определения экспозиции, модуль (53) определения баланса белого и модуль (54) вычисления оценки в баллах.

Модуль (51) определения размытости использует предоставляемое входное изображение и карту объекта, предоставляемую из модуля (46) генерирования карты объекта, для определения степени размытости объекта в области, включающей в себя объект на входном изображении, то есть области, используемой в качестве целевой области для обработки, и предоставляет результат этого определения модулю (54) вычисления оценки в баллах.

Модуль (52) определения экспозиции определяет на основании поданного входного изображения степень точности экспозиции на всем входном изображении и предоставляет результат этого определения модулю (54) вычисления оценки в баллах. В дополнение к этому, модуль (53) определения баланса белого определяет на основании входного изображения степень точности баланса белого на всем входном изображении и предоставляет результат этого определения модулю (54) вычисления оценки в баллах. Модуль (54) вычисления оценки в баллах вычисляет на основании результатов определения, предоставленных соответственно из модуля (51) определения размытости, модуля (52) определения экспозиции и модуля (53) определения баланса белого, оценку в баллах входного изображения и выводит оценку в баллах.

Далее со ссылкой на фиг.2-7 приводится более подробное пояснение конфигураций модулей: от модуля (41) извлечения информации о яркости до модуля (45) извлечения информации о движении и модуля (51) определения размытости, показанных на фиг.1.

Фиг.2 представляет собой блок-схему, иллюстрирующую приведенную в качестве примера конфигурацию модуля (41) извлечения информации о яркости.

Модуль (41) извлечения информации о яркости содержит модуль (81) генерирования яркостного изображения, модуль (82) генерирования пирамидного изображения, модуль (83) вычисления разности и модуль (84) генерирования карты информации о яркости.

Модуль (81) генерирования изображения яркости использует предоставляемое входное изображение для генерирования яркостного изображения, на котором в качестве пиксельного значения для пикселя используется значение яркости пикселя на входном изображении, и предоставляет это яркостное изображение модулю (82) генерирования пирамидного изображения. При этом значение пикселя требуемого пикселя на яркостном изображении представляет значение яркости пикселя, расположенного на входном изображении в том же месте, что и место расположения этого пикселя.

Модуль (82) генерирования пирамидного изображения генерирует с использованием яркостного изображения, предоставленного из модуля (81) генерирования яркостного изображения, множество яркостных изображений, имеющих разрешения, отличающиеся друг от друга, и предоставляет эти яркостные изображения модулю (83) вычисления разности в качестве пирамидных изображений яркости.

Например, генерируются пирамидные изображения в восемь слоев разрешений, имеющих уровни от L1 до L8, и предполагается, что пирамидные изображения с разрешениями, имеющими уровни от L1 до L8, упорядочены в порядке убывания от пирамидного изображения с разрешением, имеющим уровень L1, являющийся самым высоким уровнем.

В этом случае яркостное изображение, сгенерированное модулем (81) генерирования яркостного изображения, считается пирамидным изображением уровня L1. В дополнение к этому, среднее значение значений пикселей для четырех смежных пикселей на пирамидном изображении уровня Li (где 1≤i≤7) считается значение пикселя для одного пикселя, соответствующего этим пикселям, на пирамидном изображении уровня L(i+1). Таким образом, пирамидное изображение уровня L(i+1) представляет собой изображение, имеющее горизонтальные и вертикальные размеры, которые составляют половину от пирамидного изображения уровня Li (в случае, когда значения неделимы, они округляются).

Модуль (83) вычисления разности выбирает два пирамидных изображения в различных слоях из множества пирамидных изображений, предоставляемых из модуля (82) генерирования пирамидного изображения, и определяют разность между выбранными пирамидными изображениями для генерирования изображения разности яркостей. Отметим, что поскольку пирамидные изображения в соответствующих слоях отличаются по размеру (количеству пикселей), то во время генерирования изображения разности меньшее пирамидное изображение подвергается повышающему преобразованию в соответствии с большим пирамидным изображением.

Когда сгенерировано заданное количество изображений разности яркостей, модуль (83) вычисления разности нормирует эти сгенерированные разностные изображения и предоставляет результаты модулю (84) генерирования карты информации о яркости. Модуль (84) генерирования карты информации о яркости генерирует на основании разностных изображений, предоставленных из модуля (83) вычисления разности, карты информации о яркости и предоставляет эти карты информации о яркости модулю (46) генерирования карты объекта.

Фиг.3 представляет собой блок-схему, иллюстрирующую приведенную в качестве примера конфигурацию модуля (42) извлечения информации о цвете, показанного на фиг.1.

Модуль (42) извлечения информации о цвете содержит модуль (111) генерирования изображения разности "красное/зеленое", модуль (112) генерирования изображения разности "синее/желтое", модуль (113) генерирования пирамидного изображения, модуль (114) генерирования пирамидного изображения, модуль (115) вычисления разности, модуль (116) вычисления разности, модуль (117) генерирования карты информации о цвете и модуль (118) генерирования карты информации о цвете.

Модуль (111) генерирования изображения разности "красное/зеленое" использует предоставленное входное изображение для генерирования изображения разности "красное/зеленое", на котором в качестве пиксельного значения для пикселя используется разность между R (красной) составляющей и G (зеленой) составляющей пикселя на входном изображении, и предоставляет это изображение разности "красное/зеленое" модулю (113) генерирования пирамидного изображения. Значение пикселя для требуемого пикселя на изображении разности "красное/зеленое" представляет значение разности между красной составляющей и зеленой составляющей пикселя, расположенного на входном изображении в том же самом месте, что и место расположения этого пикселя.

Модуль (112) генерирования изображения разности "синее/желтое" использует предоставленное входное изображение для генерирования изображения разности "синее/желтое", на котором разность между В (синей) составляющей и Y (желтой) составляющей пикселя на входном изображении используется в качестве пиксельного значения для пикселя, и предоставляет это изображение разности "синее/желтое" модулю (114) генерирования пирамидного изображения. Значение пикселя для требуемого пикселя на изображении разности "синее/желтое" представляет значение разности между В (синей) составляющей и Y (желтой) составляющей пикселя, расположенного на входном изображении в том же месте, что и место расположения этого пикселя.

Модуль (113) генерирования пирамидного изображения и модуль (114) генерирования пирамидного изображения используют изображение разности "красное/зеленое" и изображение разности "синее/желтое", предоставленные из модуля (111) генерирования изображения разности "красное/зеленое" и модуля (112) генерирования изображения разности "синее/желтое", для генерирования множества изображений разности "красное/зеленое", имеющих разрешения, отличающиеся друг от друга, и множества изображений разности "синее/желтое", имеющих разрешения, отличающиеся друг от друга. Затем модуль (113) генерирования пирамидного изображения и модуль (114) генерирования пирамидного изображения предоставляют эти сгенерированные изображения разности "красное/зеленое" и изображения разности "синее/желтое" модулю (115) вычисления разности и модулю (116) вычисления разности в качестве пирамидных изображений разностей "красное/зеленое" и пирамидных изображений разностей "синее/желтое".

В качестве пирамидных изображений разностей "красное/зеленое" и пирамидных изображений разностей "синее/желтое", аналогично случаю пирамидных изображений яркости, генерируются, например, пирамидные изображения в восемь слоев с разрешениями, имеющими уровни соответственно от L1 до L8.

Модуль (115) вычисления разности и модуль (116) вычисления разности выбирают два пирамидных изображения в различных слоях из множества пирамидных изображений, предоставляемых из модуля (113) генерирования пирамидного изображения и модуля (114) генерирования пирамидного изображения, и определяют разность между выбранными пирамидными изображениями для генерирования изображения разности для разности "красное/зеленое" и разности "синее/желтое". Отметим, что поскольку пирамидные изображения в соответствующих слоях отличаются по размеру, то во время генерирования разностного изображения меньшее пирамидное изображение подвергается повышающему преобразованию, так чтобы иметь тот же размер, что и большее пирамидное изображение.

Когда сгенерировано заданное количество изображений разности для разностей "красное/зеленое" и заданное количество изображений разности для разностей "синее/желтое", модуль (115) вычисления разности и модуль (116) вычисления разности нормируют эти сгенерированные изображения разности и предоставляют результаты модулю (117) генерирования карты информации о цвете и модулю (118) генерирования карты информации о цвете. Модуль (117) генерирования карты информации о цвете и модуль (118) генерирования карты информации о цвете генерируют на основании изображений разности, предоставляемых из модуля (115) вычисления разности и модуля (116) вычисления разности, карты информации о цвете и предоставляет эти карты информации о цвете модулю (46) генерирования карты объекта. Модуль (117) генерирования карты информации о цвете генерирует карты информации о цвете для разностей "красное/зеленое", а модуль (118) генерирования карты информации о цвете генерирует карты информации о цвете для разностей "синее/желтое".

Фиг.4 представляет собой блок-схему, иллюстрирующую приведенную в качестве примера конфигурацию модуля (43) извлечения информации о контурах, показанного на фиг.1.

Модуль (43) извлечения информации о контурах содержит модули 141-144 генерирования изображений контуров, модули 145-148 генерирования пирамидных изображений, модули 149-152 вычисления разности и модули 153-156 генерирования карты информации о контурах.

Модули 141-144 генерирования изображений контуров выполняют процесс фильтрования на предоставленном входном изображении с использованием фильтра Габора для генерирования, например, изображения контуров, в которых в качестве пиксельного значения для пикселя используется контрастность контура (edge strength) в направлениях 0 градусов, 45 градусов, 90 градусов и 135 градусов, и предоставляют изображения контуров модулям 145-148 генерирования пирамидных изображений.

Например, значение пикселя для требуемого пикселя на изображении контура, сгенерированном модулем (141) генерирования изображения контуров, представляет контрастность контура в направлении 0 градусов для пикселя, который расположен на входном изображении в том же месте, что и место расположения этого пикселя. Отметим, что каждое направление контура относится к направлению, представленному угловой составляющей в функциях Габора, образующих фильтр Габора.

Модули 145-148 генерирования пирамидных изображений генерируют с использованием изображений контуров в соответствующих направлениях, предоставляемых из модулей 141-144 генерирования изображений контуров, множество изображений контуров, имеющих разрешения, отличающиеся друг от друга. Затем модули 145-148 генерирования пирамидных изображений предоставляют эти сгенерированная изображения контуров в соответствующих направлениях модулям 149-152 вычисления разности в качестве пирамидных изображений в соответствующих направлениях контуров.

В качестве пирамидных изображений соответствующих направлений контуров, аналогично случаю пирамидных изображений яркости, генерируются, например, пирамидные изображения в восемь слоев с разрешениями, имеющими соответственно уровни от L1 до L8.

Модули 149-152 вычисления разности выбирают два пирамидных изображения в различных слоях из множества пирамидных изображений, предоставляемых из модулей 145-148 генерирования пирамидных изображений, и определяют разность между выбранными пирамидными изображениями для генерирования изображений разности в соответствующих направлениях контуров. Отметим, что поскольку пирамидные изображения в соответствующих слоях отличаются по размеру, то во время генерирования изображения разности меньшее пирамидное изображение подвергается повышающему преобразованию.

Когда сгенерировано заданное количество изображений в соответствующих направлениях, модули 149-152 вычисления разности нормируют эти сгенерированные изображения разности и предоставляют результаты модулям 153-156 генерирования карт информации о контурах. Модули 153-156 генерирования карт информации о контурах генерируют на основании изображений разности, предоставляемых из модулей 149-152 вычисления разности, карты информации о контурах и предоставляют эти карты информации о контурах модулю (46) генерирования карты объекта.

Фиг.5 представляет собой блок-схему, иллюстрирующую приведенную в качестве примера конфигурацию модуля (44) извлечения информации о лице, показанном на фиг.1.

Модуль (44) извлечения информации о лице содержит модуль (181) обнаружения лица и модуль (182) генерирования карты информации о лице.

Модуль (181) обнаружения лица обнаруживает область человеческого лица, служащего в качестве объекта, на предоставленном входном изображении и предоставляет результат обнаружения модулю (182) генерирования карты информации о лице. Модуль (182) генерирования карты информации о лице генерирует на основании результата обнаружения предоставленного из модуля (181) обнаружения лица карту информации о лице, и предоставляет карту информации о лице модулю (46) генерирования карты объекта.

Фиг.6 представляет собой блок-схему, иллюстрирующую приведенную в качестве примера конфигурацию модуля (45) извлечения информации о движении, показанного на фиг.1.

Модуль (45) извлечения информации о движении содержит модуль (211) извлечения локального вектора движения, модуля (212) извлечения глобального вектора движения, модуля (213) вычисления разности и модуля (214) генерирования карты информации о движении.

Модуль (211) извлечения локального вектора движения использует предоставленное входное изображение и другое входное изображение, имеющее время захвата изображения, отличное от этого входного изображения, для определения вектора движения каждого пикселя на входном изображении в качестве локального вектора движения и предоставляет эти век