Устройство и способ пользовательского ввода для управления отображаемой информацией

Иллюстрации

Показать всеИзобретение относится к компьютерной технике, а именно к системам пользовательского ввода для управления отображаемой информацией. Техническим результатом является обеспечение визуализации смещения элементов отображения относительно уровня поверхности экрана в направлении z, перпендикулярном поверхности экрана. Предложено устройство для управления отображаемой информацией при пользовательском вводе. Устройство содержит процессор, память, содержащую компьютерный программный код. Устройство выполнено с возможностью приема информации о наличии объекта в непосредственной близости от поверхности сенсорного экрана. А также устройство выполнено с возможностью адаптации элемента отображения на основании расстояния между указанным объектом и поверхностью экрана, при этом осуществляется визуализация размещения указанного элемента отображения по существу на уровне поверхности сенсорного экрана в ответ на обнаружение касания объектом поверхности сенсорного экрана. 5 н. и 15 з.п. ф-лы, 8 ил.

Реферат

ОБЛАСТЬ ТЕХНИКИ

Настоящее изобретение относится к устройству и способу пользовательского ввода для управления отображаемой информацией.

ПРЕДПОСЫЛКИ СОЗДАНИЯ ИЗОБРЕТЕНИЯ

Сенсорные экраны широко используются во многих портативных электронных устройствах, например устройствах PDA (Personal Digital Assistant, персональный цифровой помощник), планшетных компьютерах, сенсорных поверхностях и мобильных устройствах. Управление сенсорными экранами осуществляется с помощью указывающего устройства (или стилуса) и/или пальца. Обычно такие устройства также содержат традиционные кнопки для выполнения определенных операций.

Для портативных и переносных устройств также были разработаны стереоскопические или трехмерные (3D) дисплеи, способные отображать стереоскопические изображения. Стереоскопические дисплеи могут использоваться для отображения элементов пользовательского интерфейса (User Interface, UI), так чтобы пользователь воспринимал трехмерное (three-dimensional, 3D) изображение. Внедрение стереоскопических дисплеев также приводит к постановке новых задач и обеспечению новых возможностей при разработке технологий взаимодействия с пользователем.

СУЩНОСТЬ ИЗОБРЕТЕНИЯ

Различные аспекты примеров настоящего изобретения охарактеризованы в формуле изобретения.

Согласно одному из аспектов предложено устройство, включающее: по меньшей мере один процессор и по меньшей мере одну память, содержащую компьютерный программный код, при этом указанная по меньшей мере одна память и указанный компьютерный программный код конфигурированы для обеспечения, совместно с указанным по меньшей мере одним процессором, выполнения указанным устройством по меньшей мере следующего: приема информации о наличии объекта в непосредственной близости от поверхности сенсорного экрана, обнаружения элемента отображения, связанного в текущий момент времени с указанным объектом, при этом осуществляется визуализация смещения указанного элемента отображения относительно уровня поверхности экрана в направлении z, по существу перпендикулярном поверхности экрана, и адаптации элемента отображения на основании расстояния между указанным объектом и поверхностью экрана, при этом осуществляется визуализация размещения указанного элемента отображения по существу на уровне поверхности сенсорного экрана в ответ на обнаружение касания объектом поверхности сенсорного экрана.

Согласно одному из аспектов предложен способ, включающий: прием устройством информации о наличии объекта в непосредственной близости от поверхности сенсорного экрана, обнаружение элемента отображения, связанного в текущий момент времени с указанным объектом, при этом визуализируется смещение указанного элемента отображения относительно уровня поверхности экрана в направлении z, по существу перпендикулярном поверхности экрана, и адаптацию элемента отображения на основании расстояния между указанным объектом и поверхностью экрана, при этом визуализируется размещение указанного элемента отображения по существу на уровне поверхности сенсорного экрана в ответ на обнаружение касания объектом поверхности сенсорного экрана.

Согласно примеру осуществления настоящего изобретения управление операцией отображения для адаптации визуализированного смещения элемента отображения в направлении z осуществляют на основании значения диспаратности, зависящего от обнаруженного расстояния.

Настоящее изобретение и различные варианты его осуществления обеспечивают ряд преимуществ, которые станут очевидны из представленного далее подробного описания.

КРАТКОЕ ОПИСАНИЕ ЧЕРТЕЖЕЙ

Для более полного понимания примеров осуществления настоящего изобретения далее приведено подробное описание совместно с сопровождающими чертежами, на которых:

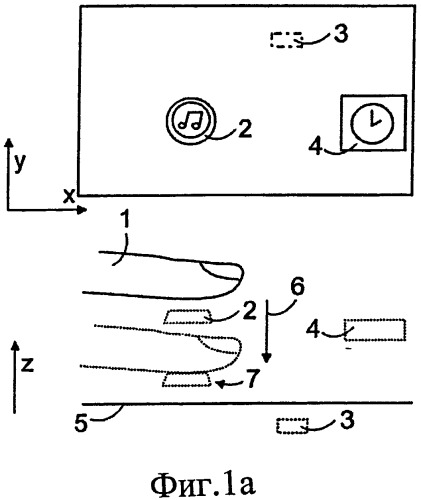

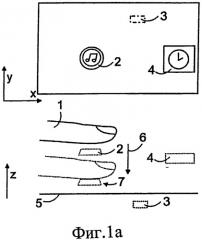

фиг.1а и 1b иллюстрируют управление внешним видом элементов отображения стереоскопического дисплея в соответствии с примером осуществления настоящего изобретения;

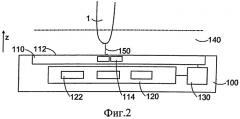

фиг.2 является упрощенной структурной схемой вида сбоку устройства в соответствии с примером осуществления настоящего изобретения;

фиг.3-5 иллюстрируют способы в соответствии с примерами осуществления настоящего изобретения;

фиг.6 иллюстрирует электронное устройство в соответствии с примером осуществления настоящего изобретения и

фиг.7 иллюстрирует способ в соответствии с примером осуществления настоящего изобретения.

ПОДРОБНОЕ ОПИСАНИЕ

На фиг.1а проиллюстрированы элементы 2, 3, 4 отображения, такие как графические элементы или значки, представляющие элементы данных и/или доступные действия, виртуального трехмерного изображения дисплея электронного устройства, например, переносного мобильного устройства. Верхнее изображение иллюстрирует вид спереди экрана в направлениях x и y, по существу параллельных поверхности 5 экрана, а нижнее изображение иллюстрирует вид сбоку в направлении z, по существу перпендикулярном поверхности 5 экрана. Элементы 2-4 отображения могут отображаться стереоскопическим дисплеем с обеспечением 3D-эффекта, так чтобы по меньшей мере некоторые элементы отображения размещались на разных уровнях относительно уровня поверхности сенсорного экрана, например один элемент 2 отображения на первом уровне и другой элемент 3 отображения на втором уровне относительно уровня 5 поверхности сенсорного экрана. Таким образом, может быть обеспечена визуализация смещения по меньшей мере некоторых элементов отображения относительно уровня поверхности экрана в направлении z. Необходимо понимать, что элементы 2-4 отображения могут иметь различный вид, и в некоторых вариантах осуществления их форма может быть изменена пользователем. Например, элементы 2 и 4 отображения могут быть «плавающими» над поверхностью 5 экрана, а элемент 3 отображения может быть показан как элемент, размещенный на заднем плане, ниже уровня 5 поверхности экрана.

В примерах осуществления настоящего изобретения «зависание» (hovering) объекта ввода используется для управления внешним видом и/или положением одного или более элементов 2-4 отображения. «Зависание» относится, в общем, к размещению объекта 1 ввода, такого как палец или стилус, в непосредственной близости от поверхности 5 сенсорного экрана, но без контакта с ней. Показанное положение элемента(-ов) отображения в направлении z может быть адаптировано на основе обнаруженного расстояния от указанного объекта до поверхности 3 экрана. Это относится, в общем, к любому типу операции отображения, облегчающему восприятие элемента отображения, приближающегося к поверхности экрана или отдаляющегося от нее. Обнаружение расстояния может включать обнаружение, например, на основе конкретного оцененного значения расстояния или на основе значения сигнала, зависящего от расстояния до объекта. Таким образом, на основе повторяющегося и/или непрерывного контроля расстояния до объекта 1 может быть обеспечено управление элементом (-ами) отображения в отношении перемещения пальца по направлению к сенсорному экрану или от него.

Среди отображаемых элементов 2-4 отображения 3D-изображения один или более элементов 2-4 отображения могут быть обнаружены в качестве целевых объектов на основе положения объекта 1. Управление операцией отображения для обеспечения перемещения 6 целевого элемента 2 отображения может быть выполнено в соответствии с обнаруженным изменением расстояния до объекта 1. Если объект 1 приближается к поверхности 3 экрана, посредством 3D-эффектов может быть визуализировано перемещение 6, 7 элемента отображения по направлению к поверхности 5 сенсорного экрана. Как показано на фиг.1b, если обнаружено, что объект 1 ввода касается поверхности 3 сенсорного экрана, может быть визуализировано 8 размещение целевого элемента 2 отображения в плоскости поверхности экрана. Таким образом, может быть обеспечено восприятие пользователем соприкосновения пальца и элемента отображения в направлении z на уровне поверхности экрана. Это позволяет улучшить восприятие касания и обеспечить большую интуитивность и интерактивность ощущений пользователя, взаимодействующего с объектами графического пользовательского интерфейса (Graphical User Interface, GUI) 3D-изображения на различных уровнях глубины. Кроме того, без ограничения объема настоящего изобретения, заданного формулой изобретения, может быть обеспечено уменьшение неприятного ощущения, возникающего у некоторых пользователей при попытке выбрать значки, появляющиеся выше или ниже уровня поверхности экрана, путем касания поверхности экрана.

На фиг.2 показан пример устройства 100, в котором может быть обеспечено управление элементом отображения на основе «зависания». Устройство 100 может быть периферийным устройством или может быть интегрировано в электронное устройство. Примеры электронных устройств включают любое пользовательское электронное устройство, например компьютеры, медиаплееры, беспроводные оконечные устройства связи и так далее.

Пример устройства 100 включает сенсорный дисплей 110 с множеством датчиков 114 касания для распознавания сенсорного ввода на поверхности сенсорного экрана. Устройство 100 включает систему или блок 120 обнаружения приближения, конфигурированную для обнаружения размещения объекта 1 ввода в непосредственной близости от поверхности 112 сенсорного экрана, но без контакта с ней. Область 140 обнаружения, которая также может быть названа областью зависания, может иллюстрировать ближайшую область и/или расстояние, на котором обнаруживается объект 1 ввода при его зависании над поверхностью экрана. Пользовательский ввод, например конкретный жест в области 140 зависания, обнаруженный по меньшей мере частично на основе объекта 1 ввода, не касающегося поверхности 112 экрана, может быть назван вводом с использованием зависания. Такой ввод с использованием зависания связан по меньшей мере с одной функцией, например выбором элемента отображения, масштабированием области отображения, активацией всплывающего меню, модификацией элемента отображения или перемещением элемента отображения. Объект 1 ввода с использованием зависания и ввод с использованием зависания могут быть обнаружены на основе сенсорного сигнала или расстояния 150 от объекта 1 ввода до поверхности 112 экрана, удовлетворяющих заранее заданному пороговому значению. В некоторых вариантах осуществления область 140 зависания обеспечивает также ввод данных и/или доступ к ним в устройстве 100 даже без касания поверхности 112 экрана.

В некоторых вариантах осуществления система 120 обнаружения формирует поле обнаружения посредством одного или более датчиков 122 приближения. В одном из примеров осуществления используется емкостная система обнаружения приближения, в соответствии с чем датчики 122 представляют собой узлы емкостного обнаружения. Осуществляется контроль возмущений, вносимых в поле обнаружения одним или более объектами 100 ввода, и на основании обнаруженных возмущений осуществляется обнаружение наличия одного или более объектов. Схема 120 емкостного обнаружения обнаруживает изменения емкости над поверхностью 112 экрана.

Однако очевидно, что данные признаки не ограничивают настоящее изобретение конкретным типом обнаружения приближения. Система 120 обнаружения приближения может быть основана на инфракрасном обнаружении приближения, оптическом обнаружении тени, акустическом обнаружении излучения, ультразвуковом обнаружении или любых других подходящих способах обнаружения приближения. Например, в случае, если система 120 обнаружения приближения основана на инфракрасном обнаружении, система будет включать один или более излучателей, посылающих импульсы инфракрасного излучения. Для обнаружения отражений такого излучения от расположенных поблизости объектов 100 будут использоваться один или более детекторов. Если система обнаруживает отраженное излучение, предполагается, что объект ввода имеется в наличии.

Система 120 обнаружения может быть выполнена с возможностью оценки (или предоставления сигнала, обеспечивающего оценку) расстояния от поверхности 112 экрана до объекта 1 ввода, что позволяет предоставить координатные данные z положения объекта 1 относительно поверхности 112 экрана. Это может выполняться непрерывно или, в некоторых вариантах осуществления, в конкретные периоды времени и/или после какого-либо инициирования. Система 120 обнаружения приближения также может быть выполнена с возможностью формирования информации о положении х, у объекта 1 для обеспечения возможности определения целевого элемента отображения или области ввода с использованием зависания. В зависимости от используемого способа обнаружения приближения, размера устройства 100 и поверхности 112 экрана, а также требуемого взаимодействия с пользователем область 140 зависания может простираться от поверхности 112 экрана на расстояние, например, от нескольких миллиметров до многих десятков сантиметров.

Устройство 100 может содержать стереоскопический дисплей, обладающий возможностью отображения стереоскопических изображений. Стереоскопический дисплей может быть выполнен с возможностью формирования 3D-изображения(-ий), то есть изображений, включающих целое изображение или по меньшей мере некоторые элементы отображения с 3D-эффектами, которые визуализируются на различных уровнях глубины (в направлении z), например элементы 2-4 отображения, как показано на фиг.1а и 1b. Стереоскопический дисплей может направлять информацию от нескольких субпикселей изображения в различных направлениях, так что зритель может видеть различные изображения каждым глазом. Если эти изображения достаточно сходны, человеческий мозг будет полагать, что зритель смотрит на единый объект и объединять соответствующие точки на двух изображениях с формированием объекта, воспринимаемого как единое целое. Данные для 3D-элемента отображения могут быть получены, например, путем съемки множества двумерных изображений и объединения пикселей изображений в субпиксели единого изображения для представления на стереоскопическом дисплее. В одном из вариантов, две камеры, которые расположены на небольшом заранее заданном расстоянии друг относительно друга, снимают двумерные изображения для 3D-представления. Каждая камера может включать цепочку обработки изображений, применяющую обработку изображений к захваченным изображениям. Система стереоскопического дисплея также может включать пользовательское устройство формирования изображений и функциональные средства отслеживания положения глаз. Дисплей может иметь специальные 2D и SD-режимы и система может переключаться между этими режимами. В зависимости от требуемой реализации и применяемой технологии стереоскопического дисплея, сенсорный экран 110 может быть выполнен с возможностью обеспечения особенностей стереоскопического дисплея, или элементы стереоскопического дисплея могут быть по меньшей мере частично отделены от сенсорного экрана 110 (не показаны на фиг.2). В одном из вариантов осуществления стереоскопический дисплей представляет собой автостереоскопический дисплей, а 3D-изображения представляют собой автостереоскопические изображения, которые относятся в общем к стереоскопическому представлению элемента отображения, не требующему применения специальных очков для пользователя. Могут применяться различные автостереоскопические дисплеи, например автостереоскопические дисплеи на основе параллаксного барьера и/или линз Френеля или на основе применения голографии и/или отслеживания перемещения глаз.

Система 120 обнаружения приближения соединена с контроллером 130. Система 120 обнаружения приближения конфигурирована для подачи сигналов в контроллер 130 при обнаружении объекта 1 ввода в области 140 зависания. На основе таких сигналов ввода могут быть инициированы команды, выбор или другие типы действий, обычно путем предоставления пользователю визуальной, звуковой и/или тактильной обратной связи. Сенсорный ввод в датчики 114 касания может быть сигнализирован в контроллер 130 или другой контроллер посредством схемы управления.

Контроллер 130 может быть также соединен с одним или более устройствами вывода, например сенсорным дисплеем с функциями 3D-дисплея и/или отдельным блоком отображения, обладающим возможностью обеспечения 3D-ощущения. Контроллер 130 может быть конфигурирован для управления различными изображениями приложений на дисплее 110. Контроллер 130 может обнаруживать сенсорный ввод и ввод с использованием зависания на основе сигналов от системы 120 обнаружения приближения и датчиков 114 касания. Контроллер 130 может затем управлять функцией отображения, связанной с обнаруженным сенсорным вводом или вводом с использованием зависания. Кроме того, контроллер 130 может быть выполнен с возможностью обнаружения элемента отображения, являющегося целевым в текущий момент времени и связанного с объектом 1 зависания, и обеспечить с использованием операции отображения адаптацию визуализируемого положения (глубины) элемента отображения в направлении z на основе информации, зависящей от текущего расстояния от объекта 1 до поверхности 112 экрана. Ряд примеров других признаков, которые могут быть по меньшей мере частично выполнены контроллером 130, проиллюстрированы далее. Будет понятно, что функции контроллера 130 могут быть реализованы одиночным блоком управления или множеством блоков управления.

Необходимо понимать, что устройство 100 может содержать различные дополнительные элементы, не рассмотренные подробно в настоящем описании. Хотя устройство 100 и контроллер 130 показаны как единый объект, различные признаки могут быть реализованы в одном или более физических или логических объектах. Например, может быть предложено устройство на микросхемах, конфигурированное для выполнения функций управления контроллера 130. Кроме того, может быть предложен специальный функциональный модуль (модули), например, для выполнения одного или более шагов, описанных в отношении фиг.3.

На фиг.3 проиллюстрирован способ управления элементами отображения на основе зависания в соответствии с одним из примеров осуществления. Способ может быть применен, например, контроллером 130 в качестве алгоритма управления.

Наличие объекта в непосредственной близости от поверхности экрана обнаруживают на шаге 310. Необходимо отметить, что в ряде вариантов осуществления принимают информацию о наличии объекта и упомянутое обнаружение основано на этой принятой информации.

На шаге 320 обнаруживают элемент отображения, указываемый объектом ввода с использованием зависания. Обнаружение целевого элемента отображения относится в общем к обнаружению элемента отображения, связанного в текущий момент времени с объектом зависания, что может быть обнаружено на основе текущего положения х, у объекта 1. Однако на обнаружение целевого элемента отображения могут влиять дополнительные условия, например расстояние 150 до объекта 1. Осуществляется визуализация смещения указанного элемента отображения от плоскости поверхности экрана, то есть может быть показано, что элемент отображения расположен выше или ниже поверхности 5 сенсорного экрана.

На шаге 330 осуществляют проверку расстояния от объекта 1 до поверхности 112 экрана. Указанная проверка может быть выполнена на основе сигнала или значения, генерируемых, например, системой 120 обнаружения приближения.

На основе текущего обнаруженного расстояния осуществляют адаптацию указанного элемента отображения. Таким образом, может осуществляться управление 340 операцией отображения для адаптации показанного положения элемента отображения в направлении z. Управление операцией отображения следует понимать в широком смысле, как действие, вызывающее и приводящее к изменению элемента отображения, воспринимаемого пользователем. Например, оно может включать адаптацию выходного изображения(-ий) путем изменения положения изображения(-ий), извлечения нового изображения(-ий) из базы данных изображений и/или повторной визуализации 20/30-векторной графики в режиме реального времени.

Пример процедуры, показанной на фиг.3, включает также контроль состояния 350 датчика касания. Проверка состояния датчика касания может быть осуществлена 350, 360, например, на основе сигнала от контроллера дисплея. Если сенсорный ввод не обнаружен, может быть выполнен возврат к шагу 330, и может быть осуществлена, например, периодически, повторная проверка расстояния. Если обнаружено касание поверхности 112 сенсорного экрана, может быть выполнен переход к шагу 370 и осуществлено управление операцией отображения для визуализации размещения элемента отображения в плоскости (5) поверхности экрана.

Это обеспечивает возможность адаптации положения визуализируемого элемента отображения по глубине на основе расстояния от объекта 1 ввода до поверхности сенсорного экрана, так чтобы пользователь мог воспринять приближение пальца к элементу отображения и соприкосновение с пальцем при касании поверхности 112 сенсорного экрана.

Пользовательский интерфейс устройства, такого как устройство 100, может быть конфигурирован для обеспечения выполнения по меньшей мере некоторых соответствующих функций ввода/вывода, показанных на фиг.3. Необходимо понимать, что в отношении примера способа, показанного на фиг.3, могут применены различные модификации и дополнения. Например, объект 1 ввода с использованием зависания и текущий целевой элемент 2 отображения могут быть обнаружены по существу одновременно или пользователь может выполнить ввод с использованием зависания только спустя некоторое время после выполнения шага 310. Другой пример заключается в том, что может быть выполнена дополнительная процедура проверки того, обнаружено ли удаление объекта из области, находящейся в непосредственной близости от поверхности 112 экрана. Если объект больше не обнаруживается в области 140 зависания, процедура, показанная на фиг.3, может быть завершена. Несколько дополнительных примеров осуществления настоящего изобретения будут проиллюстрированы далее.

В примерах, показанных на фиг.1а и 1b, устройство 100 может быть выполнено с возможностью адаптации (340) дисплея для отображения перемещения 6 элемента 2 отображения по меньшей мере в направлении z. Так, целевой элемент 2 отображения может быть выполнен с возможностью реагирования на перемещение «зависающего» пальца, при этом может быть обеспечено восприятие пользователем перемещения элемента 2 отображения с помощью пальца. Если элемент 3 отображения отображается на заднем плане ниже уровня 5 поверхности экрана или «за» ним, может быть визуализировано перемещение пальца пользователя и элемента 3 отображения в противоположных направлениях и их контакт на экране. Если элемент 2 отображения находится над экраном, визуально значок и палец могут перемещаться в одном и том же направлении и осуществить контакт на уровне поверхности экрана.

В зависимости от применяемой технологии формирования 3D-восприятия имеются различные варианты выполнения операций 340, 370 отображения для осуществления адаптации воспринимаемого положения элемента отображения в направлении z. В ряде вариантов осуществления они включают изменение поперечного положения в направлении x 20-элементов отображения, используемых для формирования элемента 3 отображения с 3D-эффектом. Эти операции также могут включать адаптацию размера или формы элемента 3 отображения.

В ряде вариантов осуществления управление визуализируемым смещением элемента отображения в направлении z относительно уровня поверхности экрана осуществляют на основе значения диспаратности в зависимости от обнаруженного расстояния от объекта 1 до поверхности 5 экрана. Термин «диспаратность» в настоящем описании относится в общем к различию и сдвигу между изображением, формируемым для поля зрения левого глаза, и другим изображением, формируемым для поля зрения правого глаза, которые также могут называться изображением, полученным левым глазом, и изображением, полученным правым глазом, каждое из которых имеет конкретное расположение в плоскости х, у экрана. Значение диспаратности может представлять собой параметр любого типа, задающий или влияющий на поперечный сдвиг в направлении x между изображениями, полученными для левого глаза и для правого глаза, который приводит к изменению воспринимаемого положения результирующего элемента отображения по глубине. Значение диспаратности может непосредственно задавать параллакс между изображениями, полученными для левого глаза и для правого глаза, задавая воспринимаемое положение элемента отображения по глубине. Если используется положительный параллакс, пользователь может воспринимать элемент 2 отображения «плавающим» над экраном 5. Если используется отрицательный параллакс, компоненты пользовательского интерфейса воспринимаются как находящиеся ниже экрана 5. Так в примере, показанном на фиг.1а и 1b, изображение элемента 2 отображения, приближающегося к поверхности 5 экрана, может быть обеспечено на основе уменьшения поперечного сдвига между двумя 2D-изображениями, формирующими указанный элемент отображения.

На фиг.4 проиллюстрирован пример способа, аналогичного способу, показанному на фиг.3, который, например, может быть выполнен после шага 320, показанного на фиг.3. После обнаружения 410 текущего расстояния до поверхности экрана, на шаге 420 задают значение диспаратности. Например, в памяти, соединенной с контроллером 130, может храниться таблица соответствий или любой другой тип структуры данных с набором расстояний (или диапазонов расстояний) и соответствующих значений диспаратности.

Управление 430 операцией адаптации элемента отображения осуществляют для адаптации отображаемого положения элемента отображения в направлении z в соответствии со значением диспаратности. Это может относиться к любому типу операций, обеспечивающих изменение сдвига или смещения в направлении x между двумя изображениями (копиями изображений), формирующими элемент отображения. После этого координаты положения в направлении x для одного или обоих изображений могут быть изменены, и может быть выполнена операция визуализации для отображения изображений в адаптированном положении экрана. Необходимо отметить, что изображения могут по меньшей мере частично перекрываться. Два выходных изображения могут быть дополнительно адаптированы, например, посредством управления отображением изображения(-ий), извлеченного из базы данных изображений или путем повторной визуализации 20/30-векторной графики в реальном времени.

Если в результате проверки 440, 450 сенсорный ввод не был обнаружен, может быть выполнен возврат к шагу 410 и может быть произведена повторная, например периодическая, проверка расстояния. Это позволяет обеспечить автоматическую регулировку диспаратности целевого элемента отображения относительно уровня поверхности экрана в соответствии с расстоянием зависания.

Если касание поверхности 112 сенсорного экрана обнаружено, может быть выполнен переход к шагу 460 и значение диспаратности может быть установлено равным нулю, что приводит к отображению элемента отображения на уровне 5 поверхности экрана. При этом между изображением, полученным левым глазом, и изображением, полученным правым глазом, отсутствует отличие в поперечном направлении, и может отображаться единое 20-изображение без обеспечения 3D-эффекта по глубине. Положение плоскости экрана в направлении z может быть исходно установлено в качестве точки нулевого параллакса (Zero Parallax Point, ZPP), при этом управление элементом отображения на шаге 460 осуществляют в точке ZPP.

Необходимо понимать, что визуализация перемещения целевого элемента 3 отображения от поверхности 112 экрана может быть также осуществлена путем увеличения диспаратности для упрощения восприятия элемента отображения, следующего за удаляющимся объектом.

На фиг.5 проиллюстрирован пример способа, который может быть применен контроллером 130, например, в связи с шагами 410 и 420. После обнаружения 510 текущего расстояния от объекта 1 до поверхности 112 экрана, обнаруженное расстояние сравнивают 520, 530, 550 с ранее сохраненным значением, которое представляет собой ранее обнаруженное расстояние. Если обнаруженное расстояние меньше, чем указанное сохраненное значение, значение диспаратности адаптируют 540 для обеспечения визуализации приближения элемента отображения к поверхности 112 экрана. В случае положительного параллакса, то есть в случае, когда элемент 2 отображения показан над поверхностью 5 экрана, контроллер 130 может уменьшить смещение изображений в направлении х. В случае отрицательного параллакса контроллер 130 может увеличить смещение изображений в направлении х.

Если обнаруженное расстояние больше, чем сохраненное значение, значение диспаратности адаптируют 560 для обеспечения визуализации элемента отображения, удаленного дальше от поверхности 112 экрана. Например, в случае положительного параллакса, контроллер 130 может таким образом увеличить смещение изображений в направлении х. На шаге 570 сохраненное значение расстояния обновляют с использованием значения, обнаруженного на шаге 510, и процедура может вернуться к шагу 510 (если объект все еще зависает в области 140 зависания).

В одном из вариантов осуществления в ответ на обнаружение сенсорного ввода, например, на шаге 370/460 осуществляется переход в режим 2D-отображения, и 3D-изображение превращается в 2D-изображение. Таким образом могут быть устранены 3D-эффекты для всех или некоторых отображаемых элементов, и пользователь может дополнительно выполнить сенсорный ввод 2D-изображений.

В некоторых примерах осуществления устройство 100 конфигурировано для обнаружения поперечного положения объекта 1 в направлениях x, y, параллельных поверхности 3 экрана. Это может быть обнаружено, например, на шаге 330. Также может быть осуществлено управление визуализируемым перемещением целевого элемента 2 отображения (например, на шаге 340) в соответствии с обнаруженным поперечным положением, так что элемент отображения перемещается в поперечном направлении аналогично указанному объекту.

В одном из примеров осуществления устройство 100 конфигурировано для обнаружения виртуального касания элемента 2 отображения (появляющегося над поверхностью 5 экрана) объектом 1 на шаге 320. Так, элемент отображения может быть обнаружен в качестве целевого элемента отображения в ответ на обнаружение виртуального касания. В ответ на обнаружение действия по нажатию с использованием зависания, то есть обнаружение объекта, приближающегося к поверхности 5 экрана после обнаружения виртуального касания, устройство может быть конфигурировано для адаптации внешнего вида элемента 2 отображения, например, на шаге 340 и/или 370.

Устройство 100 может быть конфигурировано для обнаружения жеста(-ов) с использованием зависания. В одном из примеров осуществления устройство на шаге 320 конфигурируют для обнаружения жеста с использованием зависания, связанного по меньшей мере с элементом 2 отображения. Управление выбором и/или отображением перемещения элемента отображения может быть выполнено 330 в соответствии с указанным жестом с использованием зависания. Например, устройство 100 может быть выполнено с возможностью обнаружения вращения или функции двойного нажатия, связанной с целевым элементом 2 отображения.

В некоторых вариантах осуществления устройство 100 конфигурировано для управления операцией отображения элемента отображения на основе дополнительных характеристик, связанных с перемещением объекта 1 ввода в области 140 зависания. В еще одном примере осуществления устройство 100 конфигурировано для оценки скорости перемещения объекта 1. Устройство может быть также выполнено с возможностью выбора операции отображения для адаптации (например, на шаге 340/370) внешнего вида элемента отображения в соответствии с обнаруженной скоростью. Может быть использован один или более пороговых параметров, влияющих на выбор операции отображения, которая должна зависеть от скорости перемещения объекта.

Система 120 обнаружения приближения может быть выполнена с возможностью обнаружения одновременного или совместного использования двух или более объектов 1. В одном из примеров осуществления связанный элемент отображения обнаруживают в ответ на обнаружение зависания двух или более пальцев над поверхностью экрана. В другом примере элемент отображения может быть обнаружен и/или внешний вид элемента отображения может быть модифицирован в ответ на обнаружение двух зависающих пальцев. Проиллюстрированные выше в отношении фиг.3 признаки могут, например, использоваться отдельно для каждого обнаруженного пальца или для комбинации пальцев.

В одном из примеров осуществления в связи с одним или более шагами 340, 370, 430, 460, 540, 560 используются дополнительные эффекты. Например, могут быть обеспечена генерация дополнительных визуальных, звуковых и/или тактильных выходных сигналов.

В одном из примеров осуществления устройство 100 выполнено с возможностью обнаружения давления, приложенного к сенсорному экрану. Датчики 114 касания могут быть выполнены с возможностью генерации сигнала, представляющего давление, приложенное, например, объектом 1 к поверхности 112 экрана. Контроллер 130 может принимать информацию об обнаруженном давлении, и эта информация может быть использована для дополнительной адаптации целевого элемента обнаружения. Проиллюстрированное положение z элемента 2 отображения может быть адаптировано на основе указанного давления. Например, после выполнения касания элемента 2 отображения, если обнаружено, что нажатие на поверхность экрана было более сильным, может быть показано перемещение элемента 2 отображения из положения 8 ниже уровня 5 поверхности экрана.

Необходимо понимать, что два или более проиллюстрированных выше примеров условий могут использоваться для осуществления влияния на операции отображения. В дополнение к уже рассмотренным выше вариантам осуществления доступен широкий диапазон различных функций для выбора, связанного с вводом, обнаруженным сенсорной системой обнаружения и/или системой 120 обнаружения приближения. Контроллер 130 может быть конфигурирован для адаптации ассоциаций в соответствии, например, с текущим рабочим состоянием устройства 100, пользовательским вводом или приложением, выполняемым в устройстве 100. Например, указанные ассоциации могут зависеть от приложения, меню, вида и/или контекста (который может быть задан на основе информации, полученной от текущего окружения или использования устройства 100).

На фиг.6 показана блок-схема структуры электронного устройства 600 в соответствии с примером осуществления. Электронное устройство может включать устройство 100. Хотя проиллюстрирован и далее будет описан в качестве примера один вариант осуществления электронного устройства 600, варианты осуществления настоящего изобретения могут применяться в других типах электронных устройств, таких как, не ограничиваясь перечисленным, PDA, пейджеры, мобильные компьютеры, настольные компьютеры, портативные компьютеры, планшетные компьютеры, медиапроигрыватели, телевизионные приемники, игровые устройства, камеры, видеомагнитофоны, устройства позиционирования, электронные книги, носимые устройства, проекционные устройства, сенсорные поверхности, сенсорные стены и другие типы электронных систем.

Кроме того, устройство в примере осуществления не обязательно должно представлять собой цельное электронное устройство, а может быть компонентом или группой компонентов электронного устройства в других примерах осуществления. Например, устройство может быть выполнено в виде чипсета или какого-либо другого типа аппаратного модуля для управления выполнением по меньшей мере некоторых из описанных выше функций, таких как функции контроллера 130 на фиг.2.

Процессор 602 конфигурирован для выполнения инструкции и операций, связанных с электронным устройством 600. Процессор 602 может включать средства, такие как устройство цифровой обработки сигналов, микропроцессорное устройство и дополнительные схемы, для выполнения различных функций, включающих, например, одну или более функций, описанных в отношении фиг.3-5. Проце