Способ и система отбора обучающих признаков для алгоритма машинного обучения

Иллюстрации

Показать всеИзобретение относится к области вычислительной техники, в частности к системам машинного обучения. Технический результат заключается в обеспечении классификации обучающего документа в категорию с целевой меткой. Технический результат достигается за счет анализа обучающего документа для извлечения множества признаков и для данного еще не отобранного признака из множества признаков: итеративного создания набора параметров релевантности, итеративного создания набора параметров избыточности и определения показателя значимости признака на основе набора параметров релевантности и набора параметров избыточности, отбора признака, связанного с наивысшим значением показателя значимости признака, и добавления отобранного признака к отобранной подгруппе признаков. 2 н. и 24 з.п. ф-лы, 5 ил.

Реферат

ОБЛАСТЬ ТЕХНИКИ

[001] Настоящая технология относится к способам и системам отбора обучающих признаков для алгоритма машинного обучения.

УРОВЕНЬ ТЕХНИКИ

[002] Рост числа подключаемых вычислительных устройств в сочетании с достижениями в области вычислительной мощности и телекоммуникационных сетей привело к увеличению потока информации, которая в свою очередь требует хранения, передачи, поиска, управления и анализа обширных и сложных наборов данных.

[003] Методы машинного обучения и интеллектуального анализа данных были разработаны, чтобы изучать наборы данных и строить модели прогнозирования для получения надежных и воспроизводимых решений и результатов. Классификация, область машинного обучения, решает проблему определения категории для нового наблюдения. При классификации вводы делятся на два или более класса, и метод машинного обучения создает модель, назначающую эти вводы одному или нескольким таким классам, на основании обучающего набора данных. Отдельные наблюдения анализируются и помещаются в набор количественных свойств, известных как каузальные переменные или признаки.

[004] Отбор признаков, также известный как отбор переменных, отбор атрибутов или отбор подгруппы переменных, является дисциплиной машинного обучения, изучающей составление и отбор подгруппы соответствующих признаков для использования в построении модели, что позволяет упростить модели, укорачивает время обучения и усиливает обобщение за счет уменьшения переобучения. Способы отбора признаков основаны на предположении, что данные могут содержать избыточные или нерелевантные признаки, которые могут быть удалены с минимальной потерей информации. Отбор признаков особенно важен в контексте обширных наборов данных, содержащих сотни и тысячи признаков.

[005] Способы отбора признаков для классификации могут применяться в таких разнообразных областях, как, среди прочего, компьютерное зрение, поиск и разработка лекарственных средств, геостатистика, распознавание речи, биометрическая идентификация, биологическая классификация, классификация документов и распознавание шаблонов данных. Например, отбор признаков может быть выполнен для генного отбора, где признаки - коэффициенты экспрессии генов, соответствующие среднему числу молекул мРНК в пробе ряда пациентов, и где с помощью классификации здоровые пациенты отделяются от пациентов, больных раком, на основании коэффициентов экспрессии генов. В этом случае классификация ста пациентов может означать анализ до 60000 переменных или признаков. Другим примером применения отбора признаков может быть категоризация текста, где документы могут быть представлены векторами «набора слов» с размерностью, равной размеру словаря, содержащего показатели частотности слов, которые могут составлять до сотен тысяч слов, и где классификация документа может потребовать анализа сотен тысяч слов. Такие документы могут затем быть классифицированы по категориям поисковыми системами или могут быть использованы для фильтрации спама. Отбор признаков позволяет выполнять задачи классификации с меньшим числом переменных и с минимальной потерей точности, что может сэкономить время и вычислительные ресурсы.

[006] Способы отбора признаков в целом можно разделить на три категории: способы оболочки (wrapper methods), вложенные способы (embedded methods) и способы фильтрации (filter methods). Способы оболочки используют алгоритм обучения как черный ящик для присвоения оценок подгруппам переменных в соответствии с их предсказательной силой. Вложенные способы выполняют отбор переменных в процессе обучения и, как правило, индивидуальны для каждого данного обучения. Способы фильтрации позволяют отобрать подгруппу переменных в качестве шага предварительной обработки, независимо от выбранного прогностического фактора. Способы фильтрации иногда особенно подходят для определенных задач благодаря своей скорости, универсальному отбору переменных и возможности использовать их в качестве шага предварительной обработки для уменьшения размерности пространства и борьбы с переобучением.

[007] Способы фильтрации обычно рассматривают критерий оценки, представляющий корреляцию между признаком и меткой класса, для определения того, насколько полезным может быть признак при использовании его в качестве классификатора. Были разработаны несколько способов фильтрации, использующих максимизацию различных критериев оценки.

[008] В патентной заявке США 2014/0207764 A1, Haws и др. раскрыты различные варианты осуществления отбора признаков из пространства признаков. В одном варианте осуществления способа получают набор признаков и значение класса. Для признака, который был ранее отобран из набора признаков, получают показатель избыточности. Для каждого из множества пока еще не отобранных признаков в наборе признаков определяется показатель избыточности на основании полученного показателя избыточности, и избыточности между пока еще не отобранным признаком и признаком, который был отобран ранее. Релевантность значения класса определяется для каждого из еще не отобранных признаков. Отбирается признак из множества еще не отобранных признаков с наивысшей релевантностью значению класса и наименьшим показателем избыточности.

[009] В патенте США US 7,853,599 В2, Liu и др. раскрыты различные способы, компьютерные программы и системы отбора признаков для ранжирования при извлечении информации. В патенте описано вычисление показателя важности для признаков, измерение показателя сходства между двумя признаками, отбор признаков, которые максимизируют совокупные показатели важности признаков и сводят к минимуму совокупные показатели сходства между признаками. Также в патенте описан отбор признаков для ранжирования, решающий проблему оптимизации. Таким образом, в патенте показана идентификация релевантных признаков с помощью удаления мусорных и избыточных признаков и ускорения процесса обучения модели.

РАСКРЫТИЕ

[0010] Задачей предлагаемой технологии является устранение по меньшей мере некоторых недостатков, присущих известному уровню техники.

[0011] Варианты осуществления настоящего технического решения были разработаны с учетом изобретательского понимания по меньшей мере одной проблемы, связанной с известным уровнем техники.

[0012] Не выдвигая какую-то конкретную теорию, разработчики данной технологии считают, что не стоит выбирать или ожидать эффективности от традиционных подходов к отбору признаков с взаимной информацией (MI, mutual information) при работе с тремя или более признаками. Кроме того, эти подходы не могут учитывать признаки, которые релевантны целевой метке вместе, но не настолько релевантны индивидуально, одновременно с учетом избыточности между признаками с использованием условной взаимной информации.

[0013] Также разработчики данной технологии отмечают, что традиционные подходы к отбору признаков не применяют бинарное представление признаков, дающее возможность принимать во внимание взаимодействие нескольких признаков.

[0014] Таким образом, разработчики данной технологии решают вышеописанные недостатки, связанные с традиционными подходами к отбору признаков путем разработки метода отбора признаков с использованием условной взаимной информации и с учетом синергизма и избыточности между множеством признаков. Варианты осуществления настоящего технологии направлены на создание подгруппы признаков, лучше всего представляющих признаки обучающего документа, чтобы обеспечить классификацию обучающего документа в категорию с целевой меткой. Способ отбора признаков также может использовать бинарное представление признаков, а не сами признаки.

[0015] Первым объектом настоящей технологии является компьютерный способ отбора отобранной подгруппы признаков из множества признаков для обучения модуля машинного обучения, причем модуль машинного обучения исполняется электронным устройством, модуль машинного обучения обучается классифицировать электронный документ в целевую категорию с целевой меткой, а множество признаков связано с электронным документом, способ выполняется на электронном устройстве, способ включает в себя: анализ электронным устройством данного обучающего документа для извлечения множества признаков, связанных с ним, данный обучающий документ обладает предварительно назначенной целевой меткой, создание набора параметров релевантности для данного еще не отобранного признака из множества признаков с помощью итеративного выполнения: определения электронным устройством соответствующего параметра релевантности данного еще не отобранного признака по отношению к предварительно назначенной метке, причем параметр релевантности указывает на уровень синергизма данного еще не отобранного признака вместе с набором параметров релевантности, включая один или несколько уже отобранных признаков из множества признаков, определению предварительно назначенной целевой метке, добавление электронным устройством соответствующего параметра релевантности к набору параметров релевантности, создание набора параметров избыточности для данного еще не отобранного признака из множества признаков с помощью: определения электронным устройством соответствующего параметра избыточности данного еще не отобранного признака по отношению к предварительно назначенной целевой метке, причем параметр избыточности указывает на уровень избыточности данного еще не отобранного признака вместе с подгруппой параметров релевантности и подгруппой параметров избыточности, включая один или несколько уже отобранных признаков из множества признаков, определению предварительно назначенной целевой метки, добавление электронным устройством соответствующего параметра избыточности к набору параметров избыточности, анализ электронным устройством данного еще не отобранного признака для определения показателя значимости признака на основе набора параметров релевантности и набора параметров избыточности, отбор электронным устройством данного отобранного признака, причем данный отобранный признак связан с наивысшим значением показателя значимости признака, добавление данного отобранного признака в отобранную подгруппу признаков и сохранение модулем машинного обучения отобранной подгруппы признаков.

[0016] В некоторых вариантах осуществления технологии способ дополнительно включает в себя после анализа электронным устройством данного обучающего документа для извлечения множества признаков, связанных с ним, бинаризацию множества признаков и использование набора бинаризированных признаков как множества признаков.

[0017] В некоторых вариантах осуществления настоящей технологии отобранная подгруппа признаков включает в себя предварительно определенное число k отобранных признаков, а итеративное создание набора параметров релевантности, итеративное создание набора параметров избыточности, анализ данных еще не отобранных признаков и отбор данного отобранного признака повторяется k раз.

[0018] В некоторых вариантах осуществления настоящей технологии способ дополнительно включает в себя прежде создания набора параметров релевантности определение параметра t, определяющего число взаимодействующих признаков; причем определение соответствующего параметра релевантности итеративно осуществляется за t-1 этап, а определение соответствующего параметра избыточности итеративно осуществляется за t этапов.

[0019] В некоторых вариантах осуществления технологии параметр t равен по меньшей мере 3.

[0020] В некоторых вариантах осуществления технологии соответствующий параметр релевантности определяется на основе:

где I - взаимная информация, с - предварительно назначенная целевая метка, a b - данный еще не отобранный признак.

[0021] В некоторых вариантах осуществления технологии соответствующий параметр избыточности определяется на основе:

где I - взаимная информация, с - предварительно назначенная целевая метка, a b - данный еще не отобранный признак, a h1, … hj-1 - подгруппа параметров релевантности.

[0022] В некоторых вариантах осуществления технологии анализ электронным устройством данного еще не отобранного признака для определения показателя значимости признака на основе подгруппы параметров релевантности и подгруппы параметров избыточности определяется на основе:

где Ji - показатель значимости признака, b - данный неотобранный бинаризированный признак, B[f] - набор бинаризированных признаков, I - взаимная информация, с - предварительно назначенная целевая метка, h1, … hj-1 - подгруппа параметров релевантности, a g1, …, gt - набор параметров избыточности.

[0023] В некоторых вариантах осуществления технологии данный отобранный признак, связанный с наивысшим значением показателя значимости признака, определяется на основе:

где f - данный отобранный признак из множества признаков, a F\S - набор еще не отобранных признаков.

[0024] В некоторых вариантах осуществления технологии способ дополнительно включает в себя перед созданием второго набора параметров релевантности: анализ электронным устройством каждого признака из множества признаков для определения индивидуального параметра релевантности данного признака из множества признаков по отношению к предварительно назначенной целевой метке, причем индивидуальный параметр релевантности указывает на степень релевантности данного признака по отношению к определению предварительно назначенной целевой метки, и отбор электронным устройством из множества признаков первого отобранного признака, причем первый отобранный признак связан с наивысшим значением индивидуального параметра релевантности и добавление первого отобранного признака к отобранной подгруппе признаков.

[0025] В некоторых вариантах осуществления технологии индивидуальный параметр релевантности определяется на основе:

где f - данный признак из множества признаков, F - множество признаков, I - взаимная информация, с - предварительно назначенная целевая метка, b - данный признак, a B[f] - набор бинаризированных признаков.

[0026] В некоторых вариантах осуществления технологии создание соответствующего параметра релевантности дополнительно основано на множестве признаков и создание соответствующего параметра избыточности основано на отобранной подгруппе признаков.

[0027] В некоторых вариантах осуществления технологии добавление данного отобранного признака к отобранной подгруппе признаков включает в себя добавление набора параметров релевантности к отобранной подгруппе признаков.

[0028] Вторым объектом настоящей технологии является сервер для отбора отобранной подгруппы признаков из множества признаков для обучения модуля машинного обучения, модуль машинного обучения обучается классифицировать электронный документ в целевую категорию с целевой меткой, а множество признаков связано с электронным документом, сервер включает в себя: память, процессор, соединенный с памятью, процессор выполнен с возможностью осуществлять: анализ данного обучающего документа для извлечения множества признаков, связанных с ним, данный обучающий документ обладает предварительно назначенной целевой меткой, создание набора параметров релевантности для данного еще не отобранного признака из множества признаков с помощью итеративного выполнения: определения соответствующего параметра релевантности данного еще не отобранного признака по отношению к предварительно назначенной метке, причем параметр релевантности указывает на уровень синергизма данного еще не отобранного признака вместе с набором параметров релевантности, включая один или несколько уже отобранных признаков из множества признаков, определению предварительно назначенной целевой метке, добавление соответствующего параметра релевантности к набору параметров релевантности, создание набора параметров избыточности для данного еще не отобранного признака из множества признаков с помощью: определения соответствующего параметра избыточности данного еще не отобранного признака по отношению к предварительно назначенной целевой метке, причем параметр избыточности указывает на уровень избыточности данного еще не отобранного признака вместе с подгруппой параметров релевантности и подгруппой параметров избыточности, включая один или несколько уже отобранных признаков из множества признаков, определению предварительно назначенной целевой метки, добавление соответствующего параметра избыточности к набору параметров избыточности, анализ данного еще не отобранного признака для определения показателя значимости признака на основе набора параметров релевантности и набора параметров избыточности, отбор данного отобранного признака, причем данный отобранный признак связан с наивысшим значением показателя значимости признака, добавление данного отобранного признака в отобранную подгруппу признаков и сохранение в памяти отобранной подгруппы признаков.

[0029] В некоторых вариантах осуществления технологии процессор дополнительно выполнен с возможностью осуществлять после анализа данного обучающего документа для извлечения множества признаков, связанных с ним, причем данный документ обладает предварительно назначенной целевой меткой, бинаризацию множества признаков и использование набора бинаризированных признаков как множества признаков.

[0030] В некоторых вариантах осуществления настоящей технологии отобранная подгруппа признаков включает в себя предварительно определенное число к отобранных признаков, а итеративное создание набора параметров релевантности, итеративное создание набора параметров избыточности, анализ данных еще не отобранных признаков и отбор данного отобранного признака повторяется к раз.

[0031] В некоторых вариантах осуществления настоящей технологии процессор дополнительно выполнен с возможностью осуществлять прежде создания набора параметров релевантности определение параметра t, определяющего число взаимодействующих признаков, и в котором определение соответствующего параметра релевантности итеративно осуществляется за t-1 этап, а определение соответствующего параметра избыточности итеративно осуществляется за t этапов.

[0032] В некоторых вариантах осуществления технологии параметр t превосходит 3.

[0033] В некоторых вариантах осуществления технологии соответствующий параметр релевантности определяется на основе:

где I - взаимная информация, с - предварительно назначенная целевая метка, a b - данный еще не отобранный признак.

[0034] В некоторых вариантах осуществления технологии соответствующий параметр избыточности определяется на основе:

где I - взаимная информация, с - предварительно назначенная целевая метка, a b - данный еще не отобранный признак, a h1, … hj-1 - подгруппа параметров релевантности.

[0035] В некоторых вариантах осуществления технологии анализ данного еще не отобранного признака для определения показателя на основе набора параметров релевантности и набора параметров избыточности определяется на основе:

где Ji - показатель, b -- данный еще не отобранный бинаризированный признак, B[f] - набор бинаризированных признаков, I - взаимная информация, с - предварительно назначенная целевая метка, h1, … ht-1 - подгруппа параметров релевантности, a g1, …, gt - набор параметров избыточности.

[0036] В некоторых вариантах осуществления технологии данный отобранный признак, связанный с наивысшим значением показателя значимости признака, определяется на основе:

где f - данный признак из множества признаков, a F\S - набор еще не отобранных признаков.

[0037] В некоторых вариантах осуществления технологии процессор выполнен с дополнительной возможностью осуществлять перед созданием второго набора параметров релевантности: анализ каждого признака из множества признаков для определения индивидуального параметра релевантности данного признака из множества признаков по отношению к предварительно назначенной целевой метке, причем индивидуальный параметр релевантности указывает на степень релевантности данного признака по отношению к определению предварительно назначенной целевой метки, и отбор из множества признаков первого отобранного признака, причем первый отобранный признак связан с наивысшим значением индивидуального параметра релевантности и добавление первого отобранного признака к отобранной подгруппе признаков.

[0038] В некоторых вариантах осуществления технологии индивидуальный параметр релевантности определяется на основе:

где f - признак из множества признаков, F - множество признаков, I - взаимная информация, с - предварительно назначенная целевая метка, b - данный еще не отобранный признак, a B[f] - набор бинаризированных признаков.

[0039] В некоторых вариантах осуществления технологии создание соответствующего параметра релевантности дополнительно основано на множестве признаков и создание соответствующего параметра избыточности основано на отобранной подгруппе признаков.

[0040] В некоторых вариантах осуществления технологии добавление данного отобранного признака к отобранной подгруппе признаков включает в себя добавление набора параметров релевантности к отобранной подгруппе признаков.

[0041] В контексте настоящего описания «сервер» подразумевает под собой компьютерную программу, работающую на соответствующем оборудовании, которая способна получать запросы (например, от электронных устройств) по сети (например, сети передачи данных) и выполнять эти запросы или инициировать выполнение этих запросов. Оборудование может представлять собой один физический компьютер или одну физическую компьютерную систему, но ни то, ни другое не является обязательным для данной технологии. В контексте настоящей технологии использование выражения «сервер» не означает, что каждая задача (например, полученные команды или запросы) или какая-либо конкретная задача будет получена, выполнена или инициирована к выполнению одним и тем же сервером (то есть одним и тем же программным обеспечением и/или аппаратным обеспечением); это означает, что любое количество элементов программного обеспечения или аппаратных устройств может быть вовлечено в прием/передачу, выполнение или инициирование выполнения любого запроса или последствия любого запроса, связанного с клиентским устройством, и все это программное и аппаратное обеспечение может быть одним сервером или несколькими серверами, оба варианта включены в выражение «по меньшей мере один сервер».

[0042] В контексте настоящего описания «электронное устройство» подразумевает под собой вычислительное устройство или компьютерное устройство, способное работать с программным обеспечением, подходящим к решению соответствующей задачи. Таким образом, некоторыми примерами электронных устройств (среди прочего) могут служить универсальные персональные компьютеры (настольные компьютеры, ноутбуки, нетбуки и т.п.), мобильные компьютерные устройства, смартфоны, планшеты, а также сетевое оборудование, такое как маршрутизаторы, коммутаторы и шлюзы. Следует иметь в виду, что электронное устройство в настоящем контексте может вести себя как сервер по отношению к другим электронным устройствам. Использование выражения «электронное устройство» не исключает возможности использования множества электронных устройств для получения/отправки, выполнения или инициирования выполнения любой задачи или запроса, или же последствий любой задачи или запроса, или же этапов любого вышеописанного метода. В контексте настоящего описания термин «клиентское устройство» относится к любому из ряда клиентских электронных устройств, связанных с пользователем, например, персональные компьютеры, планшеты, смартфоны и тому подобное.

[0043] В контексте настоящего описания термин «сеть передачи данных» означает любую сеть передачи данных, например, компьютерную сеть, Интернет, телефонную сеть, систему телексной связи, сеть TCP/IP (например, сеть WAN, сеть LAN) и тому подобное. Термин «сеть передачи данных» включает в себя проводную сеть или напрямую соединенную сеть, а также беспроводную связь, например, акустическую, радиочастотную, инфракрасную и другие типы беспроводной связи, а также комбинации любых из вышеперечисленных.

[0044] В контексте настоящего описания, если четко не указано иное, "машиночитаемый носитель" и "память" подразумевает под собой носитель абсолютно любого типа и характера, не ограничивающие примеры включают в себя ОЗУ, ПЗУ, диски (компакт диски, DVD-диски, дискеты, жесткие диски и т.д.), USB-ключи, флеш-карты, твердотельные накопители и накопители на магнитной ленте.

[0045] В контексте настоящего описания, если конкретно не указано иное, слова «первый», «второй», «третий» и т.д. используются в виде прилагательных исключительно для того, чтобы отличать существительные, к которым они относятся, друг от друга, а не для целей описания какой-либо конкретной взаимосвязи между этими существительными. Так, например, следует иметь в виду, что использование терминов «первый сервер» и «третий сервер» не подразумевает какого-либо порядка, отнесения к определенному типу, хронологии, иерархии или ранжирования (например) серверов/между серверами, равно как и их использование (само по себе) не предполагает, что некий «второй сервер» обязательно должен существовать в той или иной ситуации. В дальнейшем, как указано здесь в других контекстах, упоминание «первого» элемента и «второго» элемента не исключает возможности того, что это один и тот же фактический реальный элемент. Так, например, в некоторых случаях, «первый» сервер и «второй» сервер могут являться одним и тем же программным и/или аппаратным обеспечением, а в других случаях они могут являться разным программным и/или аппаратным обеспечением.

[0046] В контексте настоящего описания появляется термин «взаимная информация». Взаимная информация (MI, mutual information) - мера количества информации, которую имеет одна случайная переменная о другой случайной переменной, и она может быть интерпретирована следующим образом: насколько тесно эти переменные связаны. MI может быть выражена как

Где H(f)=-E[logP(f)] - энтропия Шэннона, h a g - две случайные переменные. Условная информация двух случайных переменных huge учетом переменной h может быть выражена как:

Условная случайная переменная выражает количество дополнительной информации о переменной f, которое имеется у переменной g по сравнению с переменной h.

КРАТКОЕ ОПИСАНИЕ ЧЕРТЕЖЕЙ

[0047] Для лучшего понимания настоящей технологии, а также других ее аспектов и характерных черт, сделана ссылка на следующее описание, которое должно использоваться в сочетании с прилагаемыми чертежами, где:

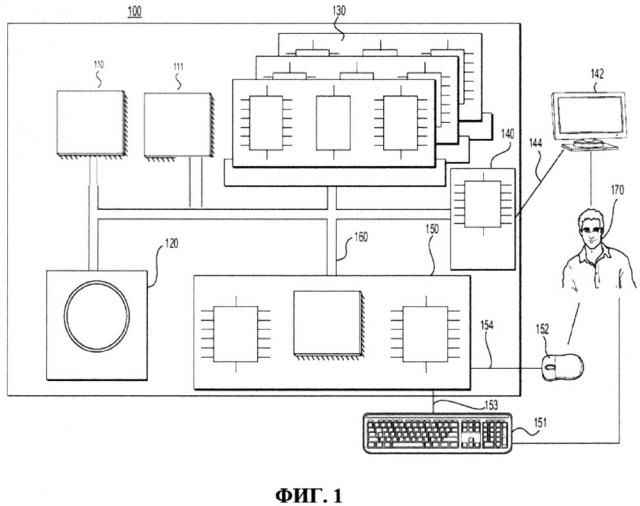

[0048] На ФИГ. 1 представлена схема электронного устройства, которое подходит для реализации настоящей технологии, и/или которое используется в сочетании с вариантами осуществления настоящей технологи;

[0049] - На Фиг. 2 представлена схема блока отбора признаков, причем обработка выполняется электронным устройством, как предусмотрено в некоторых вариантах осуществления настоящей технологии;

[0050] - На Фиг. 3 представлена схема процедуры определения отбора признаков, как предусмотрено в некоторых вариантах осуществления настоящей технологии; и

[0051]- На Фиг 4А и Фиг. 4В представлена блок-схема способа отбора отобранной подгруппы признаков из множества признаков, способ выполняется электронным устройством, изображенном на Фиг. 1, способ исполняется в соответствии с вариантами осуществления настоящей технологии, не ограничивающими ее объем.

КРАТКОЕ ОПИСАНИЕ ЧЕРТЕЖЕЙ

[0052] Все примеры и используемые здесь условные конструкции предназначены, главным образом, для того, чтобы помочь читателю понять принципы настоящей технологии, а не для установления границ ее объема. Следует также отметить, что специалисты в данной области техники могут разработать различные схемы, отдельно не описанные и не показанные здесь, но которые, тем не менее, воплощают собой принципы настоящей технологии и находятся в границах ее объема.

[0053] Кроме того, для ясности в понимании, следующее описание касается достаточно упрощенных вариантов осуществления настоящей технологии. Как будет понятно специалисту в данной области техники, многие варианты осуществления настоящей технологии будут обладать гораздо большей сложностью.

[0054] Некоторые полезные примеры модификаций настоящей технологии также могут быть охвачены нижеследующим описанием. Целью этого является также исключительно помощь в понимании, а не определение объема и границ настоящей технологии. Эти модификации не представляют собой исчерпывающего списка, и специалисты в данной области техники могут создавать другие модификации, остающиеся в границах объема настоящей технологии. Кроме того, те случаи, в которых не были представлены примеры модификаций, не должны интерпретироваться как то, что никакие модификации невозможны, и/или что то, что было описано, является единственным вариантом осуществления этого элемента настоящей технологии.

[0055] Более того, все заявленные здесь принципы, аспекты и варианты осуществления настоящей технологии, равно как и конкретные их примеры, предназначены для обозначения их структурных и функциональных основ, вне зависимости от того, известны ли они на данный момент или будут разработаны в будущем. Таким образом, например, специалистами в данной области техники будет очевидно, что представленные здесь блок-схемы представляют собой концептуальные иллюстративные схемы, отражающие принципы настоящей технологии. Аналогично, любые блок-схемы, диаграммы, псевдокоды и т.п.представляют собой различные процессы, которые могут быть представлены на машиночитаемом носителе и, таким образом, использоваться компьютером или процессором, вне зависимости от того, показан явно подобный компьютер или процессор или нет.

[0056] Функции различных элементов, показанных на фигурах, включая функциональный блок, обозначенный как «процессор» или «графический процессор», могут быть обеспечены с помощью специализированного аппаратного обеспечения или же аппаратного обеспечения, способного использовать подходящее программное обеспечение. Когда речь идет о процессоре, функции могут обеспечиваться одним специализированным процессором, одним общим процессором или множеством индивидуальных процессоров, причем некоторые из них могут являться общими. В некоторых вариантах осуществления настоящей технологии процессор может являться универсальным процессором, например, центральным процессором (CPU) или специализированным для конкретной цели процессором, например, графическим процессором (GPU). Более того, использование термина «процессор» или «контроллер» не должно подразумевать исключительно аппаратное обеспечение, способное поддерживать работу программного обеспечения, и может включать в себя, без установления ограничений, цифровой сигнальный процессор (DSP), сетевой процессор, интегральную схему специального назначения (ASIC), программируемую пользователем вентильную матрицу (FPGA), постоянное запоминающее устройство (ПЗУ) для хранения программного обеспечения, оперативное запоминающее устройство (ОЗУ) и энергонезависимое запоминающее устройство. Также в это может быть включено другое аппаратное обеспечение, обычное и/или специальное.

[0057] Программные модули или простые модули, представляющие собой программное обеспечение, могут быть использованы здесь в комбинации с элементами блок-схемы или другими элементами, которые указывают на выполнение этапов процесса и/или текстовое описание. Подобные модели могут быть выполнены на аппаратном обеспечении, показанном напрямую или косвенно.

[0058] С учетом этих примечаний далее будут рассмотрены некоторые варианты осуществления аспектов настоящей технологии, не ограничивающие ее объем.

[0059] На Фиг. 1 представлена схема электронного устройства 100, которое подходит для некоторых вариантов осуществления настоящей технологии, причем электронное устройство 100 включает в себя различные аппаратные компоненты, включая один или несколько одно- или многоядерных процессоров, которые представлены процессором 110, графический процессор (GPU) 111, твердотельный накопитель 120, ОЗУ 130, интерфейс 140 монитора, и интерфейс 150 ввода/вывода.

[0060] Связь между различными компонентами электронного устройства 100 может осуществляться с помощью одной или нескольких внутренних и/или внешних шин 160 (например, шины PCI, универсальной последовательной шины, высокоскоростной шины IEEE 1394, шины SCSI, шины Serial ATA и так далее), с которыми электронными средствами соединены различные аппаратные компоненты. Интерфейс 140 монитора может быть соединен с монитором 142 (например, через HDMI-кабель 144), видимым пользователю 170, интерфейс 150 ввода/вывода может быть соединен с сенсорным экраном (не изображен), клавиатурой 151 (например, через USB-кабель 153) и мышью 152 (например, через USB-кабель 154), причем как клавиатура 151, так и мышь 152 используются пользователем 170.

[0061] В соответствии с вариантами осуществления настоящей технологии твердотельный накопитель 120 хранит программные команды, подходящие для загрузки в ОЗУ 130, и использующиеся процессором ПО и/или графическим процессором GPU 111 для отбора отобранного набора признаков из множества признаков. Например, программные инструкции могут представлять собой часть библиотеки или приложение.

[0062] Электронное устройство 100 может быть сервером, настольным компьютером, ноутбуком, планшетом, смартфоном, персональным цифровым органайзером (PDA) или другим устройством, которое может быть выполнено с возможностью реализовать настоящую технологию, как будет понятно специалисту в данной области техники.

[0063] На Фиг. 2 представлен пример блока 200 отбора признаков.

[0064] Блок 200 отбора признаков может быть реализован электронным устройством 100 и может включать в себя процедуру 220 извлечения признаков, процедуру 240 бинаризации и процедуру 260 отбора признаков, обрабатывая обучающий документ 210.

[0065] Обучающий документ 210 может быть любым электронным файлом или документом, который может быть сохранен на машиночитаемом носителе информации, например, без каких-либо ограничений, твердотельном накопителе 120. Как будет понятно специалисту в данной области техники, реализация обучающего документа 210 никак не ограничена. Обучающий документ 210 может включать в себя любой тип медиа или данных, и может быть текстом, страницей HTML, документом PDF, информацией о форматировании, метаданными, аудиозаписью, изображением или видеозаписью. В некоторых вариантах осуществления настоящей технологии обучающий документ 210 может быть получен по сети передачи данных (не показана) от сервера (не показан). В других вариантах осуществления технологии обучающий документ 210 может быть получен из разных источников или серверов (не изображены) или загружен или введен пользователем 170.

[0066] Процедура 220 извлечения признаков может быть использована для получения множества 230 признаков и предварительно назначенной целевой метки (не изображена) из обучающего документа 210. Процедура 220 извлечения признаков может выводить множество 230 признаков и связанную предварительно назначенную целевую метку (не изображена) обучающего документа 210 в форме одного или нескольких векторов. В некоторых вариантах осуществления настоящей те