Адаптивное расширение полосы пропускания и устройство для этого

Иллюстрации

Показать всеИзобретение относится к области техники обработки речи, в частности к адаптивному расширению полосы пропускания. Технический результат – обеспечение формирования расширенной полосы пропускания частот в декодере. Данный способ включает в себя декодирование потока аудиобитов для того, чтобы формировать декодированный аудиосигнал полосы низких частот и спектр возбуждения в полосе низких частот, соответствующий полосе низких частот. Область подполосы частот выбирается из полосы низких частот с использованием параметра, который указывает информацию энергии спектральной огибающей декодированного аудиосигнала полосы низких частот. Спектр возбуждения в полосе высоких частот формируется для полосы высоких частот посредством копирования спектра возбуждения в подполосе частот из выбранной области подполосы частот в область подполосы высоких частот, соответствующую полосе высоких частот. С использованием сформированного спектра возбуждения в полосе высоких частот аудиосигнал расширенной полосы высоких частот формируется посредством применения спектральной огибающей полосы высоких частот. Аудиосигнал расширенной полосы высоких частот суммируется с декодированным аудиосигналом полосы низких частот для того, чтобы формировать выходной аудиосигнал, имеющий расширенную полосу пропускания частот. 4 н. и 15 з.п. ф-лы, 18 ил.

Реферат

[2] Настоящее изобретение, в общем, относится к области техники обработки речи и, в частности, к адаптивному расширению полосы пропускания и к устройству для означенного.

Уровень техники

[3] В современной системе обмена цифровыми аудио-/речевыми сигналами, цифровой сигнал сжимается в кодере; сжатая информация (поток битов) может пакетизироваться и отправляться в декодер через канал связи покадрово. Система кодера и декодера совместно называется "кодеком". Сжатие речи/аудио может использоваться для того, чтобы уменьшать число битов, которые представляют речевой/аудио-сигнал, за счет этого уменьшая скорость передачи битов, необходимую для передачи. Технология сжатия речи/аудио, в общем, может классифицироваться на кодирование во временной области и кодирование в частотной области. Кодирование во временной области обычно используется для кодирования речевого сигнала или для кодирования аудиосигнала на низких скоростях передачи битов. Кодирование в частотной области обычно используется для кодирования аудиосигнала или для кодирования речевого сигнала на высоких скоростях передачи битов. Расширение полосы пропускания (BWE) может быть частью кодирования во временной области или кодирования в частотной области, чтобы формировать сигнал полосы высоких частот на очень низкой скорости передачи битов или на нулевой скорости передачи битов.

[4] Тем не менее, речевые кодеры представляют собой кодеры с потерями, т.е. декодированный сигнал отличается от исходного. Следовательно, одна из целей при кодировании речи состоит в том, чтобы минимизировать искажение (или воспринимаемые потери) на данной скорости передачи битов или минимизировать скорость передачи битов, чтобы достигать данного искажения.

[5] Кодирование речи отличается от других форм кодирования аудио тем, что речь представляет собой гораздо более простой сигнал, чем большинство других аудиосигналов, и гораздо больше статистической информации доступно в отношении свойств речи. Как результат, некоторая звуковая информация, которая является релевантной при кодировании аудио, может быть необязательной в контексте кодирования речи. При кодировании речи, наиболее важный критерий представляет собой сохранение понятности и "удобства восприятия" речи с ограниченным объемом передаваемых данных.

[6] Понятность речи включает в себя, помимо фактического литерального контента, также отличительные черты говорящего, эмоции, интонацию, тембр и т.д., которые являются крайне важными для идеальной понятности. Более абстрактное понятие удобства восприятия ухудшенной речи представляет собой свойство, отличающееся от понятности, поскольку возможно то, что ухудшенная речь является абсолютно понятной, но субъективно раздражающей слушателя.

[7] Избыточность форм речевого сигнала может рассматриваться относительно нескольких различных типов речевого сигнала, таких как вокализованные и невокализованные речевые сигналы. Вокализованные звуки, например, "b", фактически обусловлены колебаниями голосовых связок и являются колебательными. Следовательно, за короткие периоды времени, они хорошо моделируются посредством сумм периодических сигналов, таких как синусоиды. Другими словами, для вокализованной речи, речевой сигнал фактически является периодическим. Тем не менее, эта периодичность может быть переменной в течение длительности речевого сегмента, и форма периодической волны обычно изменяется постепенно между сегментами. Кодирование речи на низкой скорости передачи битов может извлекать значительную выгоду из исследования такой периодичности. Период вокализованной речи также называется "основным тоном", и прогнозирование основного тона зачастую называется "долговременным прогнозированием (LTP)". Напротив, невокализованные звуки, такие как "s", "sh", являются более шумоподобными. Это обусловлено тем, что невокализованный речевой сигнал больше походит на случайный шум и имеет меньшую величину прогнозируемости.

[8] Традиционно, все способы параметрического кодирования речи, такие как кодирование во временной области, используют избыточность, внутренне присущую в речевом сигнале, для того чтобы уменьшать объем информации, который должен отправляться, и оценивать параметры речевых выборок сигнала с короткими интервалами. Эта избыточность главным образом возникает в силу повторения форм речевого сигнала на квазипериодической скорости и медленно изменяющейся огибающей спектра речевого сигнала.

[9] Избыточность форм речевого сигнала может рассматриваться относительно нескольких различных типов речевого сигнала, таких как вокализованный и невокализованный. Хотя речевой сигнал фактически является периодическим для вокализованной речи, эта периодичность может быть переменной в течение длительности речевого сегмента, и форма периодической волны обычно изменяется постепенно между сегментами. Кодирование речи на низкой скорости передачи битов может извлекать значительную выгоду из исследования такой периодичности. Период вокализованной речи также называется "основным тоном", и прогнозирование основного тона зачастую называется "долговременным прогнозированием (LTP)". Что касается невокализованной речи, сигнал больше походит на случайный шум и имеет меньшую величину прогнозируемости.

[10] В любом случае, параметрическое кодирование может использоваться для того, чтобы уменьшать избыточность речевых сегментов посредством отделения компонента возбуждения речевого сигнала от компонента огибающей спектра. Медленно изменяющаяся спектральная огибающая может быть представлена посредством линейного прогнозного кодирования (LPC), также называемого "кратковременным прогнозированием" (STP). Кодирование речи на низкой скорости передачи битов также может извлекать существенную выгоду из исследования такого кратковременного прогнозирования. Преимущество кодирования возникает в силу низкой скорости, на которой изменяются параметры. Тем не менее, параметров редко существенно отличаются от значений, хранимых в течение нескольких миллисекунд. Соответственно, на частоте дискретизации 8 кГц, 12,8 кГц или 16 кГц, алгоритм кодирования речи является таким, что номинальная длительность кадра находится в диапазоне десяти-тридцати миллисекунд. Длительность кадра в двадцать миллисекунд является наиболее распространенным выбором.

[11] Кодирование аудио на основе технологии на базе гребенки фильтров широко используется, например, при кодировании в частотной области. При обработке сигналов, гребенка фильтров представляет собой массив полосовых фильтров, который разделяет входной сигнал на несколько компонентов, каждый из которых переносит одну подполосу частот исходного сигнала. Процесс разложения, выполняемый посредством гребенки фильтров, называется "анализом", и вывод анализа на основе гребенки фильтров упоминается в качестве подполосного сигнала с числом подполос частот, равным числу фильтров в гребенке фильтров. Процесс восстановления называется "синтезом на основе гребенки фильтров". При обработке цифровых сигналов, термин "гребенка фильтров" также обычно применяется к гребенке приемных устройств. Отличие заключается в том, что приемные устройства также преобразуют с понижением частоты подполосы частот в низкую центральную частоту, которая может быть повторно дискретизирована на уменьшенной скорости. Идентичный результат может иногда достигаться посредством недостаточной дискретизации полосовых подполос частот. Вывод анализа на основе гребенки фильтров может иметь форму комплексных коэффициентов. Каждый комплексный коэффициент содержит "действительный элемент" и "мнимый элемент", соответственно, представляющие "косинусный член" и "синусный член" для каждой подполосы частот гребенки фильтров.

[12] В более новых известных стандартах, таких как G.723.1, G.729, G.718, стандарт улучшенного полноскоростного кодирования (EFR), стандарт на основе вокодера с переключаемым режимом (SMV), стандарт адаптивного многоскоростного кодирования (AMR), стандарт многорежимного широкополосного кодирования с переменной скоростью (VMR-WB) или стандарт широкополосного адаптивного многоскоростного кодирования (AMR-WB), приспособлена технология линейного прогнозирования с возбуждением по коду (CELP). Под CELP обычно понимается техническая комбинация кодированного возбуждения, долговременного прогнозирования и кратковременного прогнозирования. CELP в основном используется для того, чтобы кодировать речевой сигнал посредством извлечения выгоды из конкретных характеристик человеческого голоса или вокальной модели формирования человеческого голоса. CELP-кодирование речи является очень популярным алгоритмическим принципом в области сжатия речи, хотя детали CELP для различных кодеков могут существенно отличаться. Вследствие своей популярности, CELP-алгоритм использован в различных стандартах ITU-T, MPEG, 3GPP и 3GPP2. Разновидности CELP включают в себя алгебраическое CELP, ослабленное CELP, CELP с низкой задержкой и линейное прогнозирование с возбуждением векторной суммой и т.п. CELP является общим термином для класса алгоритмов, а не для конкретного кодека.

[13] CELP-алгоритм основан на четырех основных идеях. Во-первых, используется модель "источник-фильтр" речеобразования через линейное прогнозирование (LP). Модель "источник-фильтр" речеобразования моделирует речь в качестве комбинации источника звука, к примеру, голосовых связок, и линейного акустического фильтра, речевого тракта (и характеристики излучения). В реализации модели "источник-фильтр" речеобразования, источник звука или сигнал возбуждения зачастую моделируется в качестве периодической цепочки импульсов для вокализованной речи либо белого шума для невокализованной речи. Во-вторых, адаптивная и фиксированная таблица кодирования используется в качестве ввода (возбуждения) LP-модели. В-третьих, поиск выполняется с замкнутым контуром в "перцепционно взвешенной области". В-четвертых, применяется векторное квантование (VQ).

Сущность изобретения

[14] Вариант осуществления настоящего изобретения описывает способ декодирования кодированного потока аудиобитов и формирования расширения полосы пропускания частот в декодере. Способ содержит декодирование потока аудиобитов для того, чтобы формировать декодированный аудиосигнал полосы низких частот и формировать спектр возбуждения в полосе низких частот, соответствующий полосе низких частот. Область подполосы частот выбирается из полосы низких частот с использованием параметра, который указывает информацию энергии спектральной огибающей декодированного аудиосигнала полосы низких частот. Спектр возбуждения в полосе высоких частот формируется для полосы высоких частот посредством копирования спектра возбуждения в подполосе частот из выбранной области подполосы частот в область подполосы высоких частот, соответствующую полосе высоких частот. С использованием сформированного спектра возбуждения в полосе высоких частот, аудиосигнал расширенной полосы высоких частот формируется посредством применения спектральной огибающей полосы высоких частот. Аудиосигнал расширенной полосы высоких частот суммируется с декодированным аудиосигналом полосы низких частот для того, чтобы формировать выходной аудиосигнал, имеющий расширенную полосу пропускания частот.

[15] В соответствии с альтернативным вариантом осуществления настоящего изобретения, декодер для декодирования кодированного потока аудиобитов и формирования полосы пропускания частот содержит модуль декодирования в полосе низких частот, выполненный с возможностью декодировать поток аудиобитов для того, чтобы формировать декодированный аудиосигнал полосы низких частот и формировать спектр возбуждения в полосе низких частот, соответствующий полосе низких частот. Декодер дополнительно включает в себя модуль расширения полосы пропускания, соединенный с модулем декодирования в полосе низких частот. Модуль расширения полосы пропускания содержит модуль выбора подполосы частот и модуль копирования. Модуль выбора подполосы частот выполнен с возможностью выбирать область подполосы частот из полосы низких частот с использованием параметра, который указывает информацию энергии спектральной огибающей декодированного аудиосигнала полосы низких частот. Модуль копирования выполнен с возможностью формировать спектр возбуждения в полосе высоких частот для полосы высоких частот посредством копирования спектра возбуждения в подполосе частот из выбранной области подполосы частот в область подполосы высоких частот, соответствующую полосе высоких частот.

[16] В соответствии с альтернативным вариантом осуществления настоящего изобретения, декодер для обработки речи содержит процессор и машиночитаемый носитель хранения данных, сохраняющий программирование для выполнения посредством процессора. Программирование включает в себя инструкции для того, чтобы декодировать поток аудиобитов для того, чтобы формировать декодированный аудиосигнал полосы низких частот и формировать спектр возбуждения в полосе низких частот, соответствующий полосе низких частот. Программирование включает в себя инструкции для того, чтобы выбирать область подполосы частот из полосы низких частот с использованием параметра, который указывает информацию энергии спектральной огибающей декодированного аудиосигнала полосы низких частот, и формировать спектр возбуждения в полосе высоких частот для полосы высоких частот посредством копирования спектра возбуждения в подполосе частот из выбранной области подполосы частот в область подполосы высоких частот, соответствующую полосе высоких частот. Программирование дополнительно включает в себя инструкции для того, чтобы использовать сформированный спектр возбуждения в полосе высоких частот для того, чтобы формировать аудиосигнал расширенной полосы высоких частот посредством применения спектральной огибающей полосы высоких частот, и суммировать аудиосигнал расширенной полосы высоких частот с декодированным аудиосигналом полосы низких частот для того, чтобы формировать выходной аудиосигнал, имеющий расширенную полосу пропускания частот.

[17] Альтернативный вариант осуществления настоящего изобретения описывает способ декодирования кодированного потока аудиобитов и формирования расширения полосы пропускания частот в декодере. Способ содержит декодирование потока аудиобитов для того, чтобы формировать декодированный аудиосигнал полосы низких частот и формировать спектр полосы низких частот, соответствующий полосе низких частот, и выбор области подполосы частот из полосы низких частот с использованием параметра, который указывает информацию энергии спектральной огибающей декодированного аудиосигнала полосы низких частот. Способ дополнительно включает в себя формирование спектра полосы высоких частот посредством копирования спектра подполосы частот из выбранной области подполосы частот в область подполосы высоких частот и использование сформированного спектра полосы высоких частот для того, чтобы формировать аудиосигнал расширенной полосы высоких частот посредством применения энергии спектральной огибающей полосы высоких частот. Способ дополнительно включает в себя суммирование аудиосигнала расширенной полосы высоких частот с декодированным аудиосигналом полосы низких частот для того, чтобы формировать выходной аудиосигнал, имеющий расширенную полосу пропускания частот.

Краткое описание чертежей

[18] Для более полного понимания настоящего изобретения и дополнительных его преимуществ далее приводится ссылка на нижеприведенное подробное описание, рассматриваемое вместе с прилагаемыми чертежами, на которых:

[19] Фиг. 1 иллюстрирует операции, выполняемые в ходе кодирования исходной речи с использованием традиционного CELP-кодера;

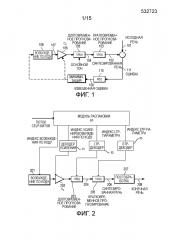

[20] Фиг. 2 иллюстрирует операции, выполняемые в ходе декодирования исходной речи с использованием CELP-декодера в реализации вариантов осуществления настоящего изобретения, как подробнее описано ниже;

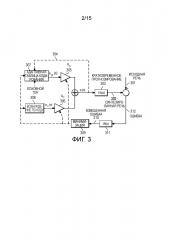

[21] Фиг. 3 иллюстрирует операции, выполняемые в ходе кодирования исходной речи в традиционном CELP-кодере;

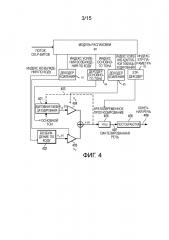

[22] Фиг. 4 иллюстрирует базовый CELP-декодер, соответствующий кодеру на фиг. 5 в реализации вариантов осуществления настоящего изобретения, как описано ниже;

[23] Фиг. 5A и 5B иллюстрируют пример кодирования/декодирования с расширением полосы пропускания (BWE), при этом фиг. 5A иллюстрирует операции в кодере со вспомогательной BWE-информацией, в то время как фиг. 5B иллюстрирует операции в декодере с BWE;

[24] Фиг. 6A и 6B иллюстрируют другой пример кодирования/декодирования с BWE без передачи вспомогательной информации, при этом фиг. 6A иллюстрирует операции в кодере, в то время как фиг. 6B иллюстрирует операции в декодере;

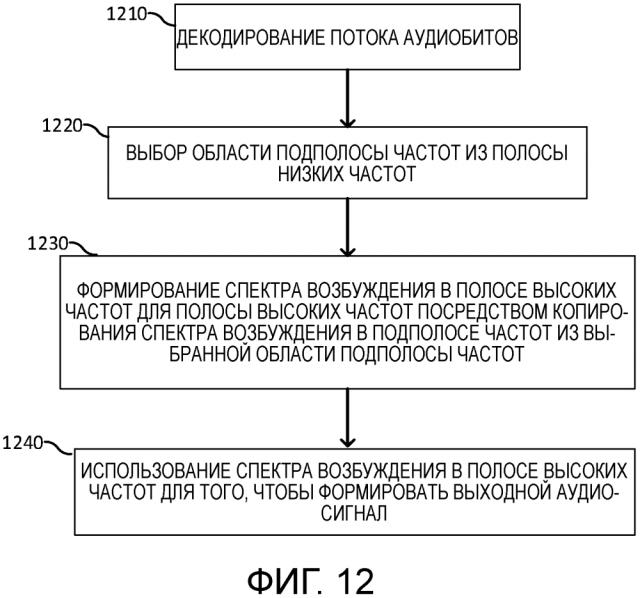

[25] Фиг. 7 иллюстрирует пример идеального спектра возбуждения для вокализованной речи или гармонической музыки, когда используется CELP-тип кодека;

[26] Фиг. 8 показывает пример традиционного расширения полосы пропускания декодированного спектра возбуждения для вокализованной речи или гармонической музыки, когда используется CELP-тип кодека;

[27] Фиг. 9 иллюстрирует пример варианта осуществления настоящего изобретения расширения полосы пропускания, применяемого к декодированному спектру возбуждения для вокализованной речи или гармонической музыки, когда используется CELP-тип кодека;

[28] Фиг. 10 иллюстрирует операции в декодере в соответствии с вариантами осуществления настоящего изобретения для реализации сдвига или копирования подполосы частот для BWE;

[29] Фиг. 11 иллюстрирует альтернативный вариант осуществления декодера для реализации сдвига или копирования подполосы частот для BWE;

[30] Фиг. 12 иллюстрирует операции, выполняемые в декодере в соответствии с вариантами осуществления настоящего изобретения;

[31] Фиг. 13A и 13B иллюстрируют декодер, реализующий расширение полосы пропускания в соответствии с вариантами осуществления настоящего изобретения;

[32] Фиг. 14 иллюстрирует систему связи согласно варианту осуществления настоящего изобретения; и

[33] Фиг. 15 иллюстрирует блок-схему системы обработки, которая может использоваться для реализации устройств и способов, раскрытых в данном документе.

Подробное описание иллюстративных вариантов осуществления

[34] В современной системе обмена цифровыми аудио-/речевыми сигналами, цифровой сигнал сжимается в кодере, и сжатая информация или поток битов может пакетизироваться и отправляться в декодер покадрово через канал связи. Декодер принимает и декодирует сжатую информацию, чтобы получать цифровой аудио-/речевой сигнал.

[35] Настоящее изобретение, в общем, относится к кодированию речевых/аудио-сигналов и расширению полосы пропускания речевых/аудио-сигналов. В частности, варианты осуществления настоящего изобретения могут использоваться для того, чтобы улучшать стандарт речевого ITU-T AMR-WB-кодера в области техники расширения полосы пропускания.

[36] Некоторые частоты являются более важными, чем другие. Важные частоты могут кодироваться с высоким разрешением. Небольшие разности на этих частотах являются значительными, и необходима схема кодирования, которая сохраняет эти разности. С другой стороны, менее важные частоты не обязательно должны быть точными. Более приблизительная схема кодирования может использоваться, даже если некоторые более точные детали теряются при кодировании. Типичная более приблизительная схема кодирования основана на принципе расширения полосы пропускания (BWE). Этот технологический принцип также называется "расширением полосы высоких частот (HBE)", "подполосной репликой (SBR)" или "репликацией полос спектра (SBR)". Хотя название может отличаться, все они имеют аналогичный смысл кодирования/декодирования некоторых подполос частот (обычно полос высоких частот) с небольшим бюджетом по скорости передачи битов (даже нулевым бюджетом по скорости передачи битов) или значительно более низкой скоростью передачи битов, чем нормальный подход кодирования/декодирования.

[37] В SBR-технологии, точная спектральная структура в полосе высоких частот копируется из полосы низких частот, и может добавляться некоторый случайный шум. Затем спектральная огибающая в полосе высоких частот формируется посредством использования вспомогательной информации, передаваемой из кодера в декодер. Сдвиг или копирование полосы частот из полосы низких частот в полосу высоких частот нормально является первым этапом для BWE-технологии.

[38] Ниже описываются варианты осуществления настоящего изобретения для улучшения BWE-технологии посредством использования адаптивного процесса, чтобы выбирать сдвиг полосы частот на основе энергетического уровня спектральной огибающей.

[39] Фиг. 1 иллюстрирует операции, выполняемые в ходе кодирования исходной речи с использованием традиционного CELP-кодера.

[40] Фиг. 1 иллюстрирует традиционный начальный CELP-кодер, в котором взвешенная ошибка 109 между синтезированной речью 102 и исходной речью 101 зачастую минимизируется посредством использования подхода по методу анализа через синтез, что означает то, что кодирование (анализ) выполняется посредством перцепционной оптимизации декодированного (синтезирующего) сигнала в замкнутом контуре.

[41] Базовый принцип, который используют все речевые кодеры, представляет собой тот факт, что речевые сигналы представляют высококоррелированные формы сигналов. В качестве иллюстрации, речь может быть представлена с использованием авторегрессивной (AR) модели, как указано в нижеприведенном уравнении (11).

(11)

[42] В уравнении (11), каждая выборка представляется как линейная комбинация предыдущих L выборок плюс белый шум. Весовые коэффициенты a1, a2, ..., aL, называются "коэффициентами линейного прогнозирования (LPC)". Для каждого кадра, весовые коэффициенты a1, a2, ..., aL, выбираются таким образом, что спектр {X1, X2, ..., XN}, сформированный с использованием вышеуказанной модели, близко совпадает со спектром входного речевого кадра.

[43] Альтернативно, речевые сигналы также могут быть представлены посредством комбинации гармонической модели и шумовой модели. Гармоническая часть модели фактически является представлением в виде ряда Фурье периодического компонента сигнала. В общем, для вокализованных сигналов, гармоническая плюс шумовая модель речи состоит из смеси как гармоник, так и шума. Пропорция гармоники и шума в вокализованной речи зависит от ряда факторов, включающих в себя характеристики говорящего (например, до какой степени голос говорящего является нормальным или хриплым); характер речевого сегмента (например, до какой степени речевой сегмент является периодическим), и от частоты. Верхние частоты вокализованной речи имеют более высокую пропорцию шумоподобных компонентов.

[44] Модель линейного прогнозирования и гармоническая шумовая модель представляют собой два основных способа для моделирования и кодирования речевых сигналов. Модель линейного прогнозирования является очень хорошей при моделировании огибающей спектра речи, тогда как гармоническая шумовая модель является хорошей при моделировании точной структуры речи. Два способа могут комбинироваться с тем, чтобы использовать преимущество своих относительных сильных сторон.

[45] Как указано выше, перед CELP-кодированием, входной сигнал в микрофон переносного телефона фильтруется и дискретизируется, например, на скорости 8000 выборок в секунду. Каждая выборка затем квантуется, например, с 13 битами в расчете на выборку. Дискретизированная речь сегментируется на сегменты или кадры в 20 мс (например, в этом случае 160 выборок).

[46] Речевой сигнал анализируется, и извлекаются его LP-модель, сигналы возбуждения и основной тон. LP-модель представляет огибающую спектра речи. Она преобразуется в набор коэффициентов частот спектральных линий (LSF), который является альтернативным представлением параметров линейного прогнозирования, поскольку LSF-коэффициенты имеют хорошие свойства квантования. LSF-коэффициенты могут скалярно квантоваться, либо более эффективно они могут векторно квантоваться с использованием предварительно подготовленных таблиц кодирования LSF-векторов.

[47] Возбуждение по коду включает в себя таблицу кодирования, содержащую кодовые векторы, которые имеют компоненты, которые независимо выбираются таким образом, что каждый кодовый вектор может иметь приблизительно "белый" спектр. Для каждого субкадра входной речи, каждый из кодовых векторов фильтруется через кратковременный линейный прогнозный фильтр 103 и долговременный прогнозный фильтр 105, и вывод сравнивается с речевыми выборками. В каждом субкадре, кодовый вектор, вывод которого имеет наилучшее совпадение с входной речью (минимизированную ошибку), выбирается для того, чтобы представлять этот субкадр.

[48] Кодированное возбуждение 108 нормально содержит импульсоподобный сигнал или шумоподобный сигнал, которые математически составляются или сохраняются в таблице кодирования. Таблица кодирования доступна как для кодера, так и для приемного декодера. Кодированное возбуждение 108, которое может представлять собой стохастическую или фиксированную таблицу кодирования, может представлять собой словарь векторного квантования, который (неявно или явно) жестко кодируется в кодек. Такая фиксированная таблица кодирования может представлять собой линейное прогнозирование с возбуждением по алгебраическому коду или сохраняться явно.

[49] Кодовый вектор из таблицы кодирования масштабируется посредством надлежащего усиления, чтобы задавать энергию равной энергии входной речи. Соответственно, вывод кодированного возбуждения 108 масштабируется посредством усиления Gc 107 перед прохождением через линейные фильтры.

[50] Кратковременный линейный прогнозный фильтр 103 формирует "белый" спектр кодового вектора, который напоминает спектр входной речи. Эквивалентно, во временной области, кратковременный линейный прогнозный фильтр 103 включает кратковременные корреляции (корреляцию с предыдущими выборками) в белой последовательности. Фильтр, который формирует возбуждение, имеет модель со всеми полюсами формы 1/A(z) (кратковременный линейный прогнозный фильтр 103), причем A(z) называется "прогнозным фильтром" и может получаться с использованием линейного прогнозирования (например, алгоритма Левинсона-Дурбина). В одном или более вариантов осуществления, может использоваться фильтр со всеми полюсами, поскольку он является хорошим представлением человеческого речевого тракта, и поскольку его нетрудно вычислять.

[51] Кратковременный линейный прогнозный фильтр 103 получается посредством анализа исходного сигнала 101 и представляется посредством набора коэффициентов:

[52] Как описано выше, области вокализованной речи демонстрируют долговременную периодичность. Этот период, известный как основной тон, вводится в синтезированный спектр посредством фильтра 1/(B(z)) основного тона. Вывод долговременного прогнозного фильтра 105 зависит от основного тона и усиления основного тона. В одном или более вариантов осуществления, основной тон может оцениваться из исходного сигнала, остаточного сигнала или взвешенного исходного сигнала. В одном варианте осуществления, функция (B(z)) долговременного прогнозирования может выражаться с использованием уравнения (13) следующим образом.

[53] Взвешивающий фильтр 110 связан с вышеуказанным кратковременным прогнозным фильтром. Один из типичных взвешивающих фильтров может представляться так, как описано в уравнении (14).

, (14)

где .

[54] В другом варианте осуществления, взвешивающий фильтр W(z) может извлекаться из LPC-фильтра посредством использования расширения полосы пропускания, как проиллюстрировано в одном варианте осуществления, в нижеприведенном уравнении (15).

(15),

В уравнении (15), γ1>γ2, которые являются коэффициентами, с которыми полюса перемещаются к началу координат.

[55] Соответственно, для каждого кадра речи, вычисляются LPC и основной тон, и обновляются фильтры. Для каждого субкадра речи, кодовый вектор, который формирует "наилучший" фильтрованный вывод, выбран таким образом, чтобы представлять субкадр. Соответствующее квантованное значение усиления должно передаваться в декодер для надлежащего декодирования. LPC и значения основного тона также должны квантоваться и отправляться каждый кадр для восстановления фильтров в декодере. Соответственно, индекс кодированного возбуждения, индекс квантованного усиления, индекс квантованного параметра долговременного прогнозирования и индекс квантованного параметра кратковременного прогнозирования передаются в декодер.

[56] Фиг. 2 иллюстрирует операции, выполняемые в ходе декодирования исходной речи с использованием CELP-декодера в реализации вариантов осуществления настоящего изобретения, как описано ниже.

[57] Речевой сигнал восстановлен в декодере посредством пропускания принимаемых кодовых векторов через соответствующие фильтры. Следовательно, каждый блок, за исключением постобработки, имеет определение, идентичное определению, описанному в кодере по фиг. 1.

[58] Кодированный поток CELP-битов принимается и распаковывается 80 в приемном устройстве. Для каждого принимаемого субкадра, принимаемые индекс кодированного возбуждения, индекс квантованного усиления, индекс квантованного параметра долговременного прогнозирования и индекс квантованного параметра кратковременного прогнозирования используются для того, чтобы находить соответствующие параметры с использованием соответствующих декодеров, например, декодера 81 усиления, долговременного прогнозного декодера 82 и кратковременного прогнозного декодера 83. Например, позиции и знаки амплитуды импульсов возбуждения и алгебраический кодовый вектор возбуждения 402 по коду могут определяться из принимаемого индекса кодированного возбуждения.

[59] Ссылаясь на фиг. 2, декодер представляет собой комбинацию нескольких блоков, которая включает в себя кодированное возбуждение 201, долговременное прогнозирование 203, кратковременное прогнозирование 205. Начальный декодер дополнительно включает в себя блок 207 постобработки после синтезированной речи 206. Постобработка дополнительно может содержать кратковременную постобработку и долговременную постобработку.

[60] Фиг. 3 иллюстрирует традиционный CELP-кодер.

[61] Фиг. 3 иллюстрирует базовый CELP-кодер с использованием дополнительной адаптивной таблицы кодирования для улучшения долговременного линейного прогнозирования. Возбуждение формируется посредством суммирования долей из адаптивной таблицы 307 кодирования и возбуждения 308 по коду, которое может представлять собой стохастическую или фиксированную таблицу кодирования, как описано выше. Записи в адаптивной таблице кодирования содержат задержанные версии возбуждения. Это позволяет эффективно кодировать периодические сигналы, такие как вокализованные звуки.

[62] Ссылаясь на фиг. 3, адаптивная таблица 307 кодирования содержит предыдущее синтезированное возбуждение 304 или повторяющийся цикл основного тона предыдущего возбуждения в периоде основного тона. Запаздывание основного тона может кодироваться с целочисленным значением, когда он является большим или длинным. Запаздывание основного тона зачастую кодируется с более точным дробным значением, когда оно является небольшим или коротким. Периодическая информация основного тона используется для того, чтобы формировать адаптивный компонент возбуждения. Этот компонент возбуждения затем масштабируется посредством усиления Gp 305 (также называемого "усилением основного тона").

[63] Долговременное прогнозирование играет очень важную роль для кодирования вокализованной речи, поскольку вокализованная речь имеет сильную периодичность. Смежные циклы основного тона вокализованной речи являются аналогичными друг другу, что математически означает то, что усиление Gp основного тона в следующем выражении для возбуждения является высоким или близким к 1. Результирующее возбуждение может выражаться как в уравнении (16) в качестве комбинации отдельных возбуждений.

,

где ep(n) является одним субкадром примерной последовательности с индексом посредством n, исходящим из адаптивной таблицы 307 кодирования, которая содержит предыдущее возбуждение 304 через контур обратной связи (фиг. 3); ep(n) может быть адаптивно фильтровано по нижним частотам, поскольку низкочастотная область зачастую является более периодической или более гармонической, чем высокочастотная область; eс(n) исходит из таблицы 308 кодирования кодированного возбуждения (также называемой "фиксированной таблицей кодирования"), которая является текущей долей в возбуждении. Дополнительно, ec(n) также может улучшаться, к примеру, посредством использования улучшения фильтрации верхних частот, улучшения основного тона, улучшения дисперсии, улучшения формант и других.

[64] Для вокализованной речи, доля ep(n) из адаптивной таблицы 307 кодирования может быть доминирующей, и усиление Gp 305 основного тона составляет около значения 1. Возбуждение обычно обновляется для каждого субкадра. Типичный размер кадра составляет 20 миллисекунд, и типичный размер субкадра составляет 5 миллисекунд.

[65] Как описано на фиг. 1, фиксированное кодированное возбуждение 308 масштабируется посредством усиления Gc 306 перед прохождением через линейные фильтры. Два масштабированных компонента возбуждения из фиксированного кодированного возбуждения 108 и адаптивной таблицы 307 кодирования суммируются между собой перед фильтрацией через кратковременный линейный прогнозный фильтр 303. Два усиления (Gp и Gc) квантуются и передаются в декодер. Соответственно, индекс кодированного возбуждения, индекс адаптивной таблицы кодирования, индексы квантованного усиления и индекс квантованного параметра кратковременного прогнозирования передаются в приемное аудиоустройство.

[66] Поток CELP-битов, кодированный с использованием устройства, проиллюстрированного на фиг. 3, принимается в приемном устройстве. Фиг. 4 иллюстрирует соответствующий декодер приемного устройства.

[67] Фиг. 4 иллюстрирует базовый CELP-декодер, соответствующий кодеру на фиг. 5. Фиг. 4 включает в себя блок 408 постобработки, принимающий синтезированную речь 407 из основного декодера. Этот декодер является аналогичным фиг. 3, за исключением адаптивной таблицы 307 кодирования.

[68] Для каждого принимаемого субкадра, принимаемые индекс кодированного возбуждения, квантованный индекс усиления кодированного возбуждения, индекс квантованного основного тона, индекс квантованного усиления адаптивной таблицы кодирования и индекс квантованного параметра кратковременного прогнозирования используются для того, чтобы находить соответствующие параметры с использованием соответствующих декодеров, например, декодера 81 усиления, декодера 84 основного тона, декодера 85 усиления адаптивной таблицы кодирования и кратковременного прогнозного декодера 83.

[69] В различных вариантах осуществления, CELP-декодер представляет собой комбинацию нескольких блоков и содержит кодированное возбуждение 402, адаптивную таблицу 401 кодирования, кратковременное прогнозирование 406 и постобработку 408. Каждый блок, за исключением постобработки, имеет определение, идентичное определению, описанному в кодере по фиг. 3. Постобработка дополнительно может включать в себя кратковременную постобработку и долговременную постобработку.

[70] Как уже упомянуто, CELP в основном используется для того, чтобы кодировать речевой сигнал посредством извлечения выгоды из конкретных характеристик человеческого голоса или вокальной модели формирования чело