Способ и устройство декодирования битового потока речи/аудио

Иллюстрации

Показать всеИзобретение относится к технологиям декодирования аудио и предназначено для декодирования битового потока речи/аудио сигнала. Технический результат - повышение качества выходного речевого/аудио сигнала. Данный способ декодирования битового потока речи/аудио включает извлечение параметра декодирования речи/аудио текущего речевого/аудио кадра, где вышеупомянутый текущий речевой/аудио кадр является избыточным декодированным кадром или речевой/аудио кадр до вышеупомянутого текущего речевого/аудио кадра является избыточным декодированным кадром; выполнение пост-обработки на извлеченном параметре декодирования речи/аудио согласно параметрам речи/аудио X речевых/аудио кадров, где вышеупомянутые X речевых/аудио кадров включают M речевых/аудио кадров до вышеупомянутого текущего речевого/аудио кадра и/или N речевых/аудио кадров после вышеупомянутого текущего речевого/аудио кадра; и восстановление речевого/аудио сигнала путем использования пост-обработанного параметра декодирования речи/аудио вышеупомянутого текущего речевого/аудио кадра. 2 н. и 18 з.п. ф-лы, 5 ил.

Реферат

ОБЛАСТЬ ТЕХНИКИ, К КОТОРОЙ ОТНОСИТСЯ ИЗОБРЕТЕНИЕ

[0001] Настоящее изобретение относится к технологиям декодирования аудио, и конкретно, к способу и устройству декодирования битового потока речи/аудио.

УРОВЕНЬ ТЕХНИКИ

[0002] В системе на основе передачи голоса по протоколу Internet (VoIP, голосовая связь по IP-протоколу), пакету может требоваться проходить через множество маршрутизаторов в процессе передачи, но поскольку эти маршрутизаторы могут сменяться при обработке вызова, задержка передачи обработки вызова может изменяться. Кроме того, когда два или более пользователей осуществляют попытку вхождения в сеть, используя один и тот же шлюз, задержка маршрутизации может изменяться, и такое изменение задержки называют флуктуацией времени задержки (delay jitter). Подобным образом флуктуация времени задержки также может вызываться, когда приемник, передатчик, шлюз и подобное используют операционную систему не реального времени, и в тяжелой ситуации происходит потеря пакета данных, приводя к искажению речи/аудио и ухудшению качества VoIP.

[0003] На настоящее время были использованы многие технологии на различных уровнях системы связи, чтобы снижать задержку, сглаживить флуктуацию времени задержки и выполнять компенсацию потери пакетов. Приемник может использовать алгоритм высокопроизводительной обработки джиттер-буфера (JBM, Jitter Buffer Management), чтобы до некоторой степени компенсировать флуктуацию времени задержки в сети. Однако, в случае относительно высокого коэффициента потерь пакетов, очевидно, требование высококачественной связи не может быть удовлетворено только с использованием технологии JBM.

[0004] Чтобы помочь устранению проблемы ухудшения качества, вызываемой флуктуацией времени задержки речевого/аудио кадра, предложен алгоритм кодирования с избыточностью. То есть, в дополнение к кодированию информации текущего речевого/аудио кадра с конкретной скоростью передачи битов, кодер кодирует информацию другого речевого/аудио кадра, отличного от текущего речевого/аудио кадра, с относительно более низкой скоростью передачи битов и передает относительно более низкоскоростной двоичный поток для информации другого речевого/аудио кадра в виде избыточной информации на декодер вместе с двоичным потоком информации текущего речевого/аудио кадра. Когда речевой/аудио кадр потерян, если джиттер-буфер буферизует (или содержит в себе принятый двоичный поток) избыточную информацию для потерянного речевого/аудио кадра, декодер восстанавливает потерянный речевой/аудио кадр согласно избыточной информации, посредством этого повышая качество речи/звучания.

[0005] В существующем алгоритме кодирования с избыточностью в дополнение к включению информации речевого/аудио кадра для N-ого кадра, двоичный поток N-ого кадра включает информацию речевого/аудио кадра (N-M)-ого кадра с более низкой скоростью передачи битов. В процессе передачи, если (N-M)-ый кадр теряется, процесс декодирования выполняют согласно информации речевого/аудио кадра, которая представляет (N-M)-ый кадр и включена в двоичный поток N-ого кадра, чтобы восстанавливать речевой/аудио сигнал из (N-M)-ого кадра.

[0006] Из вышеизложенного описания можно уяснить, что в существующем алгоритме кодирования с избыточностью, избыточную информацию двоичного потока получают посредством кодирования с более низкой скоростью передачи битов, каковое, следовательно, весьма вероятно вызовет нестабильность сигнала и дополнительно обусловит низкое качество выходного речевого/аудио сигнала.

СУЩНОСТЬ ИЗОБРЕТЕНИЯ

[0007] Варианты осуществления настоящего изобретения обеспечивают способ и устройство декодирования битового потока речи/аудио, каковое помогает повысить качество выходного речевого/аудио сигнала.

[0008] Первый аспект вариантов осуществления настоящего изобретения обеспечивает способ декодирования битового потока речи/аудио, который может включать в себя:

извлечение параметра декодирования речи/аудио текущего речевого/аудио кадра, где текущий речевой/аудио кадр является избыточным декодированным кадром, или речевой/аудио кадр до текущего речевого/аудио кадра является избыточным декодированным кадром;

выполнение пост-обработки на параметре декодирования речи/аудио текущего речевого/аудио кадра согласно параметрам речи/аудио для X речевых/аудио кадров, чтобы получить пост-обработанный параметр декодирования речи/аудио текущего речевого/аудио кадра, где X речевых/аудио кадров включают M речевых/аудио кадров до текущего речевого/аудио кадра и/или N речевых/аудио кадров после текущего речевого/аудио кадра, и M и N - целые положительные числа; и

восстановление речевого/аудио сигнала текущего речевого/аудио кадра путем использования пост-обработанного параметра декодирования речи/аудио текущего речевого/аудио кадра.

[0009] Второй аспект вариантов осуществления настоящего изобретения обеспечивает декодер для декодирования битового потока речи/аудио, включающий в себя:

модуль извлечения параметра, сконфигурированный для извлечения параметра декодирования речи/аудио текущего речевого/аудио кадра, где текущий речевой/аудио кадр является избыточным декодированным кадром, или речевой/аудио кадр до текущего речевого/аудио кадра является избыточным декодированным кадром;

блок пост-обработки, сконфигурированный для выполнения пост-обработки на параметре декодирования речи/аудио текущего речевого/аудио кадра согласно параметрам речи/аудио X речевых/аудио кадров, чтобы получать пост-обработанный параметр декодирования речи/аудио текущего речевого/аудио кадра, где X речевых/аудио кадров включают в себя M речевых/аудио кадров до текущего речевого/аудио кадра и/или N речевых/аудио кадров после текущего речевого/аудио кадра, и M и N - целые положительные числа; и

блок восстановления, сконфигурированный для восстановления речевого/аудио сигнала для текущего речевого/аудио кадра с использованием пост-обработанного параметра декодирования речи/аудио текущего речевого/аудио кадра.

[0010][0011] Третий аспект вариантов осуществления настоящего изобретения обеспечивает носитель данных компьютера, где носитель данных компьютера может сохранять программу, и если исполняется, программа включает в себя некоторые или все этапы любого способа декодирования битового потока речи/аудио, описанного в вариантах осуществления настоящего изобретения.

[0012] Можно уяснить, что в некоторых вариантах осуществления настоящего изобретения в сценарии, в котором текущий речевой/аудио кадр является избыточным декодированным кадром или речевой/аудио кадр до текущего речевого/аудио кадра является избыточным декодированным кадром, после получения параметра декодирования речи/аудио текущего речевого/аудио кадра, декодер выполняет пост-обработку на параметре декодирования речи/аудио текущего речевого/аудио кадра согласно параметрам речи/аудио X речевых/аудио кадров, чтобы получить пост-обработанный параметр декодирования речи/аудио текущего речевого/аудио кадра, где вышеупомянутые X речевых/аудио кадров включают M речевых/аудио кадров до вышеупомянутого текущего речевого/аудио кадра и/или N речевых/аудио кадров после вышеупомянутого текущего речевого/аудио кадра, и восстанавливает речевой/аудио сигнал текущего речевого/аудио кадра путем использования пост-обработанного параметра декодирования речи/аудио из текущего речевого/аудио кадра, каковое гарантирует стабильное качество декодированного сигнала при переходе между избыточным декодированным кадром и обычным декодированным кадром или между избыточным декодированным кадром и восстановленным с маскированием разрушения кадра (FEC, Frame erasure concealment) кадром, посредством этого повышая качество выходного речевого/аудио сигнала.

КРАТКОЕ ОПИСАНИЕ ЧЕРТЕЖЕЙ

[0013] Чтобы более ясно описать технические решения в вариантах осуществления настоящего изобретения, в последующем кратко описываются сопроводительные чертежи, требуемые для описания вариантов осуществления. Очевидно, сопроводительные чертежи в последующем описании показывают просто некоторые варианты осуществления настоящего изобретения, и обычные специалисты в данной области техники могут получить другие чертежи из этих сопроводительных чертежей без творческих усилий.

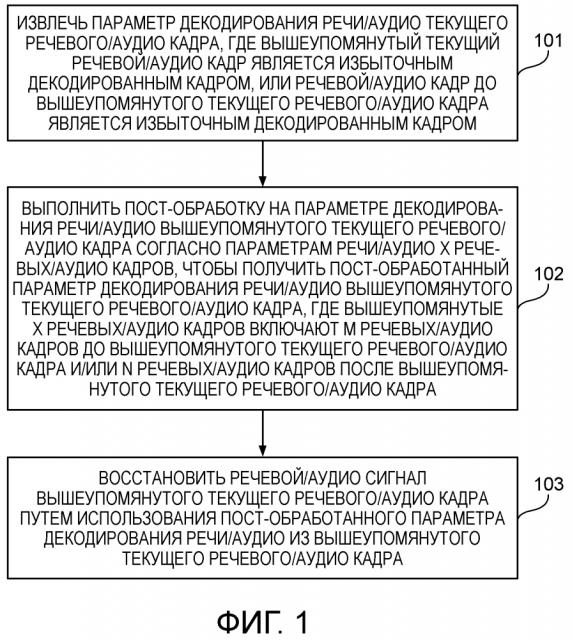

[0014] Фиг.1 - структурная схема способа декодирования битового потока речи/аудио согласно варианту осуществления настоящего изобретения;

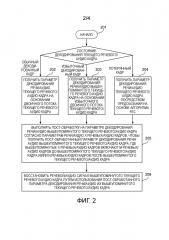

[0015] Фиг.2 - структурная схема другого способа декодирования битового потока речи/аудио согласно варианту осуществления настоящего изобретения;

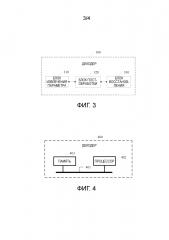

[0016] Фиг.3 - схематичное представление декодера согласно варианту осуществления настоящего изобретения;

[0017] Фиг.4 - схематичное представление другого декодера согласно варианту осуществления настоящего изобретения; и

[0018] Фиг.5 - схематичное представление другого декодера согласно варианту осуществления настоящего изобретения.

ОПИСАНИЕ ВАРИАНТОВ ОСУЩЕСТВЛЕНИЯ ИЗОБРЕТЕНИЧ

[0019] Варианты осуществления настоящего изобретения представляют способ и устройство декодирования битового потока речи/аудио, которые помогают повысить качество выходного речевого/аудио сигнала.

[0020] Чтобы сделать более четкими и более понятными объекты, признаки и преимущества настоящего изобретения, последующее ясно описывает технические решения в вариантах осуществления настоящего изобретения со ссылкой на сопроводительные чертежи в вариантах осуществления настоящего изобретения. Очевидно, варианты осуществления, описанные в последующем, составляют лишь часть, а не все варианты осуществления настоящего изобретения. Все другие исполнения, полученные средними специалистами в данной области техники на основании вариантов осуществления настоящего изобретения без творческих усилий, входят в рамки объема охраны настоящего изобретения.

[0021] В описании, формуле изобретения и на сопроводительных чертежах настоящего изобретения термины "первый", "второй", "третий", "четвертый" и так далее предназначены для различения различных объектов, а не для указания конкретного порядка. Кроме того, термины "включающий в себя", "включая", или любая другая их разновидность предназначены охватывать неисключающее включение. Например, процесс, способ, система, изделие или устройство, включающее в себя последовательность этапов или блоков, не ограничены перечисленными этапами или блоками и могут включать этапы или блоки, которые не перечислены.

[0022] Последующее дает соответственные описания подробно.

[0023] Сначала описывается способ декодирования битового потока речи/аудио, обеспеченный в вариантах осуществления настоящего изобретения. Способ декодирования битового потока речи/аудио, обеспеченный в вариантах осуществления настоящего изобретения, исполняется декодером, где декодер может быть любым устройством, которому необходимо выводить речевые сигналы, например, устройством, таким как мобильный телефон, портативный компьютер, планшетный компьютер или персональный компьютер.

[0024] В варианте осуществления способа декодирования битового потока речи/аудио в настоящем изобретении, способ декодирования битового потока речи/аудио может включать в себя: извлечение параметра декодирования речи/аудио текущего речевого/аудио кадра, где вышеупомянутый текущий речевой/аудио кадр является избыточным декодированным кадром, или речевой/аудио кадр до вышеупомянутого текущего речевого/аудио кадра является избыточным декодированным кадром; выполнение пост-обработки на параметре декодирования речи/аудио вышеупомянутого текущего речевого/аудио кадра согласно параметрам речи/аудио X речевых/аудио кадров для получения пост-обработанного параметра декодирования речи/аудио вышеупомянутого текущего речевого/аудио кадра, где вышеупомянутые X речевых/аудио кадров включают M речевых/аудио кадров до вышеупомянутого текущего речевого/аудио кадра и/или N речевых/аудио кадров после вышеупомянутого текущего речевого/аудио кадра, и M и N - целые положительные числа; и восстановление речевого/аудио сигнала вышеупомянутого текущего речевого/аудио кадра путем использования пост-обработанного параметра декодирования речи/аудио, соответствующего вышеупомянутому текущему речевому/аудио кадру.

[0025] Фиг.1 является структурной схемой способа декодирования битового потока речи/аудио согласно варианту осуществления настоящего изобретения. Способ декодирования битового потока речи/аудио, обеспеченный в этом варианте осуществления настоящего изобретения, может включать в себя следующее содержание:

[0026] 101. Извлечь параметр декодирования речи/аудио текущего речевого/аудио кадра.

[0027] Вышеупомянутый текущий речевой/аудио кадр является избыточным декодированным кадром, или речевой/аудио кадр до вышеупомянутого текущего речевого/аудио кадра является избыточным декодированным кадром.

[0028] Если речевой/аудио кадр до вышеупомянутого текущего речевого/аудио кадра является избыточным декодированным кадром, текущий речевой/аудио кадр может быть обычным декодированным кадром, FEC восстановленным кадром или избыточным декодированным кадром, где, если текущий речевой/аудио кадр является FEC восстановленным кадром, параметр декодирования речи/аудио текущего речевого/аудио кадра может быть предсказан на основе алгоритма FEC.

[0029] 102. Выполнить пост-обработку на параметре декодирования речи/аудио вышеупомянутого текущего речевого/аудио кадра согласно параметрам речи/аудио X речевых/аудио кадров, чтобы получить пост-обработанный параметр декодирования речи/аудио вышеупомянутого текущего речевого/аудио кадра, где вышеупомянутые X речевых/аудио кадров включают M речевых/аудио кадров до вышеупомянутого текущего речевого/аудио кадра и/или N речевых/аудио кадров после вышеупомянутого текущего речевого/аудио кадра, и M и N - целые положительные числа.

[0030] То, что речевой/аудио кадр (например, текущий речевой/аудио кадр или речевой/аудио кадр до текущего речевого/аудио кадра) являются обычным декодированным кадром, означает, что параметр речи/аудио вышеупомянутого речевого/аудио кадра может быть непосредственно получен из двоичного потока речевого/аудио кадра посредством декодирования. То, что речевой/аудио кадр (например, текущий речевой/аудио кадр или речевой/аудио кадр до текущего речевого/аудио кадра) является избыточным декодированным кадром, означает, что параметр речи/аудио речевого/аудио кадра не может быть непосредственно получен из двоичного потока речевого/аудио кадра посредством декодирования, но может быть получена избыточная информация двоичного потока для речевого/аудио кадра из двоичного потока другого речевого/аудио кадра.

[0031] M речевых/аудио кадров до текущего речевого/аудио кадра относятся к M речевым/аудио кадрам, предшествующим текущему речевому/аудио кадру и непосредственно смежным с текущим речевым/аудио кадром во временной области.

[0032] Например, M может быть равным 1, 2, 3, или другим значением. Если M=1, M речевых/аудио кадров до текущего речевого/аудио кадра представляют речевые/аудио кадры, являющиеся предыдущими для текущего речевого/аудио кадра, и речевой/аудио кадр до текущего речевого/аудио кадра и текущий речевой/аудио кадр представляют два непосредственно смежных речевых/аудио кадра; когда M=2, M речевых/аудио кадров до текущего речевого/аудио кадра представляют речевой/аудио кадр до текущего речевого/аудио кадра и речевой/аудио кадр до речевого/аудио кадра до текущего речевого/аудио кадра, и речевой/аудио кадр до текущего речевого/аудио кадра, речевой/аудио кадр до речевого/аудио кадра до текущего речевого/аудио кадра и текущий речевой/аудио кадр представляют три непосредственно смежных речевых/аудио кадра; и так далее.

[0033] N речевых/аудио кадров после текущего речевого/аудио относятся к N речевым/аудио кадрам, следующим после текущего речевого/аудио кадра, и непосредственно смежным с текущим речевым/аудио кадром во временной области.

[0034] Например, N может быть равным 1, 2, 3, 4, или другим значением. Когда N=1, N речевых/аудио кадров после текущего речевого/аудио кадра представляют речевой/аудио кадр после текущего речевого/аудио кадра, и речевой/аудио кадр после текущего речевого/аудио кадра и текущий речевой/аудио кадр представляют два непосредственно смежных речевых/аудио кадра; когда N=2, N речевых/аудио кадров после текущего речевого/аудио кадра представляют речевой/аудио кадр после текущего речевого/аудио кадра и речевой/аудио кадр после речевого/аудио кадра после текущего речевого/аудио кадра, и речевой/аудио кадр после текущего речевого/аудио кадра, речевой/аудио кадр после речевого/аудио кадра после текущего речевого/аудио кадра и текущий речевой/аудио кадр представляют три непосредственно смежных речевых/аудио кадра; и так далее.

[0035] Параметр декодирования речи/аудио может включать в себя, по меньшей мере, один из следующих параметров:

огибающую расширения полосы частот, коэффициент усиления адаптивной кодовой книги (gain_pit), алгебраическую кодовую книгу, период основного тона, коэффициент наклона спектра, параметр спектральной пары и подобное.

[0036] Параметр речи/аудио может включать в себя параметр декодирования речи/аудио, класс сигнала и подобное.

[0037] Классом сигнала речевого/аудио кадра может быть «невокализованный» (UNVOICED), «вокализованный» (VOICED), «обобщенный» (GENERIC), переходный (TRANSIENT), неактивный (INACTIVE) или подобный.

[0038] Параметр спектральной пары может быть, например, по меньшей мере, одним параметром из параметра пары спектральных линий (LSP: Line Spectral Pair) или параметра спектральной пары иммитанса (ISP: Immittance Spectral Pair).

[0039] Следует понимать, что в этом варианте осуществления настоящего изобретения пост-обработка может выполняться, по меньшей мере, на одном параметре декодирования речи/аудио из огибающей расширения полосы частот, коэффициента усиления адаптивной кодовой книги, алгебраической кодовой книги, периода основного тона или параметра спектральной пары текущего речевого/аудио кадра. Конкретно, сколько параметров выбрано, и какие параметры выбраны для пост-обработки, может определяться в соответствии со сценарием практического применения и средой применения, каковое не ограничивается в этом варианте осуществления настоящего изобретения.

[0040] Может выполняться различная пост-обработка на различных параметрах декодирования речи/аудио. Например, пост-обработка, выполняемая на параметре спектральной пары текущего речевого/аудио кадра, может быть адаптивным взвешиванием, выполняемым с использованием параметра спектральной пары текущего речевого/аудио кадра и параметра спектральной пары речевого/аудио кадра, предыдущего для текущего речевого/аудио кадра, чтобы получать пост-обработанный параметр спектральной пары текущего речевого/аудио кадра, и пост-обработка, выполняемая на коэффициенте усиления адаптивной кодовой книги текущего речевого/аудио кадра, может быть регулировкой, например, ослаблением, выполняемым на коэффициенте усиления адаптивной кодовой книги.

[0041] Конкретный вид пост-обработки не ограничивается в этом варианте осуществления настоящего изобретения, и конкретная пост-обработка может задаваться в соответствии с техническим требованием или в соответствии со средой применения и в соответствии со сценарием применения.

[0042] 103. Восстановить речевой/аудио сигнал для вышеупомянутого текущего речевого/аудио кадра путем использования пост-обработанного параметра декодирования речи/аудио из вышеупомянутого текущего речевого/аудио кадра.

[0043] Из вышеизложенного описания можно уяснить, что в этом варианте осуществления, в сценарии, в котором текущий речевой/аудио кадр является избыточным декодированным кадром или речевой/аудио кадр до вышеупомянутого текущего речевого/аудио кадра является избыточным декодированным кадром, после получения параметра декодирования речи/аудио текущего речевого/аудио кадра декодер выполняет пост-обработку на параметре декодирования речи/аудио текущего речевого/аудио кадра согласно параметрам речи/аудио X речевых/аудио кадров, чтобы получить пост-обработанный параметр декодирования речи/аудио вышеупомянутого текущего речевого/аудио кадра, где вышеупомянутые X речевых/аудио кадров включают M речевых/аудио кадров до вышеупомянутого текущего речевого/аудио кадра и/или N речевых/аудио кадров после вышеупомянутого текущего речевого/аудио кадра, и восстанавливает речевой/аудио сигнал текущего речевого/аудио кадра путем использования пост-обработанного параметра декодирования речи/аудио из текущего речевого/аудио кадра, каковое гарантирует стабильное качество декодированного сигнала при переходе между избыточным декодированным кадром и обычным декодированным кадром или между избыточным декодированным кадром и FEC восстановленным кадром, посредством этого повышая качество выходного речевого/аудио сигнала.

[0044] В некоторых вариантах осуществления настоящего изобретения параметр декодирования речи/аудио вышеупомянутого текущего речевого/аудио кадра включает в себя параметр спектральной пары вышеупомянутого текущего речевого/аудио кадра, и выполнение пост-обработки на параметре декодирования речи/аудио вышеупомянутого текущего речевого/аудио кадра согласно параметрам речи/аудио X речевых/аудио кадров, чтобы получать пост-обработанный параметр декодирования речи/аудио вышеупомянутого текущего речевого/аудио кадра, например, может включать в себя: выполнение пост-обработки на параметре спектральной пары вышеупомянутого текущего речевого/аудио кадра согласно, по меньшей мере, одному из класса сигнала, коэффициента наклона спектра, коэффициента усиления адаптивной кодовой книги или параметра спектральной пары X речевых/аудио кадров, чтобы получить пост-обработанный параметр спектральной пары вышеупомянутого текущего речевого/аудио кадра.

[0045] Например, выполнение пост-обработки на параметре спектральной пары вышеупомянутого текущего речевого/аудио кадра согласно, по меньшей мере, одному из класса сигнала, коэффициента наклона спектра, коэффициента усиления адаптивной кодовой книги или параметра спектральной пары X речевых/аудио кадров, чтобы получать пост-обработанный параметр спектральной пары вышеупомянутого текущего речевого/аудио кадра, может включать в себя:

если вышеупомянутый текущий речевой/аудио кадр является обычным декодированным кадром, речевой/аудио кадр до вышеупомянутого текущего речевого/аудио кадра является избыточным декодированным кадром, классом сигнала вышеупомянутого текущего речевого/аудио кадра является «невокализованный», и классом сигнала речевого/аудио кадра, предыдущего для вышеупомянутого текущего речевого/аудио кадра, не является «невокализованный», использование параметра спектральной пары вышеупомянутого текущего речевого/аудио кадра в качестве пост-обработанного параметра спектральной пары вышеупомянутого текущего речевого/аудио кадра, или получение пост-обработанного параметра спектральной пары вышеупомянутого текущего речевого/аудио кадра на основе параметра спектральной пары вышеупомянутого текущего речевого/аудио кадра; или

если вышеупомянутый текущий речевой/аудио кадр является обычным декодированным кадром, речевой/аудио кадр до вышеупомянутого текущего речевого/аудио кадра является избыточным декодированным кадром, классом сигнала вышеупомянутого текущего речевого/аудио кадра является «невокализованный», и классом сигнала речевого/аудио кадра, предыдущего для вышеупомянутого текущего речевого/аудио кадра, не является «невокализованный», получение пост-обработанного параметра спектральной пары вышеупомянутого текущего речевого/аудио кадра на основе параметра спектральной пары текущего речевого/аудио кадра и параметра спектральной пары речевого/аудио кадра, предыдущего для вышеупомянутого текущего речевого/аудио кадра; или

если вышеупомянутый текущий речевой/аудио кадр является избыточным декодированным кадром, классом сигнала вышеупомянутого текущего речевого/аудио кадра не является «невокализованный», и классом сигнала речевого/аудио кадра после вышеупомянутого текущего речевого/аудио кадра является «невокализованный», использование параметра спектральной пары речевого/аудио кадра, предыдущего для вышеупомянутого текущего речевого/аудио кадра, в качестве пост-обработанного параметра спектральной пары вышеупомянутого текущего речевого/аудио кадра, или получение пост-обработанного параметра спектральной пары вышеупомянутого текущего речевого/аудио кадра на основе параметра спектральной пары речевого/аудио кадра, предыдущего для вышеупомянутого текущего речевого/аудио кадра; или

если вышеупомянутый текущий речевой/аудио кадр является избыточным декодированным кадром, классом сигнала вышеупомянутого текущего речевого/аудио кадра не является «невокализованный», и классом сигнала речевого/аудио кадра после вышеупомянутого текущего речевого/аудио кадра является «невокализованный», получение пост-обработанного параметра спектральной пары вышеупомянутого текущего речевого/аудио кадра на основе параметра спектральной пары вышеупомянутого текущего речевого/аудио кадра и параметра спектральной пары речевого/аудио кадра, предыдущего для вышеупомянутого текущего речевого/аудио кадра; или

если вышеупомянутый текущий речевой/аудио кадр является избыточным декодированным кадром, классом сигнала вышеупомянутого текущего речевого/аудио кадра не является «невокализованный», максимальное значение коэффициента усиления адаптивной кодовой книги подкадра в речевом/аудио кадре после вышеупомянутого текущего речевого/аудио кадра меньше чем или равно первому пороговому значению, и коэффициент наклона спектра речевого/аудио кадра, предыдущего для вышеупомянутого текущего речевого/аудио кадра, меньше чем или равен второму пороговому значению, использование параметра спектральной пары речевого/аудио кадра, предыдущего для вышеупомянутого текущего речевого/аудио кадра, в качестве пост-обработанного параметра спектральной пары вышеупомянутого текущего речевого/аудио кадра, или получение пост-обработанного параметра спектральной пары вышеупомянутого текущего речевого/аудио кадра на основе параметра спектральной пары речевого/аудио кадра, предыдущего для вышеупомянутого текущего речевого/аудио кадра; или

если вышеупомянутый текущий речевой/аудио кадр является избыточным декодированным кадром, классом сигнала вышеупомянутого текущего речевого/аудио кадра не является «невокализованный», максимальное значение коэффициента усиления адаптивной кодовой книги подкадра в речевом/аудио кадре после вышеупомянутого текущего речевого/аудио кадра меньше чем или равно первому пороговому значению, и коэффициент наклона спектра речевого/аудио кадра, предыдущего для вышеупомянутого текущего речевого/аудио кадра, меньше чем или равен второму пороговому значению, получение пост-обработанного параметра спектральной пары вышеупомянутого текущего речевого/аудио кадра на основе параметра спектральной пары текущего речевого/аудио кадра и параметра спектральной пары речевого/аудио кадра, предыдущего для вышеупомянутого текущего речевого/аудио кадра; или

если вышеупомянутый текущий речевой/аудио кадр является избыточным декодированным кадром, классом сигнала вышеупомянутого текущего речевого/аудио кадра не является «невокализованный», речевым/аудио кадра после вышеупомянутого текущего речевого/аудио кадра является «невокализованный», максимальное значение коэффициента усиления адаптивной кодовой книги подкадра в речевом/аудио кадре после вышеупомянутого текущего речевого/аудио кадра меньше чем или равно третьему пороговому значению, и коэффициент наклона спектра речевого/аудио кадра, предыдущего для вышеупомянутого текущего речевого/аудио кадра, меньше чем или равен четвертому пороговому значению, использование параметра спектральной пары речевого/аудио кадра, предыдущего для вышеупомянутого текущего речевого/аудио кадра, в качестве пост-обработанного параметра спектральной пары вышеупомянутого текущего речевого/аудио кадра, или получение пост-обработанного параметра спектральной пары вышеупомянутого текущего речевого/аудио кадра на основе параметра спектральной пары речевого/аудио кадра, предыдущего для вышеупомянутого текущего речевого/аудио кадра; или

если вышеупомянутый текущий речевой/аудио кадр является избыточным декодированным кадром, классом сигнала вышеупомянутого текущего речевого/аудио кадра не является «невокализованный», классом сигнала речевого/аудио кадра после вышеупомянутого текущего речевого/аудио кадра является «невокализованный», максимальное значение коэффициента усиления адаптивной кодовой книги подкадра в речевом/аудио кадре после вышеупомянутого текущего речевого/аудио кадра меньше чем или равно третьему пороговому значению, и коэффициент наклона спектра речевого/аудио кадра, предыдущего для вышеупомянутого текущего речевого/аудио кадра, меньше чем или равен четвертому пороговому значению, получение пост-обработанного параметра спектральной пары вышеупомянутого текущего речевого/аудио кадра на основе параметра спектральной пары вышеупомянутого текущего речевого/аудио кадра и параметра спектральной пары речевого/аудио кадра, предыдущего для вышеупомянутого текущего речевого/аудио кадра.

[0046] Могут быть различные способы для получения пост-обработанного параметра спектральной пары вышеупомянутого текущего речевого/аудио кадра на основе параметра спектральной пары вышеупомянутого текущего речевого/аудио кадра и параметра спектральной пары речевого/аудио кадра, предыдущего для вышеупомянутого текущего речевого/аудио кадра.

[0047] Например, получение пост-обработанного параметра спектральной пары вышеупомянутого текущего речевого/аудио кадра на основе параметра спектральной пары вышеупомянутого текущего речевого/аудио кадра и параметра спектральной пары речевого/аудио кадра, предыдущего для вышеупомянутого текущего речевого/аудио кадра, может включать в себя: конкретно получение пост-обработанного параметра спектральной пары вышеупомянутого текущего речевого/аудио кадра на основе параметра спектральной пары вышеупомянутого текущего речевого/аудио кадра и параметра спектральной пары речевого/аудио кадра, предыдущего для вышеупомянутого текущего речевого/аудио кадра, и с использованием следующей формулы:

, где

- пост-обработанный параметр спектральной пары вышеупомянутого текущего речевого/аудио кадра, - параметр спектральной пары речевого/аудио кадра, предыдущего для вышеупомянутого текущего речевого/аудио кадра, - среднее значение параметра спектральной пары вышеупомянутого текущего речевого/аудио кадра, - параметр спектральной пары вышеупомянутого текущего речевого/аудио кадра, L - порядок параметра спектральной пары, α - весовой коэффициент параметра спектральной пары речевого/аудио кадра, предыдущего для вышеупомянутого текущего речевого/аудио кадра, β - весовой коэффициент среднего значения параметра спектральной пары вышеупомянутого текущего речевого/аудио кадра, δ - весовой коэффициент параметра спектральной пары вышеупомянутого текущего речевого/аудио кадра, и , где

если вышеупомянутый текущий речевой/аудио кадр является обычным декодированным кадром, и речевой/аудио кадр до вышеупомянутого текущего речевого/аудио кадра является избыточным декодированным кадром, α равно 0 или α меньше чем или равно пятому пороговому значению; или если вышеупомянутый текущий речевой/аудио кадр является избыточным декодированным кадром, β равно 0 или β меньше чем или равно шестому пороговому значению; или если вышеупомянутый текущий речевой/аудио кадр является избыточным декодированным кадром, δ равно 0 или δ меньше чем или равно седьмому пороговому значению; или если вышеупомянутый текущий речевой/аудио кадр является избыточным декодированным кадром, β равно 0 или β меньше чем или равно шестому пороговому значению, и δ равно 0 или δ меньше чем или равно седьмому пороговому значению.

[0048] Для другого примера получение пост-обработанного параметра спектральной пары вышеупомянутого текущего речевого/аудио кадра на основе параметра спектральной пары вышеупомянутого текущего речевого/аудио кадра и параметра спектральной пары речевого/аудио кадра, предыдущего для вышеупомянутого текущего речевого/аудио кадра, может включать в себя: конкретно получение пост-обработанного параметра спектральной пары вышеупомянутого текущего речевого/аудио кадра на основе параметра спектральной пары вышеупомянутого текущего речевого/аудио кадра и параметра спектральной пары речевого/аудио кадра, предыдущего для вышеупомянутого текущего речевого/аудио кадра, и с использованием следующей формулы:

, где

- пост-обработанный параметр спектральной пары вышеупомянутого текущего речевого/аудио кадра, - параметр спектральной пары речевого/аудио кадра, предыдущего для вышеупомянутого текущего речевого/аудио кадра, - параметр спектральной пары вышеупомянутого текущего речевого/аудио кадра, L - порядок параметра спектральной пары, α - весовой коэффициент параметра спектральной пары речевого/аудио кадра, предыдущего для вышеупомянутого текущего речевого/аудио кадра, δ - весовой коэффициент параметра спектральной пары речевого/аудио кадра, предыдущего для вышеупомянутого текущего речевого/аудио кадра, и , где

если вышеупомянутый текущий речевой/аудио кадр является обычным декодированным кадром, и речевой/аудио кадр до вышеупомянутого текущего речевого/аудио кадра является избыточным декодированным кадром, α равно 0 или α меньше чем или равно пятому пороговому значению; или если вышеупомянутый текущий речевой/аудио кадр является избыточным декодированным кадром, δ равно 0 или δ меньше чем или равно седьмому пороговому значению.

[0049] Каждый из пятого порога, шестого порога и седьмого порога может быть установлен в различные значения согласно различным средам или сценариям применения. Например, значение пятого порога может быть близким к 0, где например, пятый порог может быть равным 0,001, 0,002, 0,01, 0,1, или другим близким к 0 значением; значение шестого порога может быть близким к 0, где например, шестой порог может быть равным 0,001, 0,002, 0,01, 0,1, или другим близким к 0 значением; и значение седьмого порога может быть близким к 0, где например, седьмой порог может быть равным 0,001, 0,002, 0,01, 0,1, или другим близким к 0 значением.

[0050] Каждый из первого порога, второго порога, третьего порога и четвертого порога может быть установлен в различные значения согласно различным средам или сценариям применения.

[0051] Например, первый порог может быть установлен в 0,9, 0,8, 0,85, 0,7, 0,89 или 0,91.

[0052] Например, второй порог может быть установлен в 0,16, 0,15, 0,165, 0,1, 0,161 или 0,159.

[0053] Например, третий порог может быть установлен в 0,9, 0,8, 0,85, 0,7, 0,89 или 0,91.

[0054] Например, четвертый порог может быть установлен в 0,16, 0,15, 0,165, 0,1, 0,161 или 0,159.

[0055] Первый порог может быть равным или не равным третьему пороговому значению, и второй порог может быть равным или не равным четвертому пороговому значению.

[0056] В других вариантах осуществления настоящего изобретения параметр декодирования речи/аудио вышеупомянутого текущего речевого/аудио кадра включает в себя коэффициент усиления адаптивной кодовой книги вышеупомянутого текущего речевого/аудио кадра, и выполнение пост-обработки на параметре деко