Кодирование и декодирование перцепционно квантованного видеосодержимого

Иллюстрации

Показать всеГруппа изобретений относится к технологиям обработки отображения перцепционно квантованных видеоизображений. Техническим результатом является улучшение эффективности кодирования и перцепционной однородности для видеоизображений с расширенным динамическим диапазоном (HDR). Предложен способ кодирования перцепционно квантованного видеоизображения с расширенным динамическим диапазоном (HDR). Способ содержит этап, на котором получают доступ к первому видеосигналу в первом цветовом пространстве. Далее согласно способу применяют одно или более цветовых преобразований к первому видеосигналу с генерированием выходного видеосигнала в перцепционно квантованном оппонентном цветовом пространстве. Применение одного или более цветовых преобразований к первому видеосигналу с генерированием выходного видеосигнала дополнительно включает применение первого цветового преобразования к первому видеосигналу с генерированием второго видеосигнала в основном линейном цветовом пространстве. 4 н. и 17 з.п. ф-лы, 10 ил.

Реферат

ПЕРЕКРЕСТНЫЕ ССЫЛКИ НА РОДСТВЕННЫЕ ЗАЯВКИ

Настоящая заявка заявляет приоритет предварительной заявки на патент США № 62/056093, поданной 26 сентября 2014 года, описание которой полностью включено в настоящее описание посредством ссылки.

ОБЛАСТЬ ТЕХНИКИ ИЗОБРЕТЕНИЯ

Настоящее изобретение в общем относится к изображениям. Конкретнее, вариант осуществления настоящего изобретения относится к кодированию, декодированию и к управлению отображением перцепционно квантованных видеоизображений.

ПРЕДПОСЫЛКИ ИЗОБРЕТЕНИЯ

Видеосигналы могут быть представлены несколькими параметрами, такими как битовая глубина, цветовое пространство, цветовой охват и разрешение. Важной составляющей характеристики видеосигналов является динамический диапазон. Динамический диапазон (DR) – это диапазон интенсивности (например, яркости, составляющей яркости) в изображении, например, от самых темных из темных участков до самых ярких из светлых участков. В данном документе термин «динамический диапазон» (DR) может относиться к способности психовизуальной системы человека (HVS) воспринимать диапазон интенсивности (например, яркости, составляющей яркости) в изображении, например, от самых темных из темных участков до самых светлых из светлых участков. В этом смысле DR относится к «относящейся к сцене» интенсивности. DR может также относиться к способности устройства отображения в достаточной мере или приблизительно воспроизводить диапазон интенсивности конкретной ширины. В этом смысле DR относится к «относящейся к отображению» интенсивности. За исключением случаев, когда точно указывается, что конкретный смысл имеет конкретное значение в любом месте в описании в данном документе, следует делать вывод, что термин может быть использован в любом смысле, например, взаимозаменяемо.

В данном документе термин «расширенный динамический диапазон» (HDR) относится к ширине DR, которая охватывает приблизительно 14–15 порядков величины визуальной системы человека (HVS) (например, 1:10000). На практике изображения содержат один или более цветовых компонентов (например, яркость Y и цветность Cb и Cr), причем каждый цветовой компонент представлен с точностью до n бит на пиксель (например, n=8). Например, с использованием линейного или классического яркостного гамма-кодирования (например, согласно рекомендациям ITU 709), изображения, в которых n ≤ 8 (например, цветные 24-битные изображения JPEG) и динамический диапазон составляет от 1:100 до приблизительно 1:1000, рассматриваются в качестве узкого динамического диапазона, тогда как изображения, в которых n > 8 и более расширенный динамический диапазон, могут быть рассмотрены как изображения расширенного динамического диапазона. HDR-изображения могут быть сохранены и распределены с использованием низкой битовой глубины, нелинейного яркостного кодирования (например, 10-битного и логарифмического яркостного кодирования), или высокоточных (например, 16-битных) форматов с плавающей запятой, таких как формат файла OpenEXR, разработанный компанией Industrial Light and Magic.

Для HDR-изображений может потребоваться кодирование и передача посредством кодеров, которые не поддерживают их полный динамический диапазон. Например, видеокодек может поддерживать только 8-битные или 10-битные видеоданные, а битовая глубина намного ниже, чем обычная битовая глубина в 12–16 бит для HDR-видеоизображения. Предварительная и последующая обработка HDR-видеоизображения с использованием перцепционного квантования, описанного в стандарте SMPTE ST 2084 (2014) «Perceptually-based EOTF», который полностью включен в данную заявку посредством ссылки, может снизить требования к битовой глубине; однако это может повлиять на эффективность кодирования, так как стандарты кодирования, как правило, оптимизированы для гамма-кодированных YCbCr видеосигналов. Как отмечено в настоящей заявке авторами изобретения, желательно обеспечить улучшенные методы кодирования и декодирования перцепционно квантованных видеоизображений.

Подходы, описанные в данном разделе, являются подходами, которые могут быть выполнены, но необязательно подходами, которые были ранее предложены или выполнены. Следовательно, если не указано иное, не следует предполагать, что любой из подходов, описанных в данном разделе, расценивается как известный уровень техники только лишь вследствие их включения в данный раздел. Подобным образом, не следует предполагать, что проблемы, определенные относительно одного или более подходов, были учтены в известном уровне техники на основе данного раздела, если не указано иное.

КРАТКОЕ ОПИСАНИЕ ГРАФИЧЕСКИХ МАТЕРИАЛОВ

Вариант осуществления настоящего изобретения проиллюстрирован в качестве примера, а не в качестве ограничения, на фигурах прилагаемых графических материалов, на которых одинаковые номера позиций относятся к подобным элементам и на которых:

на фиг. 1A показан пример реализации схемы обработки для кодирования и декодирования HDR-видеоизображения в неперцепционно квантованном цветовом пространстве;

на фиг. 1B, фиг. 1C и фиг. 1D показаны примеры реализаций схем обработки для кодирования и декодирования HDR-видеоизображения в перцепционно квантованном цветовом пространстве согласно вариантам осуществления настоящего изобретения;

на фиг. 2A показан пример потока данных для преобразования гамма-кодированного или PQ-кодированного RGB-сигнала в цветовое пространство IPT-PQ; и

на фиг. 2B показан пример потока данных для преобразования гамма-кодированного или PQ-кодированного RGB-сигнала в модифицированное цветовое пространство IPT-PQ согласно вариантам осуществления данного изобретения; и

на фиг. 2C показан пример потока данных для преобразования IPT-PQ-сигнала в гамма-кодированный или PQ-кодированный RGB-сигнал согласно вариантам осуществления данного изобретения.

ОПИСАНИЕ ПРИВЕДЕННЫХ В КАЧЕСТВЕ ПРИМЕРА ВАРИАНТОВ ОСУЩЕСТВЛЕНИЯ

В данном документе описаны методы кодирования и декодирования для перцепционно квантованных видеосигналов.

В следующем описании в целях пояснения изложены многочисленные специфические подробности для предоставления полного понимания настоящего изобретения. Однако следует понимать, что настоящее изобретение может быть осуществлено без данных специфических подробностей. В других примерах широко известные структуры и устройства не описаны в мельчайших подробностях для предотвращения излишнего затруднения понимания настоящего изобретения.

Общее представление

Примерные варианты осуществления, описанные в данном документе, относятся к методам кодирования и декодирования для перцепционно квантованных видеосигналов. Первый HDR-видеосигнал доступен в первом цветовом пространстве (например, RGB-PQ или RGB с гамма-коррекцией). Одно или более цветовых преобразований применяются к первому видеосигналу для генерирования выходного видеосигнала в перцепционно квантованном оппонентном цветовом пространстве (например, IPT-PQ). Выходной видеосигнал сжимают посредством видеокодера для того, чтобы сгенерировать кодированный битовый поток, причем применение одного или более цветовых преобразований к первому видеосигналу для того, чтобы сгенерировать выходной видеосигнал дополнительно включает применение первого цветового преобразования к первому видеосигналу для генерирования второго видеосигнала в основном линейном цветовом пространстве (например, линейном LMS); применение матрицы преобразования перекрестных цветовых искажений (C) ко второму видеосигналу для генерирования третьего видеосигнала в основном линейном цветовом пространстве; применение перцепционного квантователя к третьему видеосигналу для генерирования четвертого видеосигнала в основном перцепционно квантованном цветовом пространстве (например, LMS-PQ) и применение второго цветового преобразования к четвертому видеосигналу для генерирования выходного видеосигнала в перцепционно квантованном оппонентном цветовом пространстве ( например, IPT-PQc).

В другом варианте осуществления в декодере кодируемый битовый поток декодируется для генерирования первого HDR-сигнала в перцепционно квантованном оппонентном цветовом пространстве (например, IPT-PQ). Одно или более цветовых преобразований применяются к первому HDR-сигналу для того, чтобы сгенерировать второй видеосигнал в первом основном линейном цветовом пространстве (например, линейном LMS). Затем обратную матрицу к матрице преобразования перекрестных цветовых искажений применяют ко второму видеосигналу для генерирования третьего видеосигнала в основном линейном цветовом пространстве, и в итоге второе множество цветовых преобразований применяют к третьему видеосигналу для генерирования четвертого видеосигнала в желаемом цветовом пространстве (например, RGB с гамма-коррекцией или RGB-PQ).

В варианте осуществления кодирование и декодирование видеоизображений выполняется в том же перцепционно квантованном цветовом пространстве (например, IPT-PQ), в котором происходит управление отображением, которое выполняется после видеодекодирования. В таком варианте осуществления таблицы соответствия, относящиеся к прямому восстановлению формы сигнала и тональной компрессии, могут быть объединены для уменьшения числа операций в декодере.

В варианте осуществления при кодировании и декодировании в перцепционно квантованном цветовом пространстве, перед кодированием, составляющая яркости может быть восстановлена с помощью нелинейной функции и составляющие цветности могут быть восстановлены посредством линейной функции восстановления цветности таким образом, что сохранится соотношение между динамическими диапазонами каналов яркости и цветности. Эти функции восстановления выполняются в обратном порядке в декодере перед применением обработки с управлением отображением.

Кодирование и декодирование HDR-сигналов

На фиг. 1A показан пример реализации схемы кодирования и декодирования HDR-видеосигналов. Входными данными (102) может быть HDR-видеосигнал, захваченный HDR-камерой, или они могут представлять собой выходные данные процесса последующей обработки видеоизображения, который включает ряд этапов обработки изображений и видеоизображений, таких как видеоредактирование, цветокоррекция и тому подобное. Перед сжатием с помощью видеокодера (110) видеосигнал (102) также может быть обработан с помощью блока (105) цветового преобразования таким образом, чтобы цветовой формат на входе в видеокодер (110) соответствовал поддерживаемым цветовым форматам, под которые кодер оптимизирован. Например, если входные данные (102) находятся в цветовом формате RGB 4:4:4 и видеокодер (110) работает в формате YCbCr 4:2:0, тогда блок (105) может выполнить цветовое преобразование из RGB в YCbCr и цветовую субдискретизацию.

Видеокодер (110) может быть одноуровневым кодером или многоуровневым кодером, использующим любую из схем сжатия видеоизображения, известных в данной области техники, таких как MPEG-2, MPEG-4 (часть 4), H.264, H.265 (HEVC), VP8 и тому подобное. Выходные данные видеокодера (110) могут храниться на носителе данных (например, на жестком диске или на оптическом носителе) или могут передаваться далее для декодирования принимающим устройством, таким как телевизионная приставка, медиаплеер и тому подобное. На принимающем устройстве видеодекодер (115) выполняет в обратном порядке этапы, выполненные видеокодером (110), для генерирования декомпрессированного видеосигнала (117) для отображения на целевом дисплее (135). Дисплей (135) может или не может соответствовать характеристикам эталонного дисплея, который использовался для генерирования видеосигнала (102). Например, видеосигнал (102) может быть отсортирован по цвету с использованием дисплея с уровнем яркости 2000 нитов; однако целевой дисплей (135) может иметь уровень яркости 1000 нитов или ниже. Для соответствия характеристикам целевого дисплея (135) в некоторых вариантах осуществления принимающее устройство (или собственно дисплей) может выполнять ряд этапов обработки видеосигнала, таких как цветовые преобразования и тональная компрессия. Эти этапы обработки обычно называются «управление отображением». Примеры способов управления отображением описываются в заявке PCT № PCT/US2014/016304 (именуемой как заявка ‘304), поданной 13 февраля 2014 года, и предварительной заявке США № 62/020622 (именуемой как заявка ‘622), поданной 3 июля 2014 года (также поданной как заявка на патент США № 14/755755), которая полностью включена в данную заявку посредством ссылки.

Как показано на фиг. 1A, и описано в заявке ‘304, в некоторых вариантах осуществления способ управления отображением для HDR-видеосигналов (например, этапы 125 и 130) может быть полезным, если он выполняется с использованием перцепционного скорректированного или перцепционного квантованного цветового пространства, такого как IPT-PQ. Цветовое пространство IPT, как описано в документе «Development and testing of a color space (ipt) with improved hue uniformity», F. Ebner и M.D. Fairchild, в ходе 6й конференции по цветному изображению: Color Science, Systems, and Applications, IS&T, Скоттсдейл, Аризона, ноябрь 1998 г., страницы 8–13 (под названием «Ebner paper»), который полностью включен посредством ссылки в данный документ, является моделью цветовой разницы между колбочками в визуальной системе человека. В этом смысле оно похоже на цветовые пространства YCbCr или CIE-Lab; однако в некоторых научных исследованиях оно показало лучшую имитацию обработки визуальной системы человека, чем данные пространства. Как и CIE-Lab, IPT является нормированным пространством для некоторой исходной яркости. В варианте осуществления нормирование основано на максимальной яркости целевого дисплея.

YCbCr, YUV, IPT, Lab и тому подобные цветовые пространства обычно именуются как оппонентные цветовые пространства, так как они описывают сигнал с использованием составляющей яркости (скажем, Y или I) и двух составляющих цветности или цветоразностных составляющих (скажем, CbCr или PT). В отличие от этого, RGB, LMS, XYZ и тому подобные цветовые пространства обычно именуются как основные цветовые пространства. При сжатии изображений и видеоизображений предпочтительнее работать в оппонентных цветовых пространствах, чем в основных цветовых пространствах, так как в оппонентных цветовых пространствах цветовые составляющие менее взаимосвязаны, и составляющие цветности могут быть подвергнуты субдискретизации перед сжатием без какой-либо потери при восприятии, таким образом улучшая общую способность к сжатию.

В данном документе термин «PQ» относится к перцепционному квантованию. Визуальная система человека реагирует на увеличение уровней света очень нелинейным образом. Способность человека видеть стимул зависит от яркости этого стимула, размера стимула, пространственной частоты (частот), формирующей стимул, и уровня яркости, к которому адаптировались глаза в конкретный момент просмотра стимула. В предпочтительном варианте осуществления функция перцепционного квантователя отображает линейные входные уровни серого на выходные уровни серого, которые лучше соответствуют пороговым значениям контрастной чувствительности в визуальной системе человека. Примеры функций отображения PQ описаны в спецификации SMPTE ST 2084:2014 и в заявке PCT № PCT/US2012/068212 (именуемой как заявка ‘212) под названием «Perceptual luminance nonlinearity-based image data exchange across different display capabilities,» J. S. Miller и соавт., поданной 6 декабря 2012 года и которая полностью включена в данную заявку посредством ссылки, в которых предоставлен фиксированный размер стимула для каждого уровня яркости (т. е. уровень стимула), шаг минимального видимого контраста при данном уровне яркости выбирается в соответствии с наиболее чувствительным уровнем адаптации и наиболее чувствительной пространственной частотой (в соответствии с моделями HVS). По сравнению с традиционной кривой гамма-распределения, которая представляет характеристическую кривую физического устройства на электронно-лучевой трубке (CRT) и в то же время может иметь очень грубое сходство со способом реагирования визуальной системы человека, кривая PQ, как определено в заявке ‘212, имитирует настоящую визуальную реакцию визуальной системы человека с использованием относительно простой функциональной модели. В данном документе термины RGB-PQ, IPT-PQ, YCbCr-PQ и тому подобные обозначают цветовые пространства, для которых по меньшей мере один цветовой канал повторно отображался или был подвергнут квантованию с использованием функции перцепционного квантования.

В таблице 1 описан расчет электронно-оптической передаточной функции (EOTF) перцепционной кривой для преобразования значений кода цифрового видеоизображения в абсолютные линейные уровни яркости в точке дисплея. Также включено обратное вычисление OETF для преобразования абсолютной линейной яркости в цифровые кодовые значения.

Таблица 1

Представленные в качестве примера формулировки уравнений:

D = цифровое кодовое значение перцепционной кривой, целое число без знака SDI-legal, 10 или 12 бит;

b = количество бит на компонент в представлении цифрового сигнала, 10 или 12;

V = нормированное значение сигнала перцепционной кривой, 0≤ V≤ 1

Y = нормированное значение яркости, 0≤ Y≤ 1

L = абсолютное значение яркости, 0≤ L≤ 10000 кд/м2.

Приведенные в качестве примера уравнения декодирования EOTF

Приведенные в качестве примера уравнения кодирования обратной EOTF

Приведенные в качестве примера постоянные

Примечания

1. Оператор INT возвращает значение 0 для дробных частей в диапазоне от 0 до 0,4999… и +1 для дробных частей в диапазоне от 0,5 до 0,9999…, т.е. он округляет дроби выше 0,5.

2. Все постоянные определяются в качестве точных чисел, кратных 12-битным рациональным числам, для предотвращения проблем с округлением.

3. Компоненты R, G или B сигнала должны быть вычислены таким же образом, как и компонент Y сигнала, описанный выше.

Как показано на фиг. 1A, для выполнения операций в перцепционно скорректированном или перцепционно квантованном цветовом пространстве (таком как IPT-PQ) может потребоваться определенное количество этапов обработки (120), таких как повышение дискретизации цветности и первое линейное цветовое преобразование (например, с YCbCr 4:2:0 в RGB 4:4:4), за которым следует второе нелинейное цветовое преобразование (например, с RGB в IPT-PQ). В качестве примера, на фиг. 2A и в соответствующем дальнейшем описании в данной заявке показана более подробно схема обработки для цветового преобразования из RGB в IPT-PQ.

Хотя при работе в пространстве IPT-PQ можно улучшить выходные данные операций тональной компрессии (125) и корректировки цветового охвата (130), требуемые цветовые преобразования (120) для преобразования входящего сигнала (117) в такое цветовое пространство, находятся за пределами технических характеристик устройств, таких как портативные вычислительные планшеты или смартфоны. Следовательно, в некоторых вариантах осуществления желательно уменьшить сложность декодера посредством передачи некоторых операций в кодер. Например, в варианте осуществления было бы желательно выполнять весь процесс кодирования в перцепционно скорректированном цветовом пространстве (например, IPT-PQ) таким образом, чтобы можно было уменьшить объем выполняемых в декодере цветовых преобразований (120) или полностью устранить их выполнение. К сожалению, существующие схемы видеокодирования оптимизированы под гамма-кодированные видеосигналы узкого динамического диапазона, как правило, кодированные в цветовом пространстве YCbCr. Как оценено авторами изобретения, при использовании существующих видеокодеков с HDR-сигналами в перцепционно скорректированном цветовом пространстве требуется несколько дополнительных этапов, таких как описано в данном документе.

Прямое и обратное восстановление формы сигнала

На фиг. 1B показан пример варианта осуществления для кодирования и декодирования HDR-видеоизображения, кодированного в перцепционно скорректированном цветовом пространстве (например, IPT-PQ). В варианте осуществления входные данные (102) могут уже быть в перцепционно кодированном цветовом пространстве (например, RGB-PQ). На этапе (105) цветовых преобразований преобразуется цветовое пространство входящего сигнала (102) из входного цветового пространства (например, RGB-PQ 4:4:4) в перцепционно скорректированный цветовой формат, подходящий для кодирования, с использованием видеокодера (110) (например, IPT-PQ 4:2:0). Чтобы воспользоваться преимуществом существующих схем сжатия видеоизображений, перед кодированием (110) в варианте осуществления входные данные, подвергнутые перцепционному кодированию, восстанавливают посредством процесса (107) прямого восстановления формы. Пример процесса прямого восстановления формы описан в заявке PCT PCT/US2014/031716 (именуемой как заявка ‘716), под названием «Encoding perceptually-quantized video content in multi-layer VDR coding», поданной 25 марта 2014 года и которая полностью включена в данную заявку посредством ссылки. Функции восстановления могут применяться только к каналу яркости или ко всем каналам. В некоторых вариантах осуществления для каналов яркости и цветности могут использоваться различные функции восстановления.

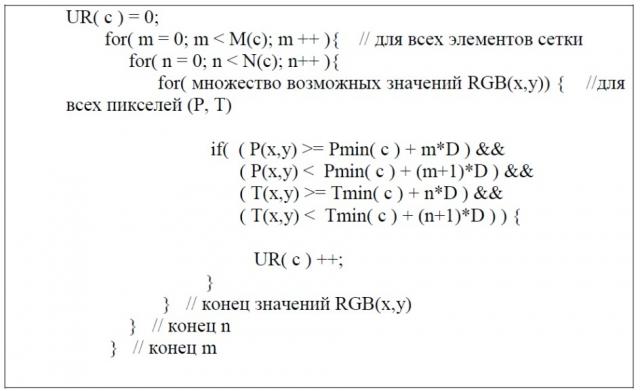

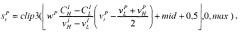

Как описано в заявке ‘716, для PQ-кодированных сигналов в варианте осуществления функция восстановления формы сигнала (107) может быть выражена следующим образом:

где vL и vH обозначают минимальное значение и максимальные значения в цветовом канале рассматриваемых входных данных HDR-сигнала (102), и cL и cH обозначают соответствующие минимальные и максимальные выходные значения, vi обозначает i-й исходный пиксель и si обозначает соответствующие выходные данные. Например, в варианте осуществления для нормирования цветовых значений в пределах (0,1) в одноуровневой системе, cL = 0 и cH = 1. Значение представляет собой постоянную, но оно может быть адаптировано и изменено покадрово, посценово или по другим подходящим основным критериям. В варианте осуществления, если входные данные функции восстановления подвергнуты PQ-кодированию, то α>1, в противном случае, если они подвергнуты гамма-кодированию, то α<1.

В декодере, в варианте осуществления операция обратного формирования или обратного восстановления формы (122) может быть выражена следующим образом:

для декодированного исходного пикселя обозначает соответствующие выходные данные. На практике операции прямого и обратного восстановления формы могут осуществляться с использованием таблиц соответствия (LUT).

При условии, что декодированный сигнал (117) уже находится в перцепционно кодированном цветовом пространстве, операции управления отображением (например, 125 и 130) требуют только более простого повышения дискретизации цветности (например, с 4:2:0 в 4:4:4). В некоторых вариантах осуществления операции повышения дискретизации цветности могут осуществляться до операции (122) обратного восстановления формы как часть операций видеодекодера (115), так как видеодекодер может поддерживать такую операцию непосредственно в аппаратном обеспечении.

На фиг. 1C показан альтернативный вариант (100B) системы, показанной на фиг. 1B, полученный посредством объединения операций обратного восстановления формы и тональной компрессии в один блок (122B), обычно множество LUT. Как обсуждалось ранее, видеокодирование (110) и видеодекодирование (115) могут осуществляться с использованием либо одноуровневой системы кодирования (например, видеокодер (110) может использовать один 10-битный видеокодер H.264 или H.265), либо двухуровневой системы кодирования (например, видеокодер (110) может применять два или более 8-битных видеокодера H.264 или H.265, как описано в заявке PCT № PCT/US2014/042583, поданной 16 июня 2014 года, которая полностью включена в данную заявку посредством ссылки). Предположим, что тональная компрессия выполняется независимо на каждом цветовом канале, тогда две функции могут быть объединены следующим образом.

Для одноуровневого кодека, пусть

описывает таблицу соответствия для генерирования выходных данных функции восстановления y, если задан декодированный сигнал x. Также, пусть

описывает таблицу соответствия для генерирования выходных данных функции z тональной компрессии, если заданы выходные значения y. Тогда две LUT могут быть объединены как

Например, для 10-битных входных данных x, K(x) может иметь 1024 элементов.

В двухуровневом кодеке обычно имеется 8-битный базовый уровень (BL) и 8-битный уровень улучшения (EL), каждый со своим собственным блоком восстановления. Пусть и об означают функции обратного восстановления формы основного уровня и уровня улучшения, использующиеся для генерирования конечного HDR-сигнала. При условии, что

тогда 2D LUT

может быть использована для объединения двух операций. Для 8-битных входных данных и 10-битных выходных данных, для такой LUT потребовалось бы приблизительно 256*256*2 = 131 килобайт для каждого цветового канала.

Следует отметить, что операции модуля (124) повышения дискретизации цветности могут также быть объединены с операциями видеодекодера (115), чтобы воспользоваться преимуществом любых доступных аппаратных ускорителей в принимающем устройстве.

В некоторых вариантах осуществления даже несмотря на то, что и кодирование, и декодирование, и управление отображением осуществляются в одном перцепционном цветовом пространстве (например, IPT-PQ), может использоваться множество таких цветовых пространств. Например, кодирование и декодирование могут быть выполнены в оппонентном цветовом пространстве (например, IPT-PQ или YCbCr-PQ), но управление отображением может быть выполнено в основном цветовом пространстве (например, RGB-PQ). Такой пример реализации показан на фиг. 1D согласно другому варианту осуществления, где кодирование и декодирование осуществляются в цветовом пространстве IPT-PQ, но управление отображением осуществляется в цветовом пространстве LMS-PQ. Пример процесса управления отображением в пространстве LMS-PQ описан в заявке ‘622. Как описано в заявке ‘622 и частично показано на фиг. 2A, преобразование видеоданных в цветовое пространство LMS-PQ может включать следующие этапы.

a) В случае необходимости (не показано), выполнение повышения дискретизации цветности и других цветовых преобразований (например, из IPT-PQ в RGB) для преобразования декодированного сигнала либо в гамма-кодированный RGB, либо в RGB-PQ-кодированный сигнал (205).

b) Линеаризация RGB-сигнала (этап 210). Декодированный HDR-сигнал (123) может быть гамма-кодированным или PQ-кодированным, причем он обычно отправляется с использованием метаданных, встраиваемых в кодированный битовый поток, таких как поле EOTF, для возврата или отмены преобразования первоначального дисплея из кодовых значений в яркость. Например, если входной сигнал подвергнут гамма-кодированию, тогда на данном этапе применяют обратную гамма-функцию. Если входной сигнал является PQ-кодированным согласно заявке PCT ‘212, тогда на этом этапе применяют обратную PQ-функцию. На практике этот этап линеаризации может быть осуществлен с использованием трех предварительно вычисленных 1-D таблиц соответствия (LUT).

c) Преобразование из линейного RGB в LMS (этапы 215 и 220). На этом этапе выходной сигнал (212) этапа b) преобразуют в цветовое пространство LMS. Обычно этот этап осуществляют с применением матрицы 3 x 3, управляемой входными метаданными.

d) PQ-кодирование (230) применяют к каждой из цветовых составляющих L, M, и S для генерирования выходных данных (232) в цветовом пространстве LMS-PQ. Этот этап также может быть осуществлен с использованием трех 1-D LUT. В некоторых вариантах осуществления полная схема цветового преобразования (например, из IPT-PQ в LMS-PQ) может быть вычислена с использованием 3D LUT. Если управление отображением осуществляется в пространстве IPT-PQ вместо LMS-PQ, тогда дополнительное цветовое преобразование (235) из LMS в IPT применяют к LMS-PQ-сигналу (232) для генерирования IPT-PQ-сигнала (237).

В некоторых вариантах осуществления это требует меньшего объема вычислений для выполнения управления отображением в пространстве LMS-PQ; однако цветовые каналы в цветовом пространстве LMS-PQ являются высоко коррелированными, таким образом, работа видеокодера (110) и видеодекодера (115) в этом пространстве является неэффективной; следовательно, пара кодер-декодер должна работать в другом цветовом пространстве; обычно оппонентном цветовом пространстве, таком как YCbCr или IPT.

В некоторых вариантах осуществления может быть предпочтительнее кодировать HDR-видеосигналы с использованием перцепционного оппонентного цветового пространства (такого как YCbCr-PQ или IPT-PQ) для уменьшения общих требований к битовой глубине для видеокодера (110) и видеодекодера (115). В следующем разделе описан способ улучшения эффективности кодирования при кодировании в цветовом пространстве IPT-PQ.

Улучшенная перцепционная однородность

В колориметрии и в данном документе термин «модель представления цвета» обозначает «любую модель, которая включает предсказатели по меньшей мере атрибутов относительного представления цвета, определяющих светлоту, цветность и тон». (M. D. Fairchild, «Color Appearance Models», второе издание, John Wiley и Sons, 2005). Примеры таких моделей включают CIE L*a*b* (CIELAB), IPT и CIECAM02. Как показано на фиг. 2A, и будет описано более подробно далее, если имеется некоторый RGB-сигнал, он может быть переведен в такое цветовое пространство с применением следующих этапов:

a) преобразование для CIE XYX или любого другого RGB-кодирования в линейное трехцветное пространство, близкое к фундаментальному пространству LMS, основанному на откликах колбочек (этапы 215, 220);

b) применение необязательного преобразования хроматической адаптации, обычно посредством линейного масштабирования (не показано);

c) применение нелинейного преобразования, такого как PQ-кодирование (230);

d) применение некоторой дополнительной обработки (например, 235) для дополнительной декорреляции цветовых каналов.

Этот подход в результате приводит к удовлетворительной перцепционной однородности и линейности тона для цветовых пространств с нешироким цветовым охватом, например, указанных в рекомендациях ITU 709; однако он не может обеспечить точное предсказание модели представления цвета для широких цветовых охватов, например, указанных в рекомендации 2020, обычно используемых для HDR-изображений. Существуют предложения для преодоления многочисленных проблем CIECAM02, но они не решают проблему чрезмерного увеличения цветовых различий в отношении низкоамплитудных цветовых вкладов в одном RGB-канале при наличии высокоамплитудных цветовых стимулов другого цветового канала. Таким образом, насколько известно автору изобретения, не существует точной модели представления цвета для широких цветовых стимулов. В варианте осуществления новый этап преобразования перекрестных цветовых искажений, выполняемый после этапа преобразования из XYZ в LMS, значительно улучшает перцепционную однородность, линейность тона и эффективность кодирования для насыщенных цветов в моделях представления цвета. Такое улучшение моделей цвета может быть использовано как в кодировании изображений и видеоизображений, так и в управлении отображением. В качестве примера в следующем разделе матрица преобразования перекрестных искажений получена для цветового пространства IPT-PQ; однако похожие подходы могут быть применены к другим моделям представления цвета.

Улучшенная перцепционная однородность и использование кодовых слов в цветовом пространстве IPT-PQ

Как описывалось ранее, а также показано на фиг. 2A, цветовое преобразование из RGB в IPT-PQ можно осуществлять с применением следующих этапов:

a) Нормирование значений пикселя входного сигнала (102) (например, от 0 до 4095) с получением значений пикселя с динамическим диапазоном между 0 и 1.

b) (Этап 210) Использование EOTF (может быть представлена входными метаданными), линеаризация входного сигнала. Например, если входной сигнал (205) подвергнут гамма-кодированию, тогда на этом этапе применяют обратную гамма-функцию. Если входной сигнал является PQ-кодированным согласно заявке PCT ‘212, тогда на этом этапе применяют обратную PQ-функцию.

c) (Этапы 215 и 220) Преобразование выходных данных этапа b) (например, сигнал 212) в цветовое пространство LMS. Этот этап обычно включает преобразование из RGB в XYZ (этап 215), за которым следует преобразование из XYZ в LMS (этап 220).

d) В соответствии с «Ebner paper» традиционное преобразование цветового пространства из LMS в IPT включает применение первой нелинейной степенной функции к данным LMS, а затем применение линейной матрицы преобразования. Несмотря на возможность преобразования данных из LMS в IPT, а затем применения PQ-функции, находящейся в области IPT-PQ, в предпочтительном варианте осуществления на этом этапе (230), традиционную степенную функцию для нелинейного кодирования из LMS в IPT заменяют нелинейным PQ-кодированием. Например, нелинейные значения L, M, и S вычисляют аналогичным образом, как V сигнал в уравнении (t2), где Y сигнал заменен значениями линейных составляющих L, M или S. В некоторых вариантах осуществления может быть использована нормированная версия кодирования PQ, при этом этап уравнения (t3) может быть опущен и диапазон выходных значений PQ составляет от 0 до 1.

e) С использованием стандартного линейного преобразования из LMS в IPT на этом этапе (235) завершается преобразование выходных данных этапа d) (например, сигнал 232) в цветовое пространство IPT-PQ.

Для простоты предположим, что любое цветовое пространство определено в нормированном 3-D кубе в пределах диапазона значений [0 1], где 1 обозначает максимально возможное значение пикселя для заданной битовой глубины. Для улучшения эффективности кодирования в предпочтительном варианте осуществления после каждого преобразования в перцепционно кодированное цветовое пространство может быть применено отдельное цветовое преобразование для того, чтобы надлежащим образом изменить составляющие цветности.

Рассмотрим отображение PQ-кодированных значений RGB (205) в цветовом пространстве IPT-PQ. Эта отображение высоконелинейно и преобразовывает RGB-PQ куб в некубическую форму. В качестве примера на фиг. 3A показано соотношение P и T после отображения приблизительно 10000 точек пространства RGB-PQ в пространство IPT-PQ. Затем можно будет обнаружить, что исходный RGB-PQ куб больше не является кубом. В пространстве IPT-PQ имеется два хвоста: один короткий хвост в области P[−0,3, −0,1] × T[−0,4,−0,2] (305) и другой длинный хвост в области P[0,1, 0,2] × T[0,6, 1] (310). Длинный хвост пространства IPT-PQ приводит к неэффективному распределению кодовых слов из-за пустых пространств, оставшихся неиспользованными вокруг хвоста. Также оказалось, что эти хвосты не имеют перцепционной значимости.

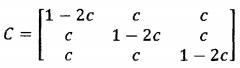

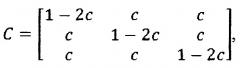

Теперь рассмотрим схему цветового преобразования из RGB в IPT-PQ, как показано на фиг. 2B. Как показано на фиг. 2B, дополнительный этап (225) для корректировки перекрестных искажений канала применяют к линейным данным LMS (222) перед применением нелинейного PQ-кодирования (230). Пусть

обозначает помимо прочего пример корректировки перекрестных искажений цветового канала (225) входных данных LMS с получением преобразованных данных LMS (LMSc), где C обозначает матрицу преобразования перекрестных цветовых искажений 3 x 3, где c – постоянная, которая управляет уровнем перекрестных искажений между тремя цветовыми составляющими (например, c=0,02 или c = 0,04). В некоторы